PH热榜 | 2026-03-07

一句话介绍:TestSprite 2.1 是一款面向AI原生团队的智能测试代理,它通过MCP服务器连接IDE,在AI生成代码后自动创建、执行完整测试套件并反馈修复,解决了AI编码时代代码产出速度快但验证滞后、质量无保障的核心痛点。

SaaS

Developer Tools

Artificial Intelligence

AI原生测试

自动化测试生成

智能代码验证

MCP工作流

CI/CD集成

无代码测试编辑

开发运维一体化

智能体工作流

用户评论摘要:用户普遍认可其作为“AI代码验证缺失层”的价值,赞赏MCP工作流和PR自动拦截。主要问题/建议包括:对复杂交互(如拖拽、画布)的测试能力、语义与功能验证的差异、测试稳定性(误报)处理、与传统测试框架的共存关系,以及向更广泛智能体行为验证的演进可能。

AI 锐评

TestSprite 2.1 的实质,并非又一个测试生成工具,而是对“AI编码智能体”生态的强制性纠错与合规层。其真正的颠覆性在于,它试图将“验证”这一滞后、被动的人力行为,转化为一个与“生成”并行的、自动化的智能体间对话协议(MCP)。产品聪明地抓住了当前AI编程的命门:生成易,验证难,信任缺。通过嵌入IDE并与Coding Agent直接通信,它把测试从下游质检环节,前置为编码过程的实时伴随约束。

然而,其面临的深层挑战与价值同样尖锐。首先,其测试的“正确性”本质上仍源于AI对规格的理解,这陷入了“用AI验证AI”的循环论证,尤其在语义和用户体验层面,缺乏真正的“地面真相”。评论中提及的“语义Oracle问题”直指这一软肋。其次,宣称的“无手动工作”在复杂、状态密集的应用中恐难实现,其视觉编辑器更像是对AI生成不完美的补救措施,而非根本消除。最后,其商业模式绑定在“AI生成代码”这一特定范式上,若未来AI编码能力突破至能生成更可靠代码,或开发范式迁移,其“缺失层”的定位可能被动摇。

当前,它为狂热追求AI编码速度的团队提供了一个亟需的“安全阀”,价值显著。但其长期护城河,不在于更快的测试引擎,而在于能否构建起超越代码语法、深入业务逻辑与用户体验的验证知识体系,从而从“测试生成代理”进化为“质量规范实施平台”。否则,它可能只是特定技术过渡期的临时解决方案。

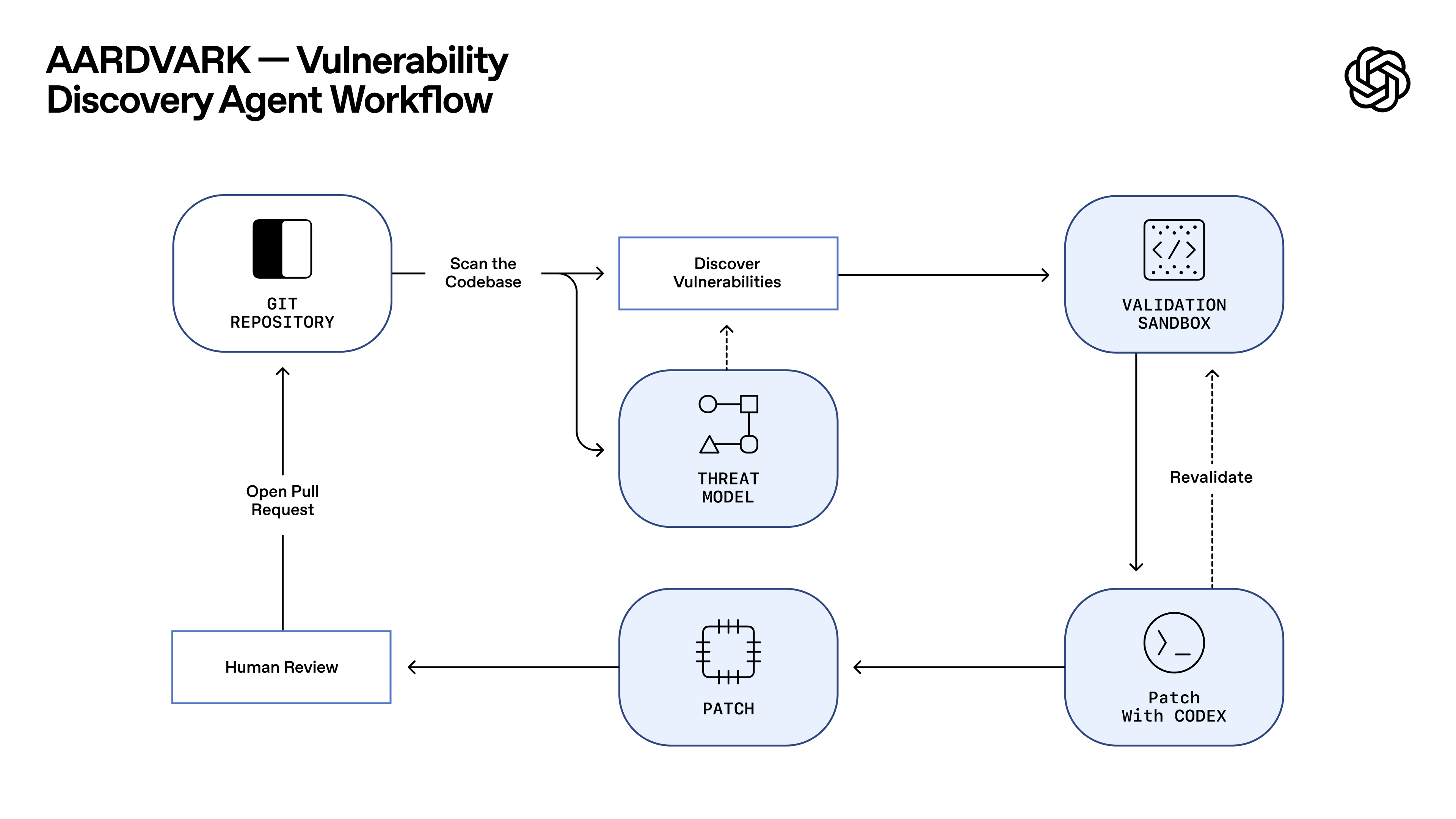

一句话介绍:Codex Security是一款应用安全代理,通过在开发流程中自动发现、验证漏洞并提供可审查的修复方案,解决了安全工具误报率高、修复流程繁琐的痛点,帮助开发团队更高效地交付安全代码。

Software Engineering

Development

Security

应用安全

代码安全代理

漏洞扫描

漏洞验证

自动修复

开发安全运维

依赖安全

误报过滤

AI安全工具

代码审计

用户评论摘要:用户肯定其验证漏洞、减少误报的核心价值,尤其对应对供应链攻击(如npm后安装攻击)表示期待。同时提出关键问题:产品是否覆盖传递性依赖漏洞?以及在大代码库中如何确定漏洞优先级。

AI 锐评

Codex Security的发布,看似切入了一个拥挤的应用安全测试市场,但其真正的锋芒在于试图用“验证”和“修复建议”两把手术刀,精准切除当前安全工具生态的两大肿瘤:噪音与阻力。

传统SAST/SCA工具常因海量误报沦为“狼来了”的制造者,导致开发团队产生警报疲劳,最终选择忽视。Codex将“验证”作为核心卖点,承诺区分信号与噪音,这直接回应了开发者最深的厌恶——无效告警。其价值不在于发现更多漏洞,而在于发现更“真实”的漏洞。然而,这引出了一个更深层的技术拷问:其验证机制是依赖更精准的规则、动态分析,还是结合了上下文(如代码执行路径、业务逻辑)?这决定了它能否真正超越现有方案,还是仅做了更好的过滤。

其次,从“标记问题”到“提议修复”,产品试图将安全左移的终点从“发现”推进到“解决”。这不仅提升了修复效率,更关键的是,它改变了安全团队与开发团队的协作范式——从提交问题清单转向提供解决方案草案。这能显著降低修复的认知负荷和启动阻力。但评论中关于“优先级”和“传递性依赖”的提问,恰恰点中了其商业化的命门。在庞大的依赖树中,如何结合漏洞可利用性、业务影响和修复成本进行智能排序,并提供切实可行的升级或修补路径,才是其能否在大型复杂项目中站稳脚跟的关键。

总体而言,Codex Security的价值主张清晰且切中要害,但其技术深度与智能化水平,尤其是对现代软件供应链(传递依赖)的覆盖与理解能力,将是决定其从“又一个安全工具”升维为“开发流程必备代理”的胜负手。市场需要的不再是另一个探测器,而是一个能理解上下文、做出判断并推动行动的智能安全伙伴。

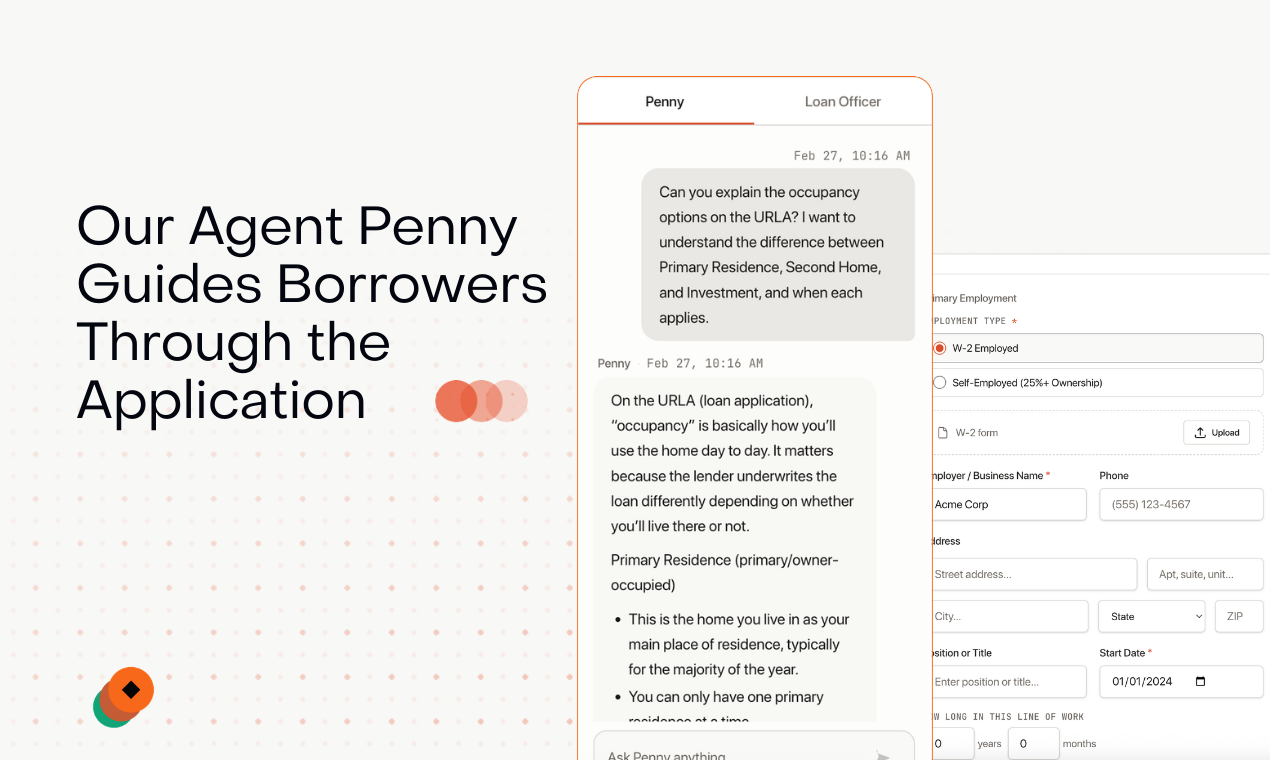

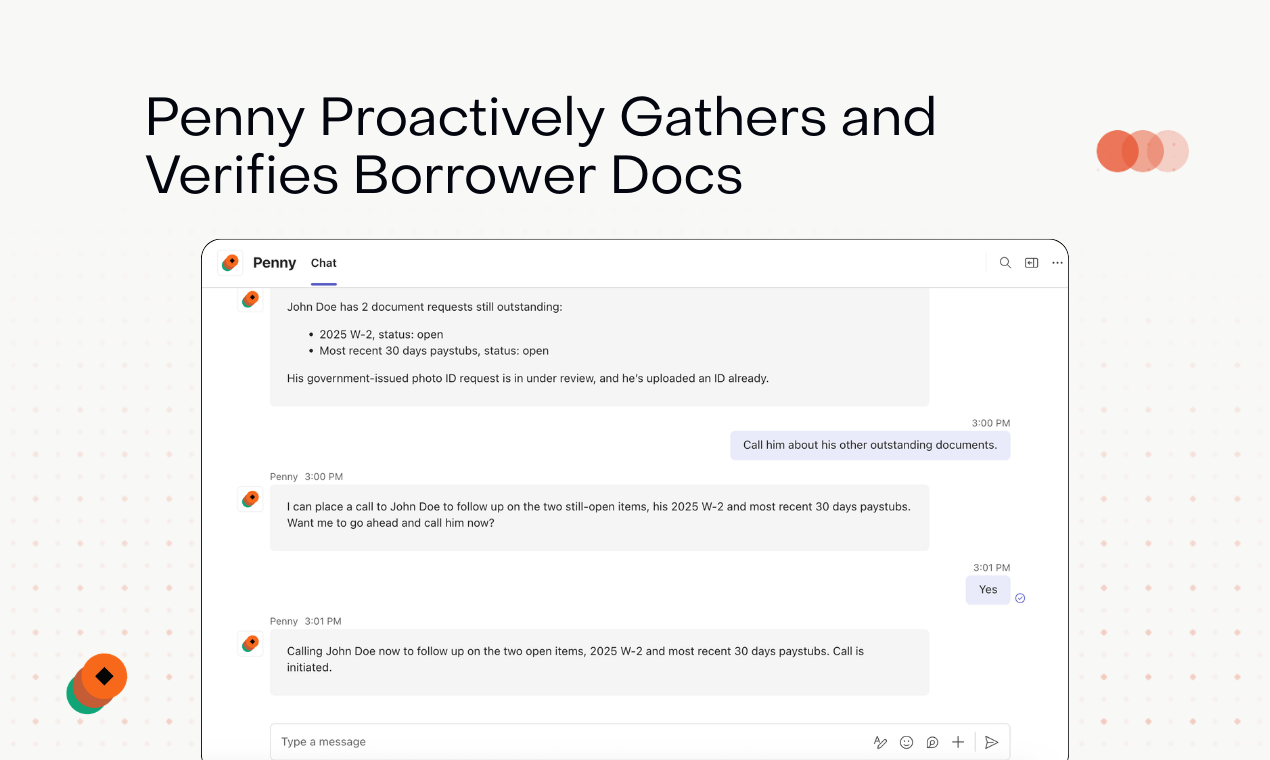

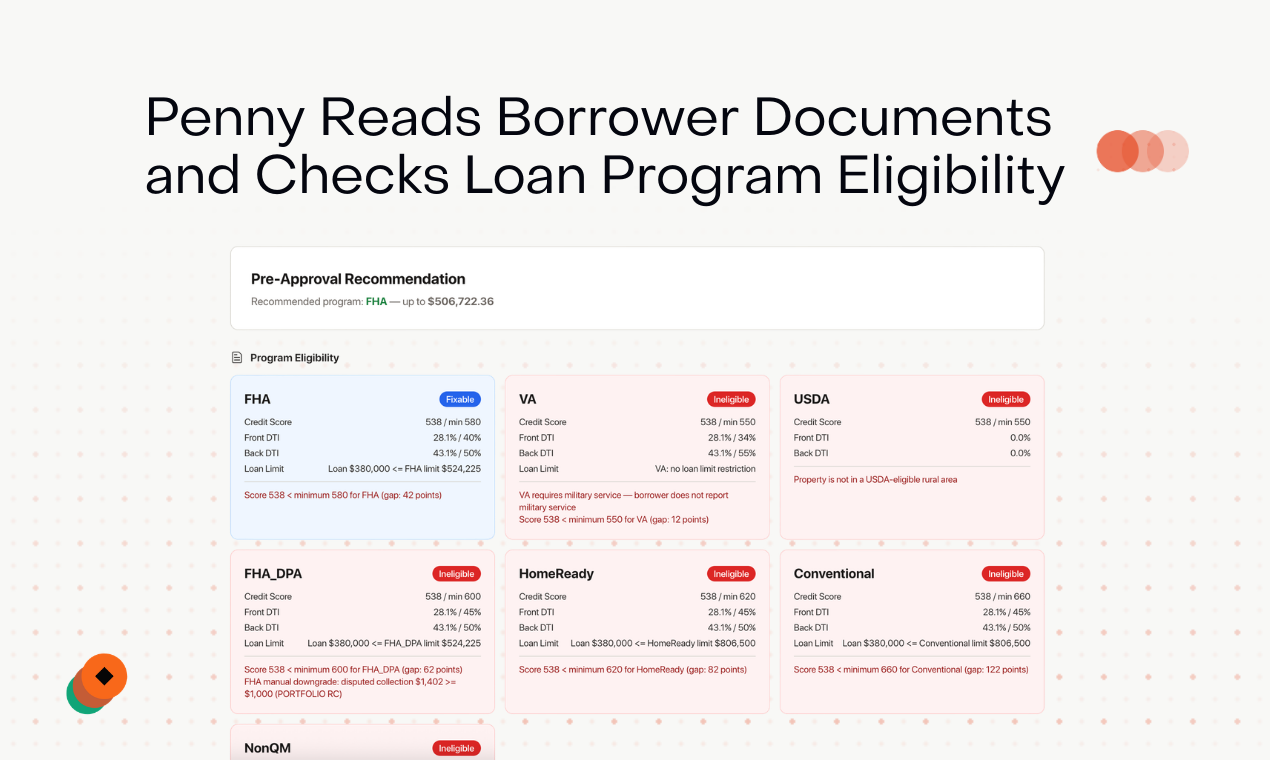

一句话介绍:Copperlane是一款AI原生贷款发起系统,其AI代理Penny通过自动化定价、引导借款人和验证文件,将数小时的贷款处理流程缩短至秒级,解决了贷款机构在文件收集、审核和纠错环节中效率低下、成本高昂的痛点。

Fintech

Artificial Intelligence

Banking

AI贷款发起系统

抵押贷款科技

流程自动化

文档智能审核

金融科技

AI代理

YC W26

降本增效

合规处理

人机协同

用户评论摘要:用户普遍认可其解决贷款文件处理痛点的价值,关注其处理自雇收入等复杂场景的能力、合规性及系统可靠性。核心问题集中于AI在非标案例中的表现、如何避免幻觉以及商业贷款场景的适用性。

AI 锐评

Copperlane宣称“AI人做抵押贷款”而非“抵押贷款人做AI”,这一定位直指行业痛点:传统系统陈旧,而新兴AI方案又常因行业理解肤浅而隔靴搔痒。其真正价值或许不在于“秒级处理”的宏大叙事,而在于用AI代理Penny切入“文件收集-初审”这一具体且溃烂的环节。

当前抵押贷款流程的瓶颈并非计算,而是协调。Penny扮演的实质是一个永不疲倦、严格守序的初级审核员兼催办助手,其核心能力是“提前发现不一致”并“主动追索”。这瞄准了行业真正的成本黑洞:因文件缺失、信息矛盾导致的漫长拉锯战。评论中反复被追问的“如何应对自雇收入等复杂情况”,恰恰暴露了市场对其的深层期待与疑虑——它是否只是又一个擅长处理标准流水线、却在边缘案例中崩溃的自动化玩具?

团队背景(抵押贷款家庭出身+AI专业)构成了其可信度的双刃剑。优势在于能精准识别流程中的“暗礁”;风险则在于,过度依赖家族经验可能使其产品陷入另一种路径依赖,难以抽象出超越特定机构工作流的通用逻辑。此外,其强调“不依赖开放式生成,而是基于文档进行可追溯输出”,这是在金融合规高压下的明智选择,但也意味着其AI能力上限被严格框定在文档比对与规则执行,离真正的“智能决策”尚有距离。

真正的考验在于:当海量的、充满矛盾的非标文件涌入时,Penny的“标记”是否会变成噪音的放大器?它能否真正理解收入证明与银行流水之间微妙的、合乎情理的不匹配?如果其输出仍需人类官员投入大量精力进行二次判断,那么所谓的“秒级”就只是流程前端的虚假繁荣。Copperlane的价值实现,不取决于其AI有多“智能”,而取决于其规则引擎与工作流设计对行业混沌现实的包容度有多强。它可能无法彻底取代人类,但有望成为让人类从文档泥潭中抽身的第一块坚实垫脚石。

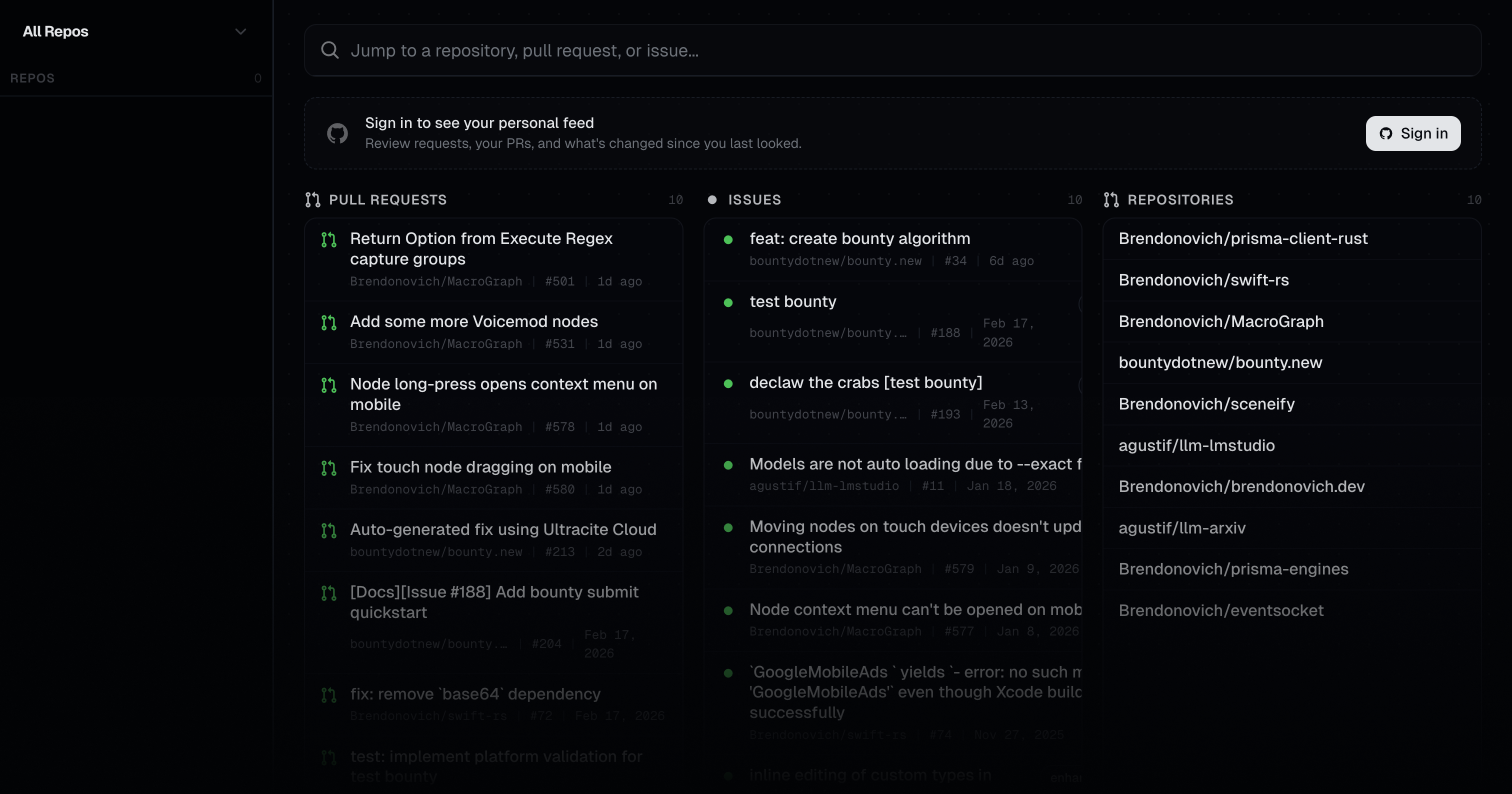

一句话介绍:FasterGH是一款通过Convex实时缓存层提供低延迟读取的GitHub镜像界面,在开发者日常浏览和探索大型代码仓库时,解决了官方UI臃肿、页面加载缓慢的痛点。

Open Source

Developer Tools

GitHub

GitHub镜像

开发者工具

性能优化

界面简化

实时缓存

代码浏览

生产力工具

前端加速

用户评论摘要:用户肯定其简化界面和加速浏览的核心价值,认为对日常开发效率提升显著。主要疑问集中于在复杂场景(如审查线程、检查运行堆积时)能否保持速度,并建议增加高效导航大型代码库的快捷键或功能。

AI 锐评

FasterGH的定位看似是界面优化,实则触及了开发者工具领域一个深层矛盾:功能完备性与操作流畅性的永恒博弈。GitHub作为“单一事实来源”确保了数据权威性,而Convex作为低延迟读取模型,本质是在用户体验层进行了一场“读写分离”的架构手术。这并非简单的UI换肤,而是通过缓存策略将高频读取路径从GitHub API中剥离,针对性打击了页面加载延迟这一核心痼疾。

然而,其真正的考验并非在静态页面浏览,而在于动态交互场景。如评论所指,当Review线程、检查运行等动态内容堆积时,GitHub的臠肿感才真正显现。FasterGH若仅缓存初始页面数据,而未能将代码差异、评论流、CI状态等实时更新内容也纳入其低延迟同步体系,则其“加速”体验将是片面的、易碎的。产品的长期价值取决于其缓存策略的深度与实时同步的智能度——它能否准确预判开发者的浏览路径,并建立相应的缓存预热和失效机制?

此外,其发展路径面临一个战略选择:是坚守“纯净加速器”的定位,还是逐步添加导航快捷键、代码关系可视化等增强功能?后者虽能提升粘性,但也可能重蹈“功能膨胀”的覆辙,背离初衷。FasterGH的价值核心应始终锚定在“无感加速”——让开发者感觉不到它的存在,只是觉得GitHub“莫名”变快了。任何新增功能都应以不引入额外延迟为前提。否则,它只会成为另一个需要被“加速”的工具。

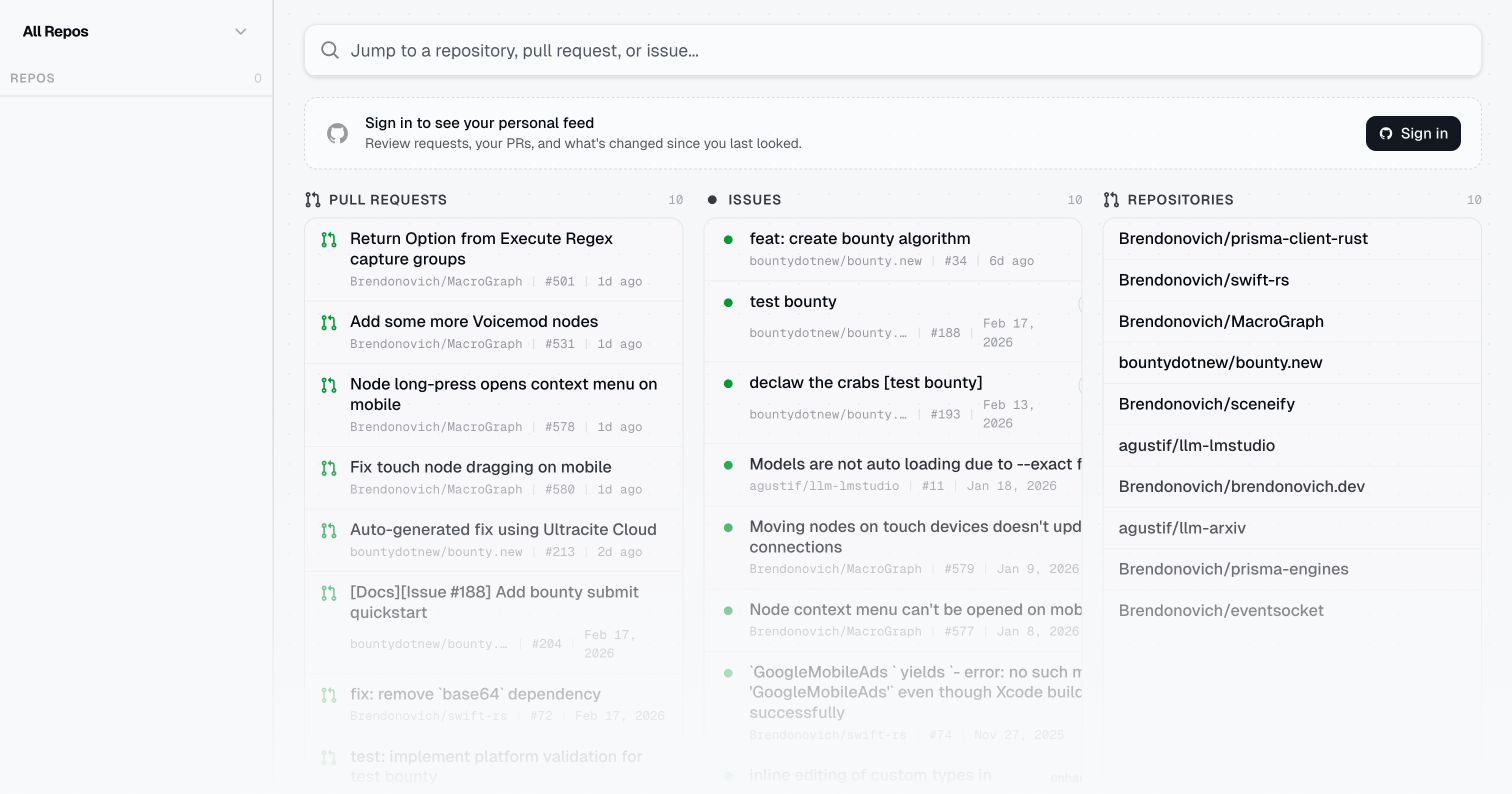

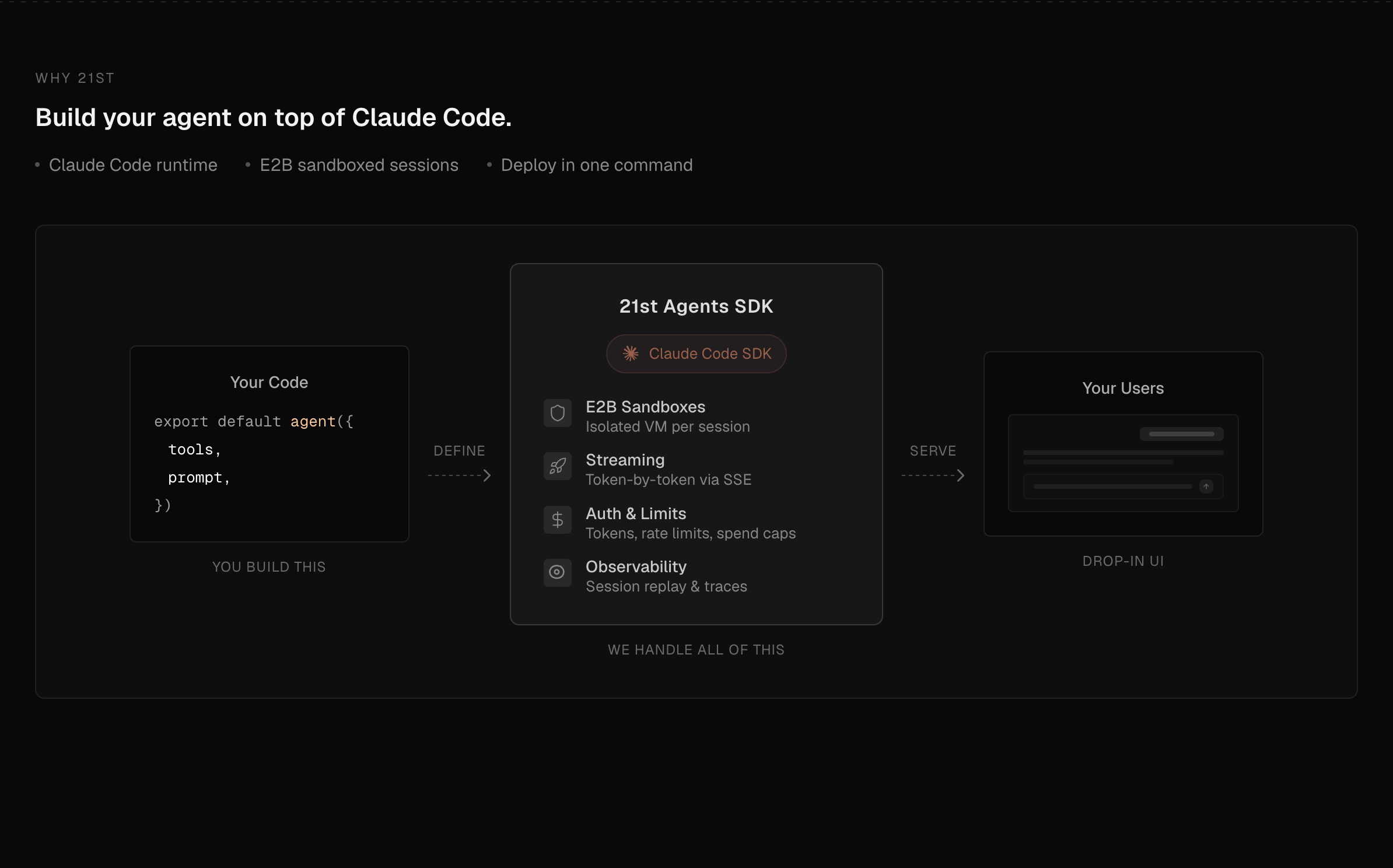

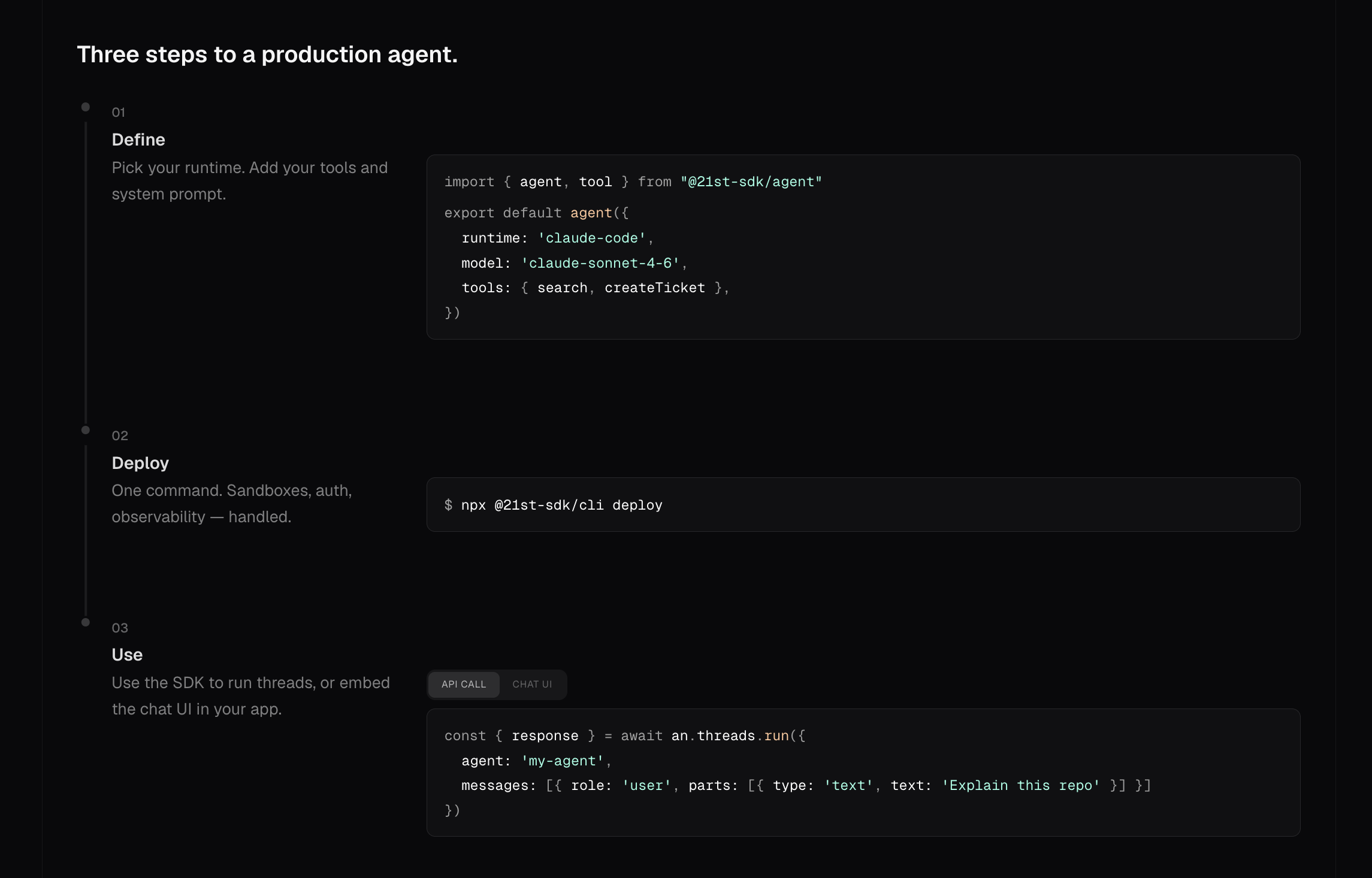

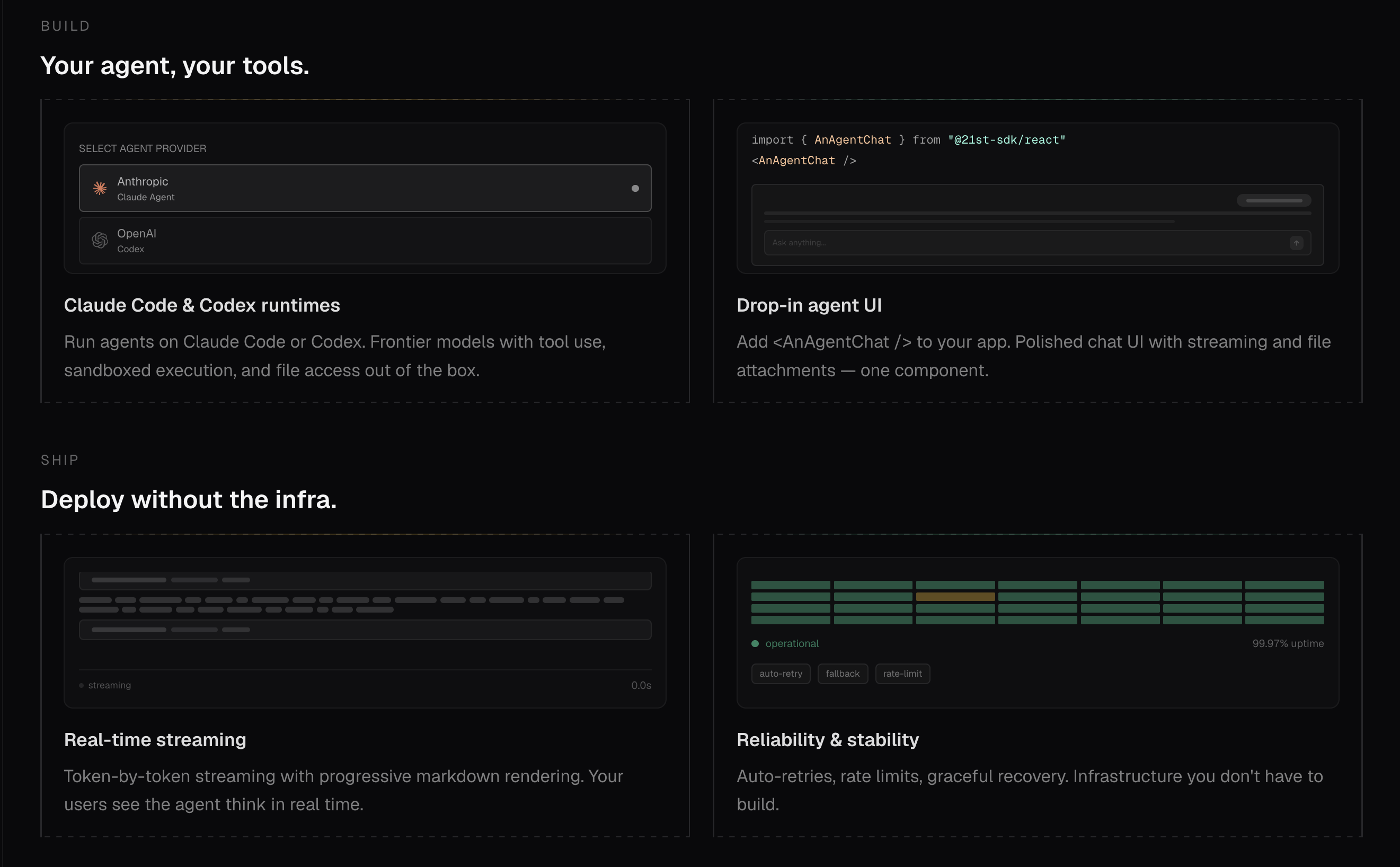

一句话介绍:这是一个允许开发者用TypeScript快速定义、一键部署并集成生产级聊天UI的SDK,解决了在应用中集成类似Claude Code级别AI智能体时,面临的基础设施构建复杂、开发周期长的核心痛点。

Developer Tools

Artificial Intelligence

SDK

AI智能体SDK

低代码AI集成

开发者工具

TypeScript定义

一键部署

生产就绪UI

可观测性

Y Combinator

应用基础设施

Claude Code

用户评论摘要:用户普遍认可其开发者体验和降低集成摩擦的价值。主要反馈包括:建议明确产品定位为“AI产品基础设施”;询问多智能体跨部署协调能力;关注团队定制后的版本管理;好奇主要应用场景是内部工具还是用户端产品。

AI 锐评

21st Agents SDK 精准切入了一个正在爆发的市场缝隙:AI智能体从“玩具”走向“产品”的工程化鸿沟。其真正价值并非技术创新,而是工程整合。它敏锐地意识到,Anthropic等模型公司在核心推理能力上建立的壁垒,已使得大多数团队自研智能体“基础设施”变得不经济。

产品聪明地做了一个“减法”:不再鼓励开发者重复造轮子,而是将Claude Code等顶级模型作为既定引擎,自身则专注于封装所有让引擎能稳定、可观测、易用接入产品的“外壳”。TypeScript定义、一键部署、内置UI和可观测性,这套组合拳瞄准的是AI应用开发者最现实的焦虑——如何将实验室里惊艳的Demo,快速、可靠地转化为用户可用的功能,而不陷入运维泥潭。

然而,其挑战也同样明显。首先,它深度绑定Claude模型,模型公司的战略变动或定价调整将是其最大的系统性风险。其次,其定位介于“组件库”和“PaaS平台”之间,评论中关于“基础设施”的定位建议一针见血。若作为轻量SDK,未来在复杂企业场景下的功能深度可能不足;若向重型平台演进,则可能失去其“简单快速”的核心吸引力。最后,智能体生态正走向多智能体协作,当前SDK聚焦于单智能体嵌入,评论中提及的“跨智能体协调”问题,将是其能否支撑下一代AI应用的关键考验。

总体而言,这是一款在正确时机出现的、解决真问题的产品。它不创造新范式,而是致力于让顶级范式得以普及,其成败将取决于在“封装复杂度”与“保持灵活性”之间的精妙平衡。

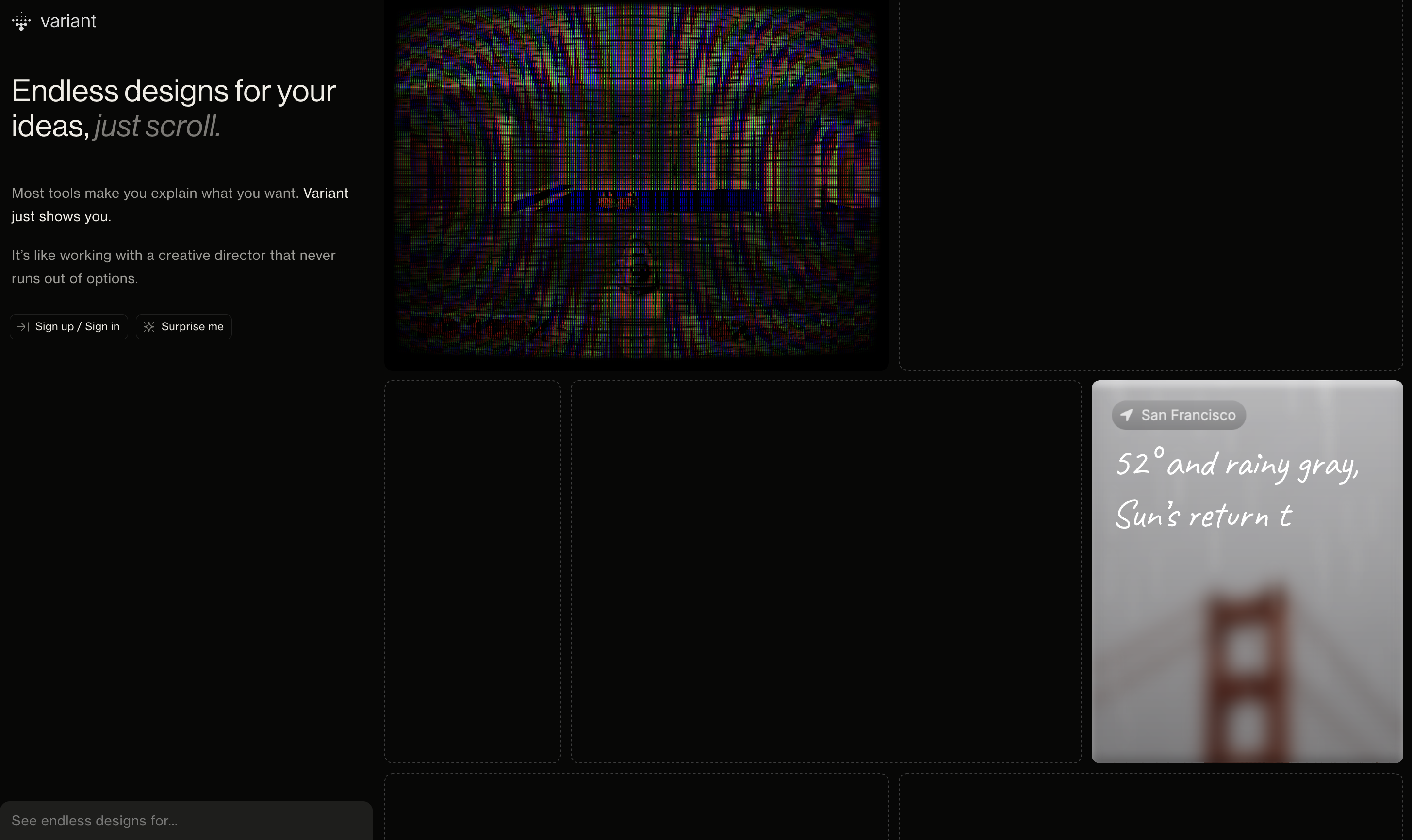

一句话介绍:Variant是一款通过“刷”而非“写”来生成无限设计方案的AI工具,在项目早期或缺乏明确设计语言时,帮助用户通过直观浏览快速探索和确立设计风格方向,解决了传统设计工具依赖精准描述、灵感枯竭和试错成本高的痛点。

Design Tools

AI设计工具

灵感生成

设计探索

创意方向

视觉风格迁移

无提示词设计

即时渲染

产品原型

创意协作

效率工具

用户评论摘要:用户肯定其“展示而非讲述”的核心理念,认为其在项目早期探索阶段价值突出。主要问题集中于:生成内容加载显示异常;如何处理有严格约束(如现有品牌系统)的设计需求;以及缺乏快速筛选、固定和导出方案的“钉选对比”工作流。

AI 锐评

Variant的“反提示词”哲学,戳中了当前AIGC工具的核心槽点:将创造性的“感觉”翻译成精准的“指令”本身,就是一种高门槛的创作。它试图回归人类更本能的视觉筛选模式,将AI定位为一位不知疲倦、灵感喷涌的“创意总监”,其真正价值在于降低灵感探索的启动成本和认知负荷,尤其服务于“我不知道要什么,但看到就知道”的模糊前期。

然而,其面临的质疑同样尖锐,揭示了其作为“探索型”工具的天然边界。评论中反复出现的“如何应对已有品牌约束”的问题,直指其当前可能更擅长“发散”而非“收敛”,更适用于“从0到1”的风格探索,而非“从1到N”的系统化延展。这暗示了其作为专业工作流中“前端灵感插件”的定位,而非覆盖全流程的生产力工具。

另一条关于“钉选与对比”功能的建议则更为致命。无止境的选项瀑布流若缺乏有效的捕捉、对比和深化机制,极易导致用户陷入“滑动麻痹”,最终一无所获。这不仅是功能缺失,更是产品逻辑是否闭环的关键考验。Variant的聪明在于切换了输入方式,但真正的挑战在于如何构建一个高效的输出漏斗,将漫无目的的“刷”转化为可决策、可执行的“选”。

当前版本像一把锋利的概念匕首,划开了新的交互可能,但其刀背的厚度——在处理约束性任务、集成至生产环节的深度——将决定它最终是一把玩具匕首,还是一柄能嵌入专业工作流的实用军刀。它的成功,取决于能否从“令人惊艳的灵感泉眼”,进化成“可信赖的设计系统伙伴”。

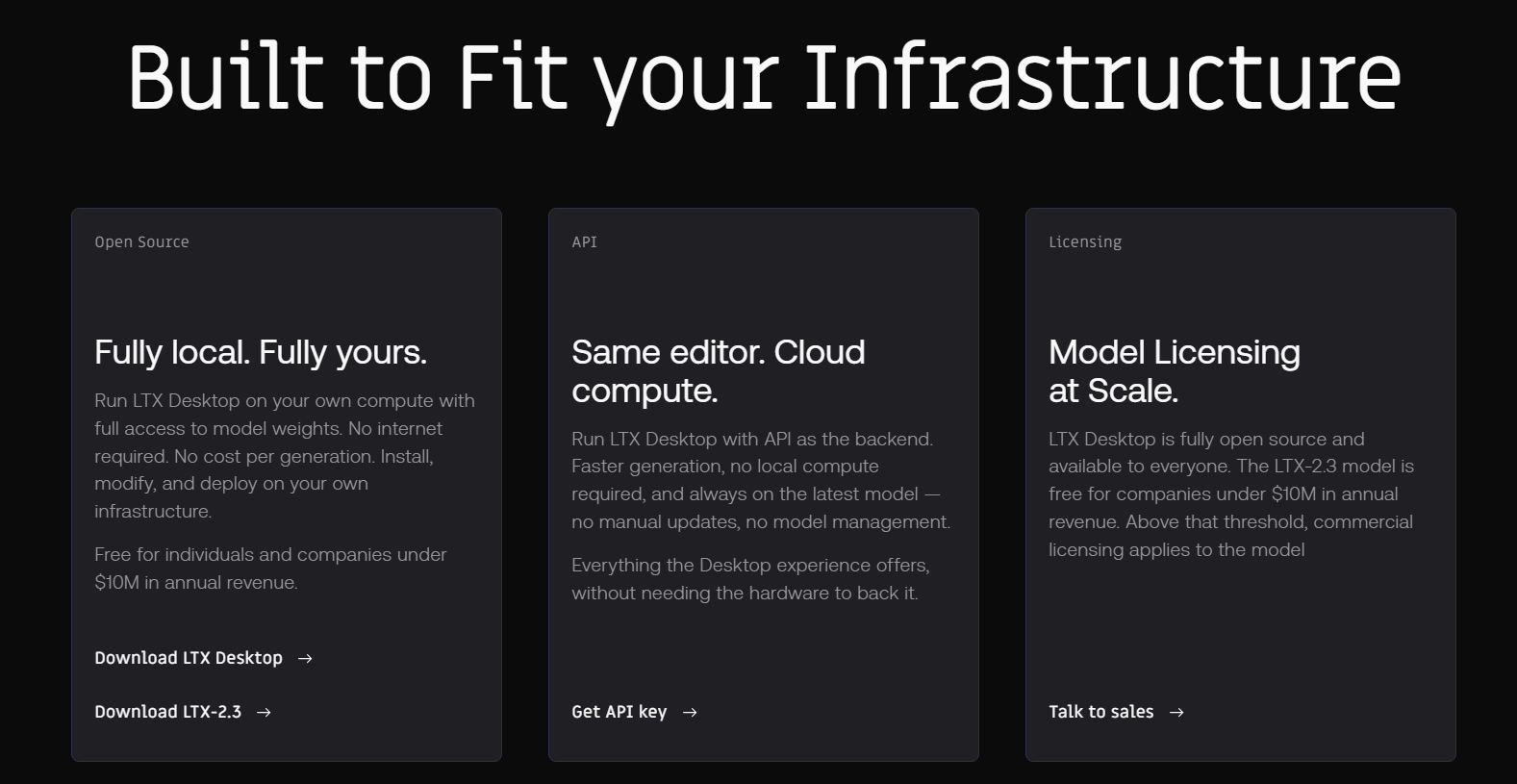

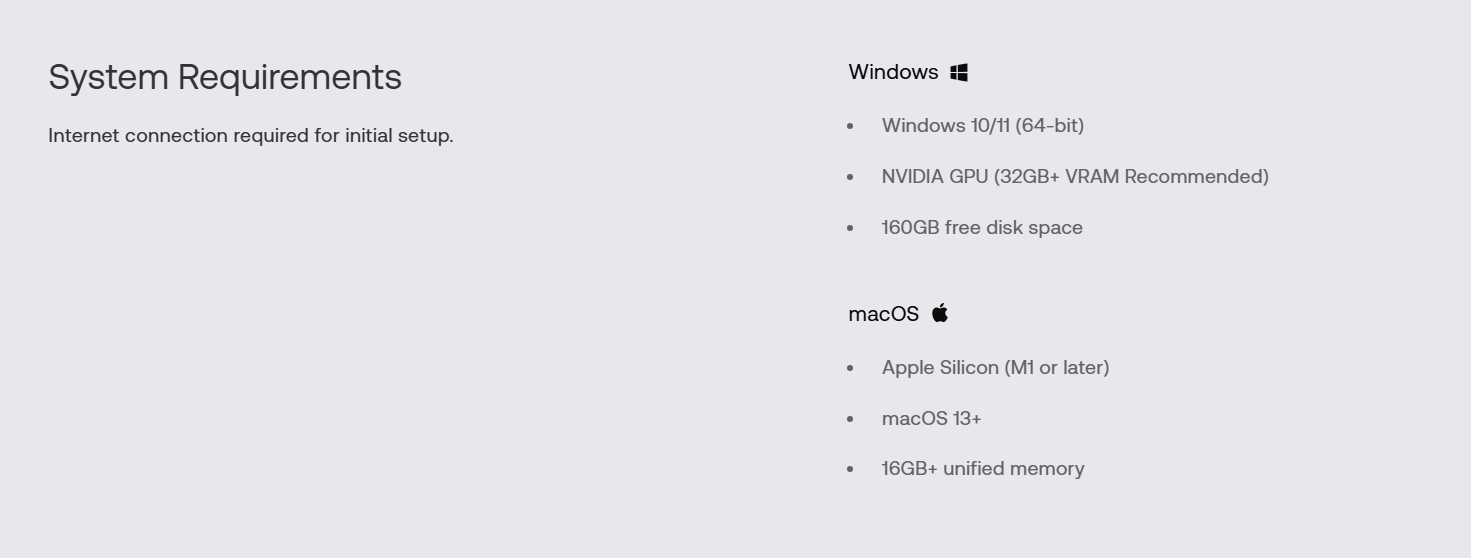

一句话介绍:LTX Desktop是一款完全本地运行、开源的非线性视频编辑器,集成了设备端AI生成功能,为创作者提供了免云依赖、无按次付费的免费视频创作与实验平台,解决了云端AI服务成本高和数据隐私的痛点。

Developer Tools

Artificial Intelligence

本地AI视频编辑

开源非线性编辑器

设备端AI生成

GPU优化

免云服务

数据隐私保护

创作者工具

LTX引擎应用

免费视频编辑软件

NVIDIA GPU支持

用户评论摘要:用户普遍赞赏其完全本地、免费开源的模式。主要疑问和建议集中在硬件门槛(尤其是32GB以下GPU的可行性)、明确的苹果设备兼容性说明、推荐的最低GPU规格,以及面向开发者的SDK/API能力。

AI 锐评

LTX Desktop的亮相,与其说是一款革命性的视频编辑软件,不如说是一次对“AI民主化”与“本地化计算”边界的压力测试。其核心价值并非在于编辑功能本身,而在于将“完全本地运行的开源AI引擎”与非线性编辑器(NLE)捆绑,试图构建一个数据不出户、使用无账单的创作乌托邦。这精准击中了当前创作者对云端AI服务成本不可控和数据隐私的深层焦虑。

然而,产品最犀利的矛盾也由此浮现。评论区的焦点几乎全部集中在硬件门槛上,这绝非偶然。本地AI计算的“自由”是以极高的硬件入场券为代价的,尤其是大容量显存。官方回复(通过用户转述)坦承量化会导致质量严重下降,这无异于承认:在现有技术条件下,其宣称的“自由”与“高性能”对主流创作者群体而言是鱼与熊掌。它将用户清晰地分割为两类:拥有顶级硬件的极客/专业创作者,和广大受硬件所困的普通用户。产品因此陷入一个尴尬定位:作为“演示”,它证明了LTX引擎的能力;但作为“日用品”,其硬件要求可能将其禁锢在小众圈层。

此外,“开源NLE+本地AI”的组合,其长期想象力在于生态。但当前版本更像一个引擎的技术展示车。若不能提供强大且易用的SDK/API,吸引开发者基于此引擎构建更垂直、更高效的工具,那么它很难从“一个有趣的集成demo”进化为“一个富有生命力的平台”。它的真正成功,将不取决于自身功能多强大,而取决于它能否降低开发者在视频AI领域创新的门槛,从而在本地催生出云服务之外的另一条工具链。这条路前景广阔,但道阻且长。

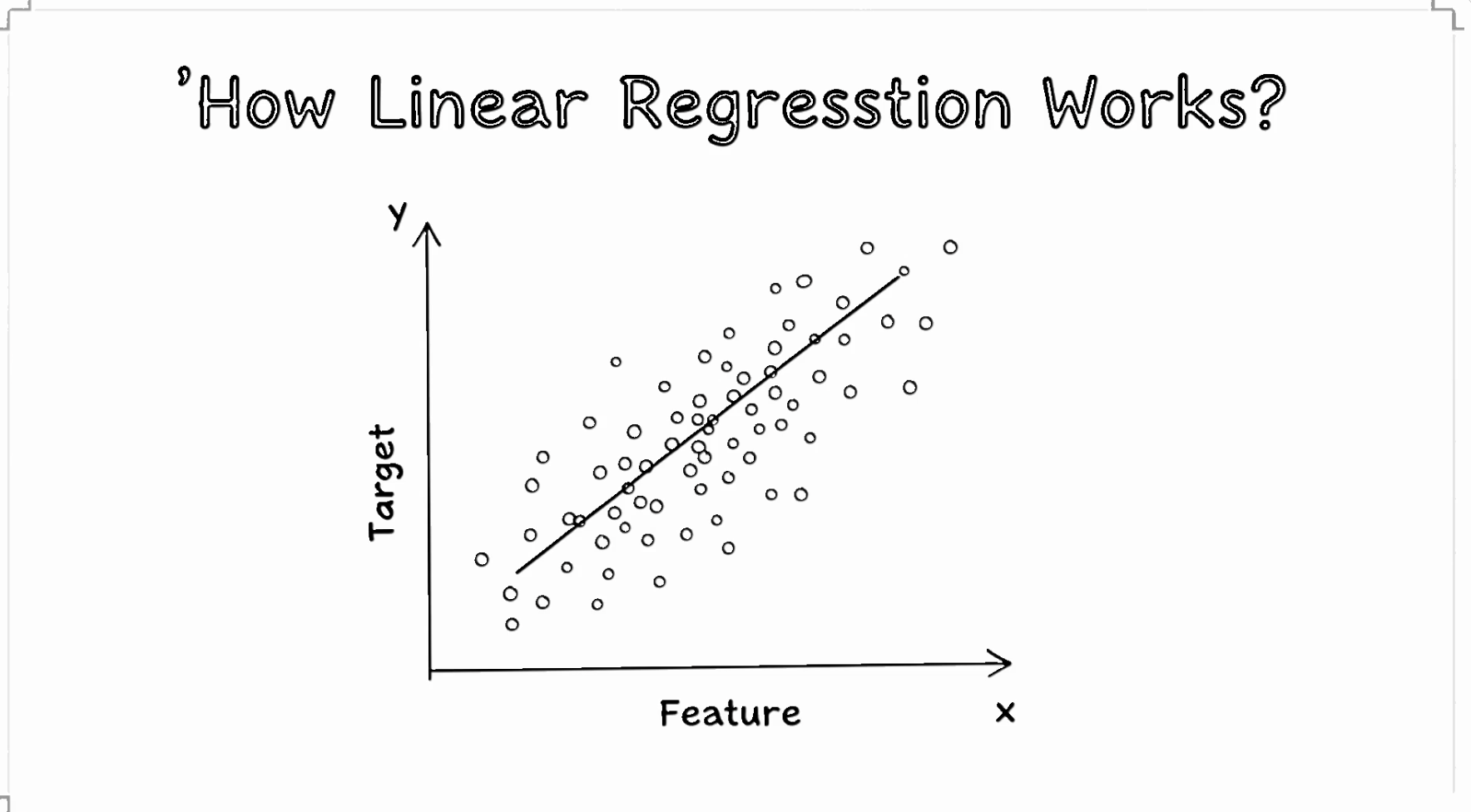

一句话介绍:一款AI驱动的涂鸦视频与矢量图生成工具,帮助创作者、教育者和营销人员将想法快速转化为风格统一、可编辑的视觉内容,解决了手动制作耗时且需专业设计技能的痛点。

Design Tools

Artificial Intelligence

Video

AI绘图

矢量图生成

涂鸦视频

内容创作

营销工具

教育科技

SVG编辑

视觉叙事

AI视频生成

快速原型

用户评论摘要:用户肯定其创意与教育、营销场景的潜力,核心关切在于生成内容的可编辑性与品牌适配度,询问矢量图层级、风格一致性及抽象概念可视化能力。团队回复正开发“工作室”功能以增强手动编辑。

AI 锐评

Thinking Line的聪明之处在于,它没有在“真实感”渲染的红海里与Midjourney等巨头肉搏,而是精准切入“手绘风格”这一细分赛道。这种看似不完美的涂鸦风格,恰恰是其护城河——它传递出亲切、手工感和易于理解的信号,天然适合教育、社交营销等需要降低用户认知门槛的场景。

然而,产品目前面临的核心矛盾,在于“AI生成速度”与“专业编辑可控性”之间的撕裂。从评论可看出,早期用户(尤其是专业创作者)的兴奋点与疑虑都聚焦于此:他们需要的并非一次性快消素材,而是能融入工作流、可深度调整的品牌化资产。产品团队以“工作室(Beta)”作为回应,方向正确但挑战巨大。这意味产品需从“有趣的AI玩具”向“生产力工具”艰难跃迁,其矢量图层的逻辑是否真正符合设计师习惯,将决定其天花板。

真正的机遇,或许如某条评论所言,在于“AI驱动叙事”。当前产品定位仍是“素材生成器”,若能内置叙事框架(如引导用户构建“问题-转折-解决方案”的视频脚本),并让视觉元素智能跟随叙事节奏,它将从工具升级为“创意副驾”,价值将倍增。否则,它可能只是又一个被更强大的AIGC模型功能覆盖的“小功能”。

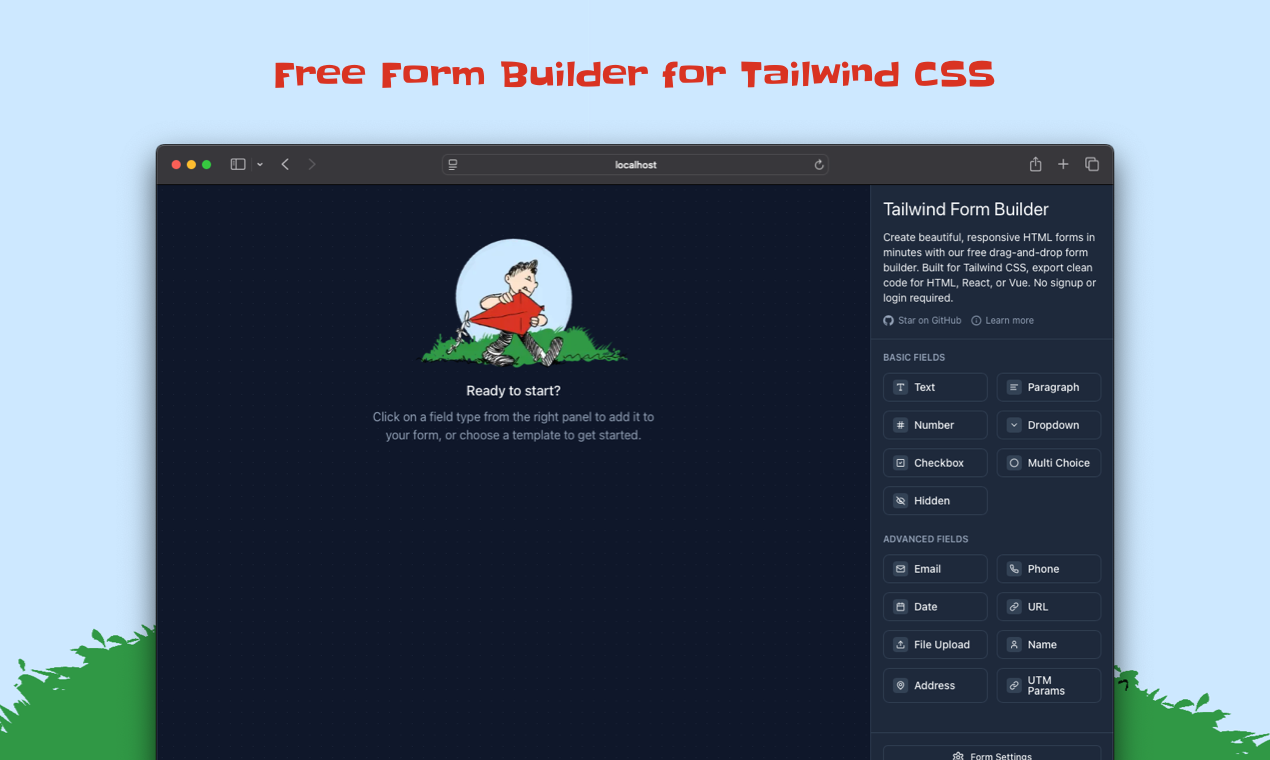

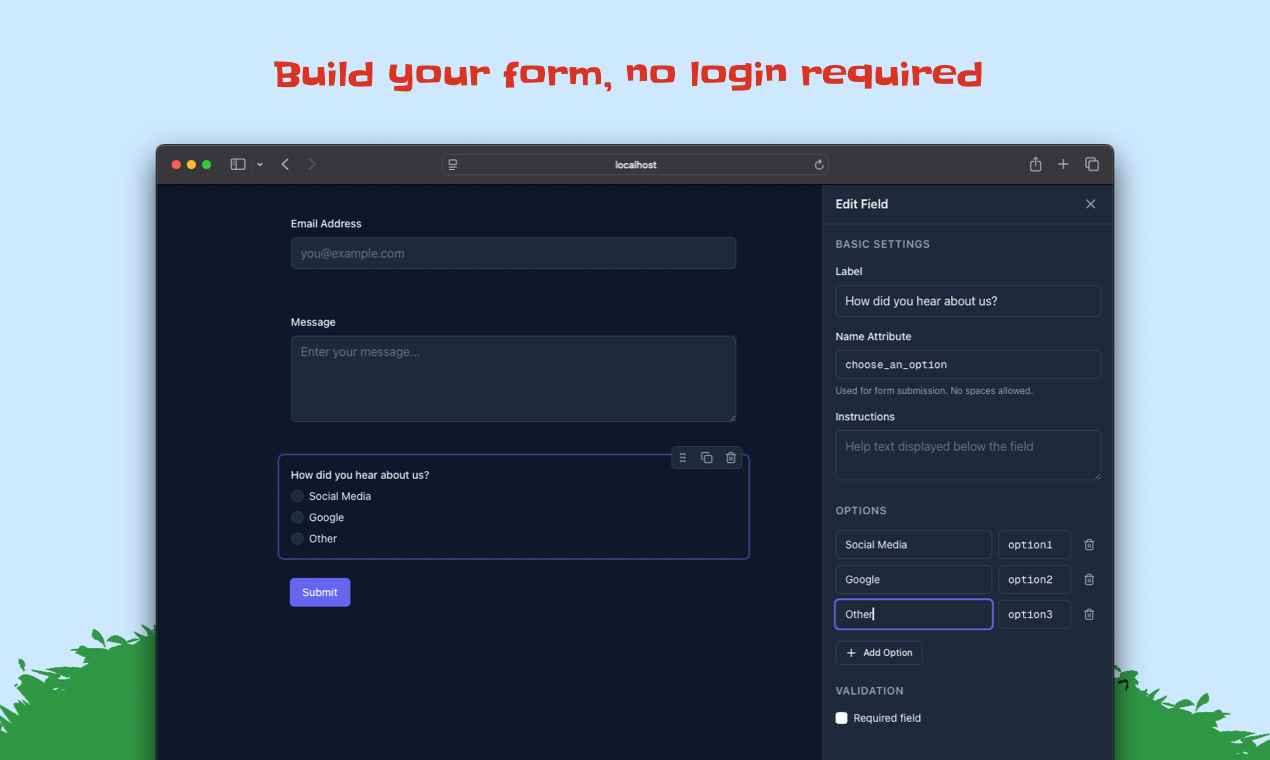

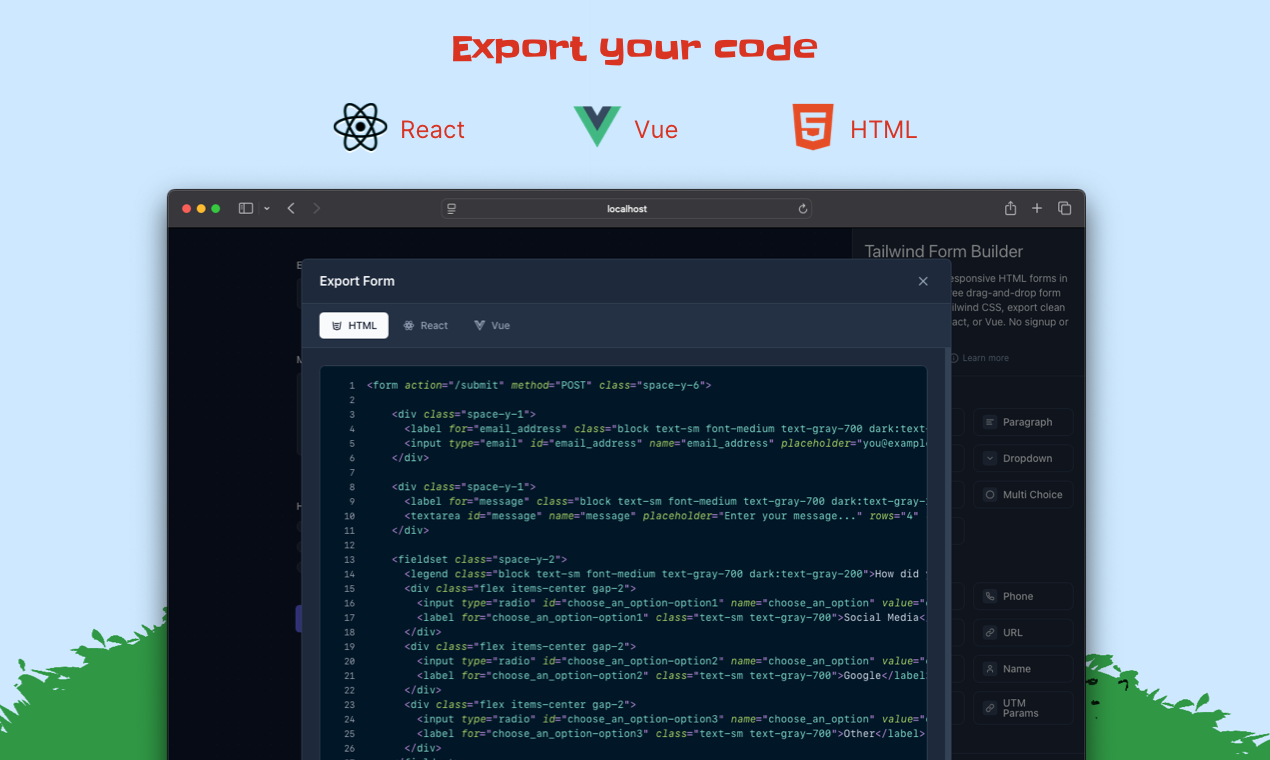

一句话介绍:一款无需登录、在浏览器内即可操作的拖放式表单构建工具,可快速生成响应式、纯Tailwind CSS代码,解决了开发者在原型设计和静态页面中重复编写表单样式、追求高效与代码洁癖的痛点。

Open Source

Marketing

Developer Tools

GitHub

表单构建工具

Tailwind CSS

低代码

前端开发

开源工具

原型设计

代码生成

React

Vue

无后端

用户评论摘要:用户赞赏其免登录和干净代码输出的定位。核心反馈聚焦于功能增强:建议增加表单验证代码生成、更多字段类型和主题样式。同时,用户讨论了其与Google Sheets集成的商业化路径,并提及了垃圾邮件控制等实际部署需求。

AI 锐评

产品精准切入了一个被忽视的缝隙市场:服务于有审美和效率追求的开发者,而非纯粹的无代码用户。其核心价值并非“创建表单”——市面上已有太多此类工具——而在于充当“Tailwind CSS 表单样式翻译机”。它将开发者从机械的、重复性的类名堆砌中解放出来,通过可视化操作直接输出符合Tailwind CSS哲学和项目规范的干净代码,实现了设计到代码的“无损转换”。

其“无登录、无存储、纯前端”的极简主义设计,是产品策略的亮点,也是其最大的风险点。这极大地降低了用户尝试门槛,完美匹配其“即用即走”的工具定位,迅速建立技术人群的好感。然而,这也几乎封死了传统的SaaS商业模式,使其不得不依附于为其导流的赞助项目(Sheetmonkey.io)。这种模式能否持续支撑产品迭代,存有疑问。

从评论看,用户的期待已超越“样式生成”,向“功能生成”(如验证逻辑)延伸。这揭示了产品的深层矛盾:是保持轻量、专注的代码风格工具,还是向功能更复杂的表单解决方案演进?后者将使其直接与更重量级的对手竞争,并可能背离其简洁的初心。产品的真正挑战在于,如何在添加实用功能的同时,不破坏其引以为傲的“无BS”体验和代码输出的纯粹性。它的成功,取决于能否在开发者工具的“专”与“全”之间,找到那条精妙的平衡线。

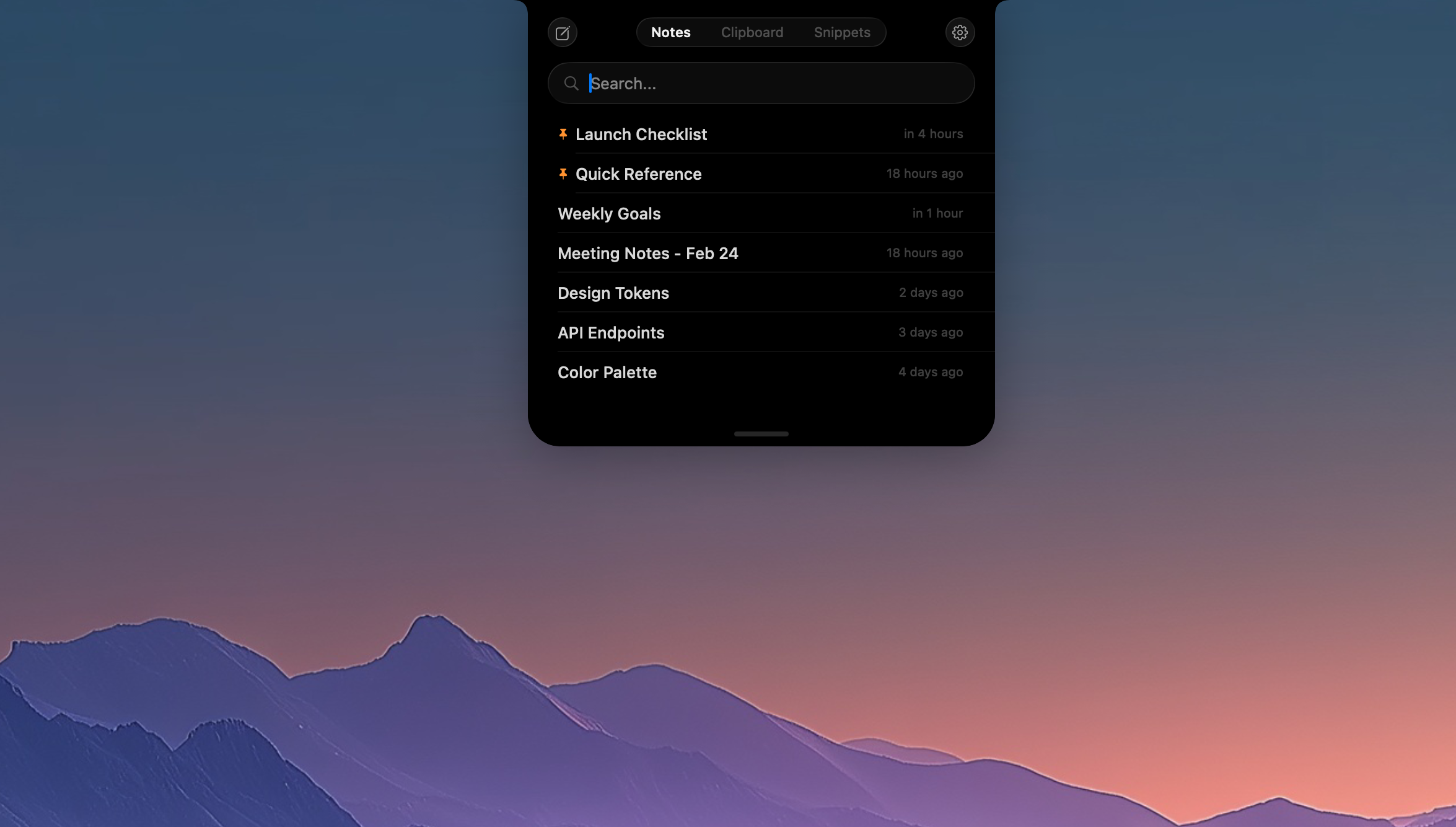

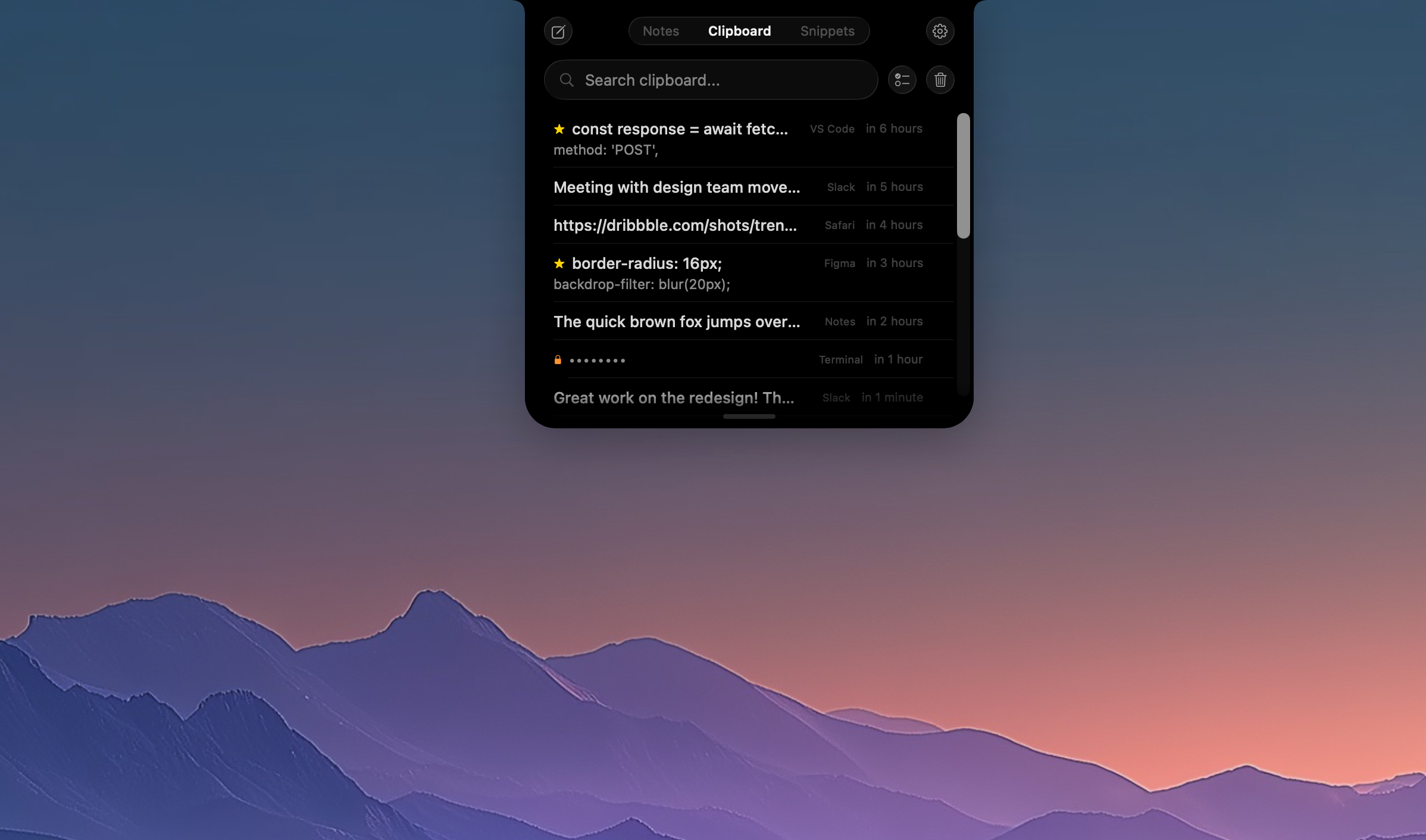

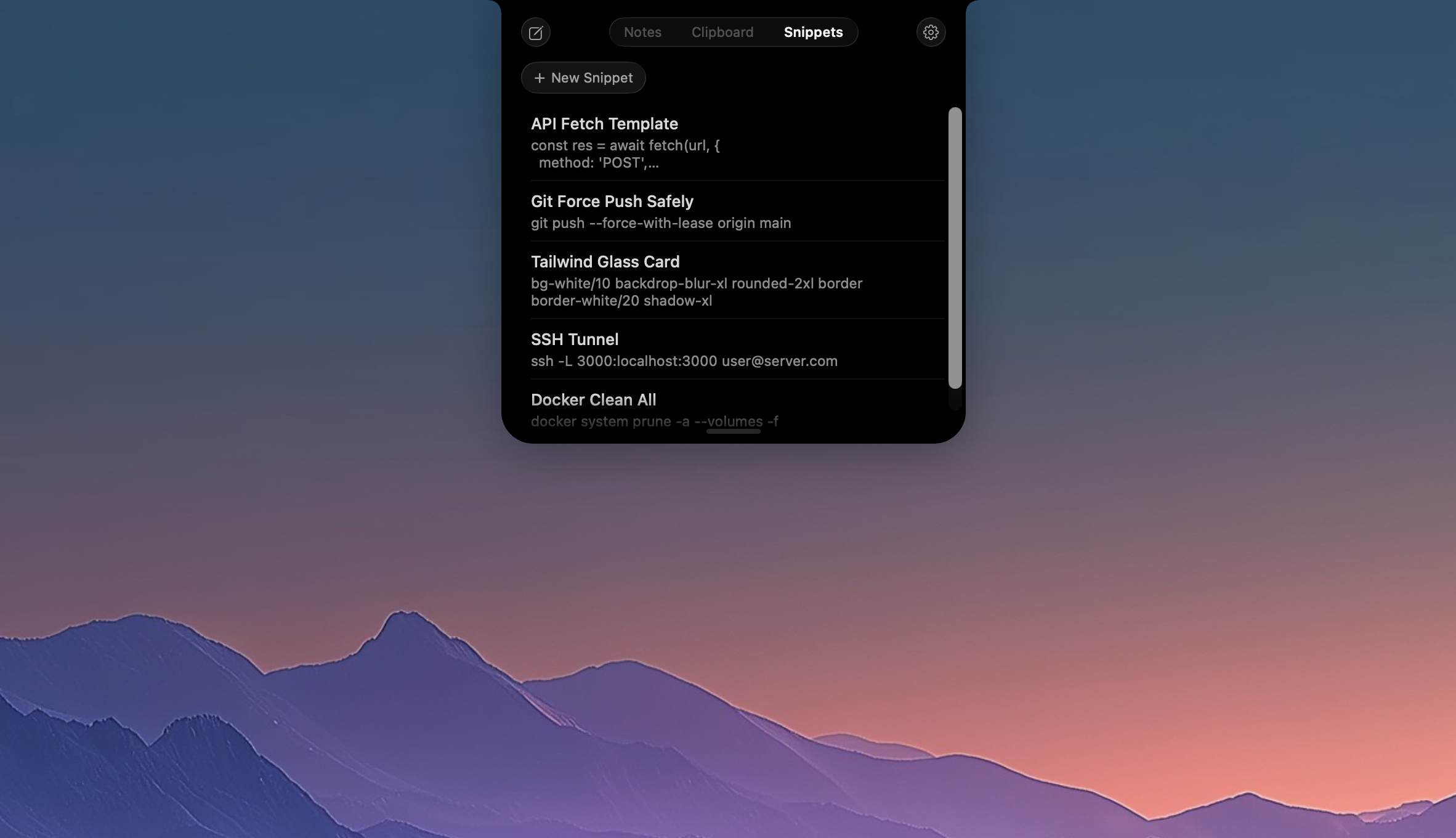

一句话介绍:NotchPad是一款常驻MacBook Pro“刘海”区域的加密记事本与剪贴板管理工具,通过点击刘海快速呼出,解决了用户频繁切换窗口、打断工作流以记录临时信息的核心痛点。

Mac

Productivity

Menu Bar Apps

效率工具

记事本

剪贴板管理

代码片段

macOS应用

刘海屏利用

本地加密

买断制

独立开发

系统集成

用户评论摘要:用户普遍赞赏其创意和设计理念。主要反馈集中在功能细节的完善上,核心关切是剪贴板历史记录的安全性(如对密码管理器内容的自动识别与保护)和自动过期策略,开发者回应已部分实现并会根据用户反馈调整。

AI 锐评

NotchPad的价值远不止于“又一个记事本”,其核心在于对硬件缺陷的创造性转化和对“瞬时记录”场景的精准狙击。它将备受争议的MacBook Pro刘海从一个视觉障碍,重新定义为可交互的、零侵入性的快速入口,这本身就是一次极具洞察力的设计反击。

产品定位清晰且刁钻:服务于那些被频繁Alt+Tab打断深度工作流的专业人士。其“一键呼出,即用即走”的模式,完美契合了记录临时灵感、暂存剪贴板内容、快速粘贴代码片段等高频碎片化需求。AES-256加密与主流密码管理器集成,则是对“本地化”安全承诺的务实加固,旨在打消用户对常驻剪贴板管理器的最大顾虑。

然而,其天花板也显而易见。首先,硬件依赖性强,目标用户群被严格限定在带有刘海的MacBook Pro用户,市场基本盘有限。其次,作为买断制工具,其功能深度(如剪贴板管理的智能分类、跨设备同步、更强大的片段库管理)能否持续进化,是对独立开发者长期投入的考验。用户评论中对安全机制的深入追问,也揭示了工具类应用一旦涉及系统底层和敏感信息,用户信任的建立远比功能炫技更为重要。

总体而言,NotchPad是一款“小而美”的典范,展现了顶级独立开发者对特定平台、特定硬件的深度理解和场景微创新能力。但它更像是一个优雅的“专业补充工具”,而非一个颠覆性的“核心生产力平台”。其成功与否,将取决于在核心场景做到极致体验的同时,能否在有限的用户群体中构建足够牢固的口碑和生态。

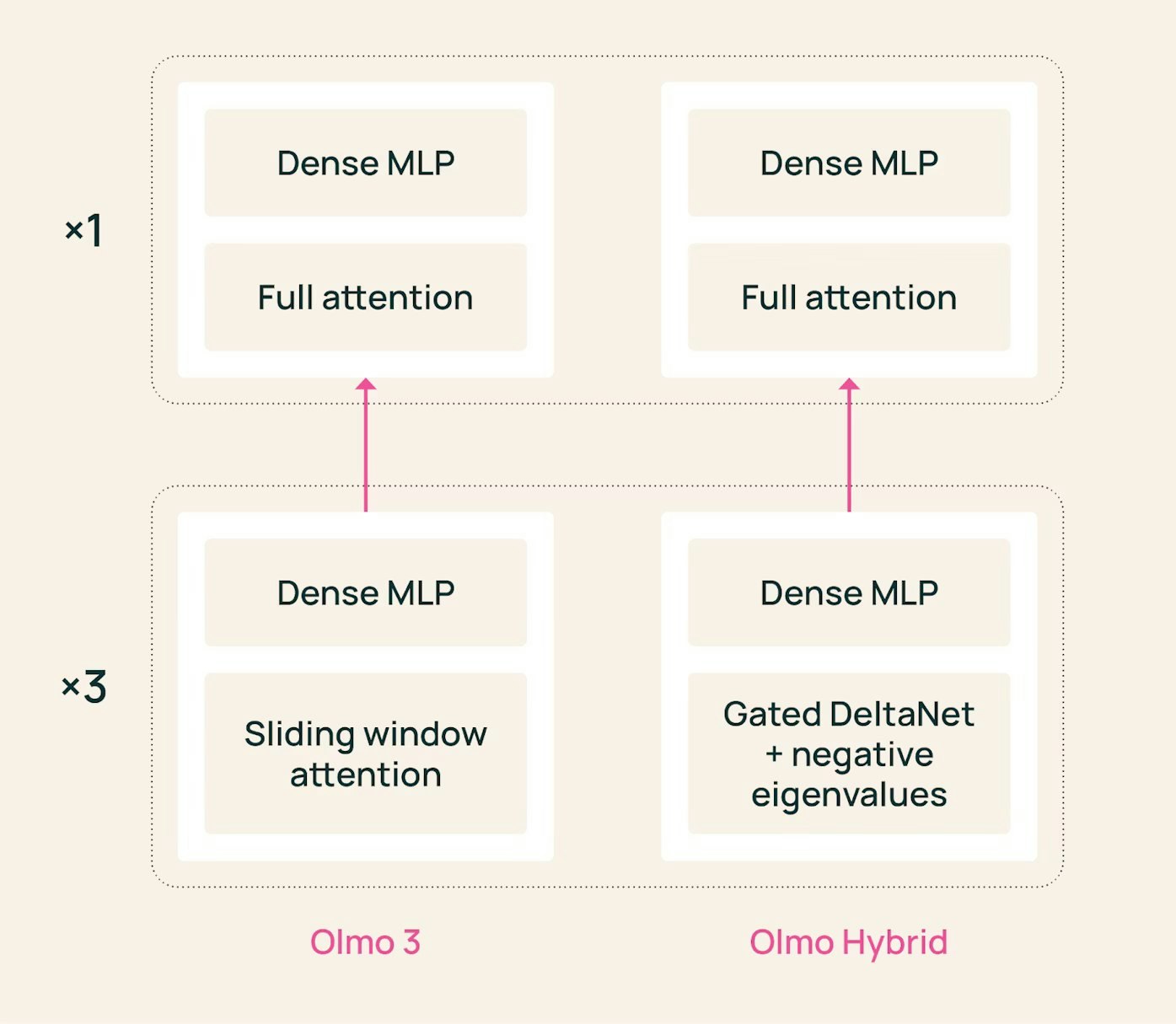

一句话介绍:Olmo Hybrid 是一款结合Transformer注意力与线性RNN层的7B开源混合模型,在保持同等模型大小和训练速度下,以更少的数据量达到同等精度,尤其擅长长上下文任务,为开发者提供了更高效、可本地部署的轻量级AI模型选择。

Open Source

Artificial Intelligence

开源AI模型

混合神经网络架构

Transformer

线性RNN

轻量级语言模型

长上下文处理

本地部署

WebGPU

模型效率提升

Allen AI研究所

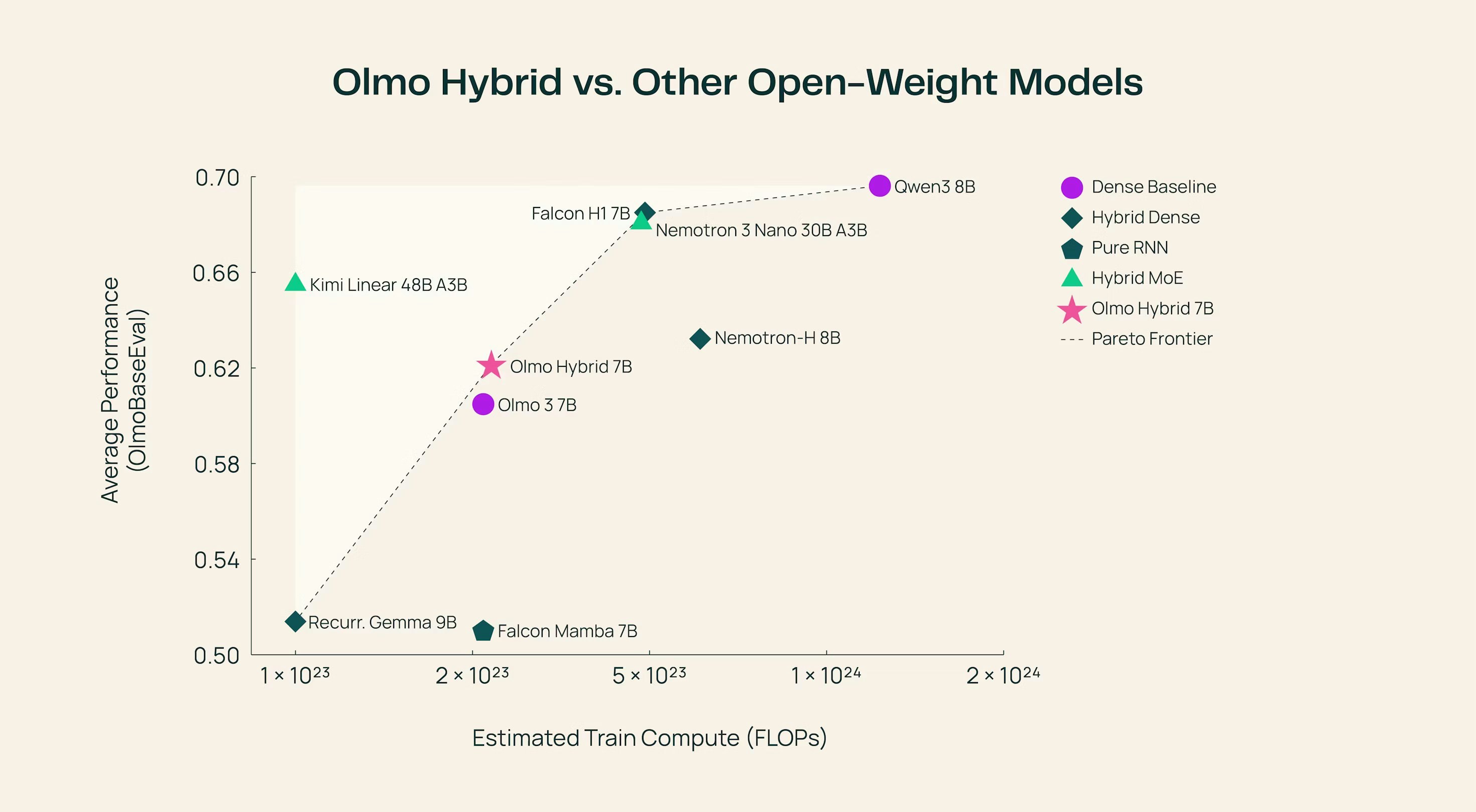

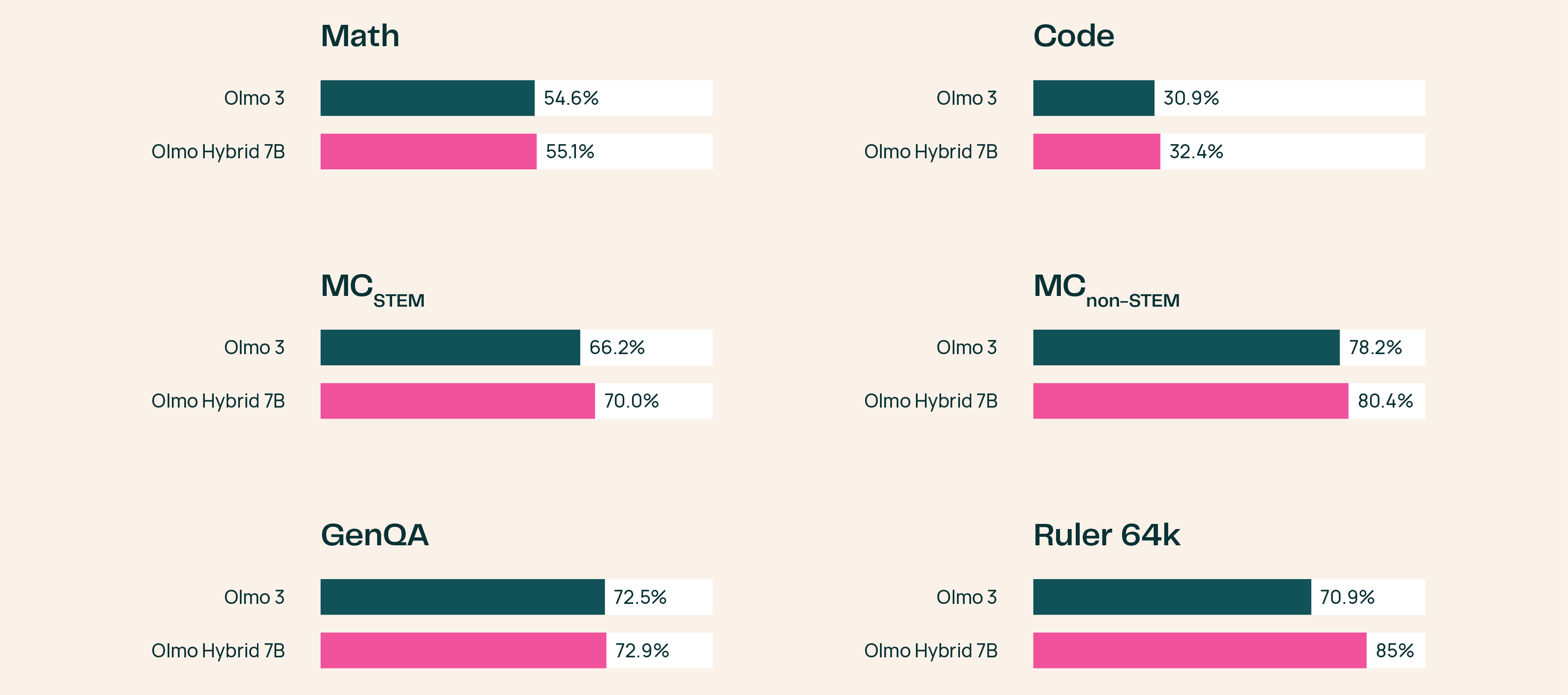

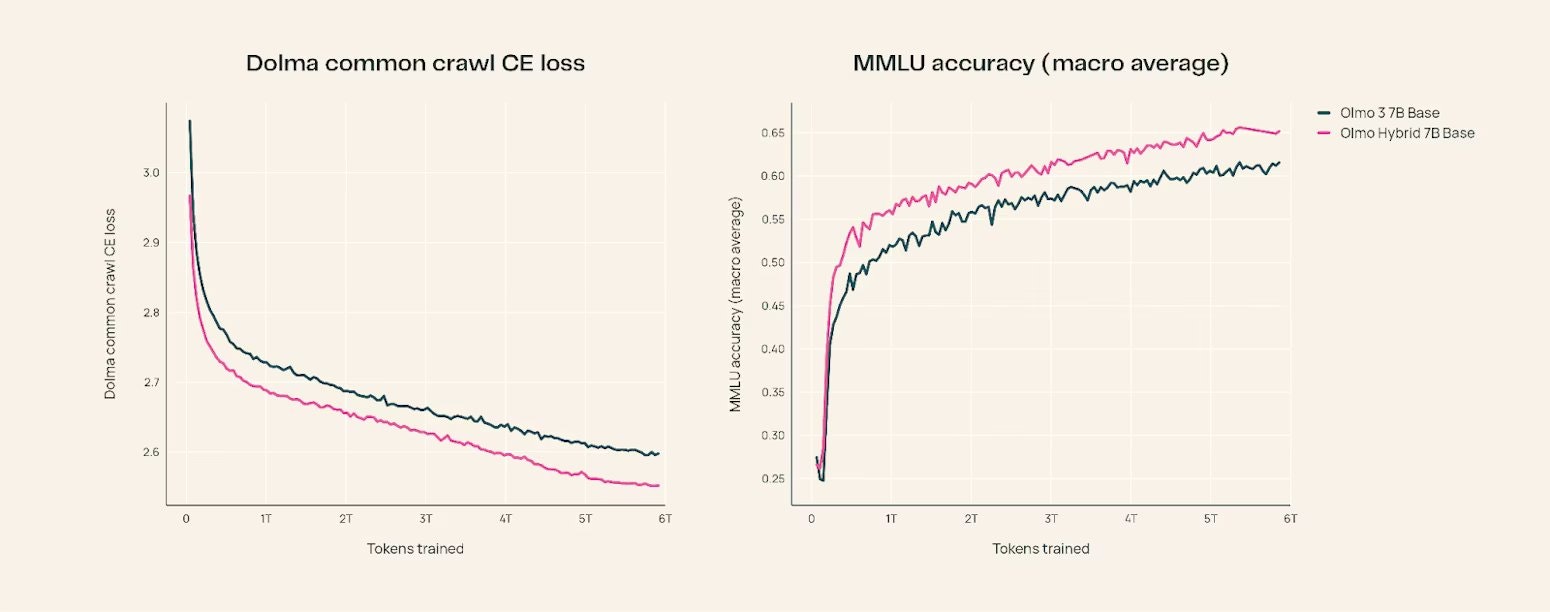

用户评论摘要:评论来自产品团队,强调该模型在公平对比中首次超越纯Transformer基线,以一半数据量达到同等精度,在长上下文评估中表现突出,支持本地浏览器WebGPU运行。无用户问题反馈。

AI 锐评

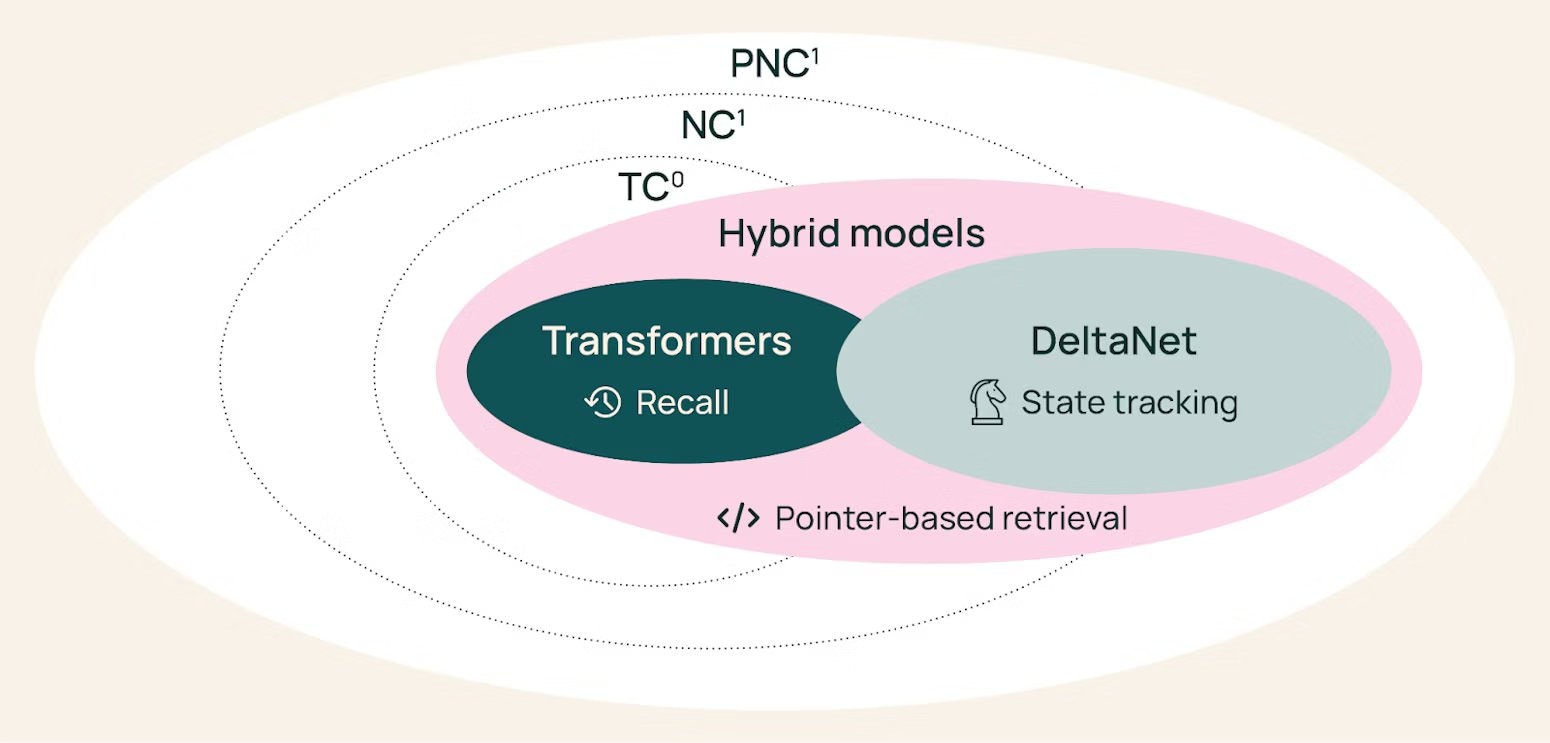

Olmo Hybrid 表面上是一次架构创新,将Transformer注意力与线性RNN以3:1比例混合,但其真正价值在于对当前大模型发展路径的“降本增效”式挑战。在行业疯狂堆参数、卷数据量的背景下,它用“49% fewer tokens”达到同等MMLU精度的数据效率宣言,直指当前大模型训练的成本痛点。

然而,这种“混合架构”并非新概念,其成功关键在于Gated DeltaNet与注意力的具体融合方式能否形成稳定优势。产品强调“公平比较”和“相同训练速度”,试图打消业界对混合架构训练复杂度的顾虑,但评论仅来自团队自身,缺乏第三方基准验证,特别是实际应用场景中的泛化能力存疑。

值得关注的是其“全模型浏览器本地运行”特性,这得益于7B规模与架构优化,将高性能模型推向边缘计算场景。但这也暴露了其定位矛盾:作为研究机构出品,它既想展示架构突破,又强调部署便利性,可能分散技术焦点。

真正的考验在于开源后,社区能否在其“超级干净的权重”基础上,构建出超越纯Transformer的生态工具链。如果只是纸面指标领先,而开发者体验或微调效果不佳,它可能沦为又一个“实验室优胜者”。在Llama主导的开源生态中,Olmo Hybrid需要证明其混合架构不仅省数据,更能开启Transformer之外的新可能性。

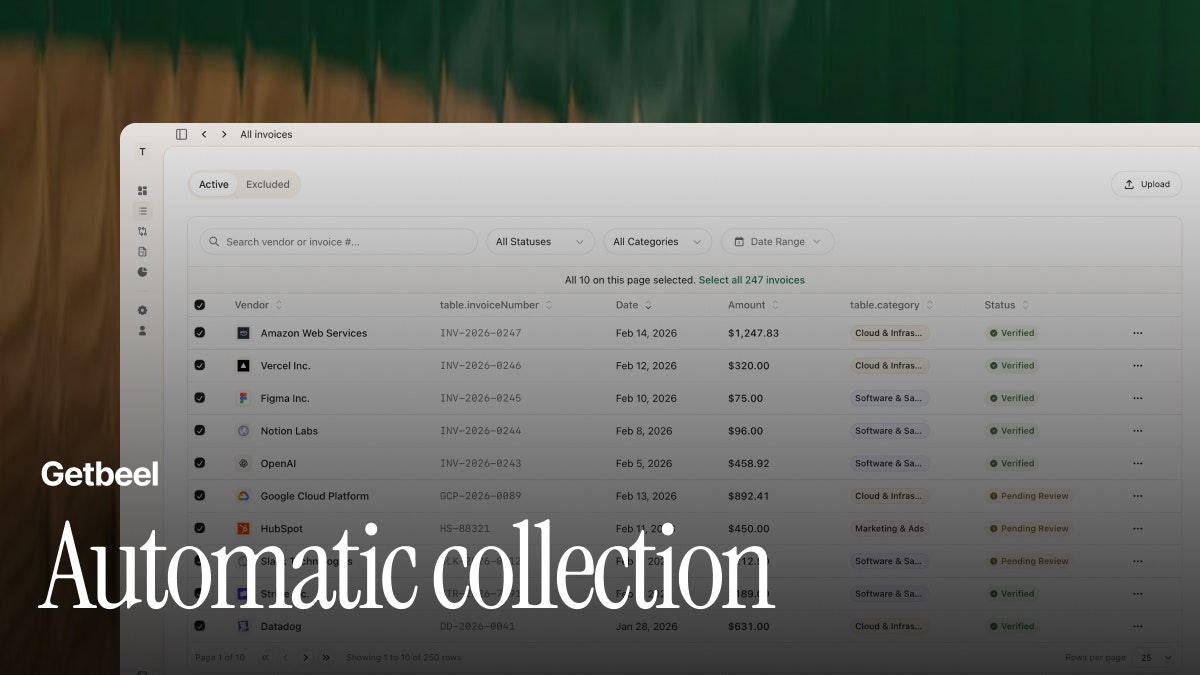

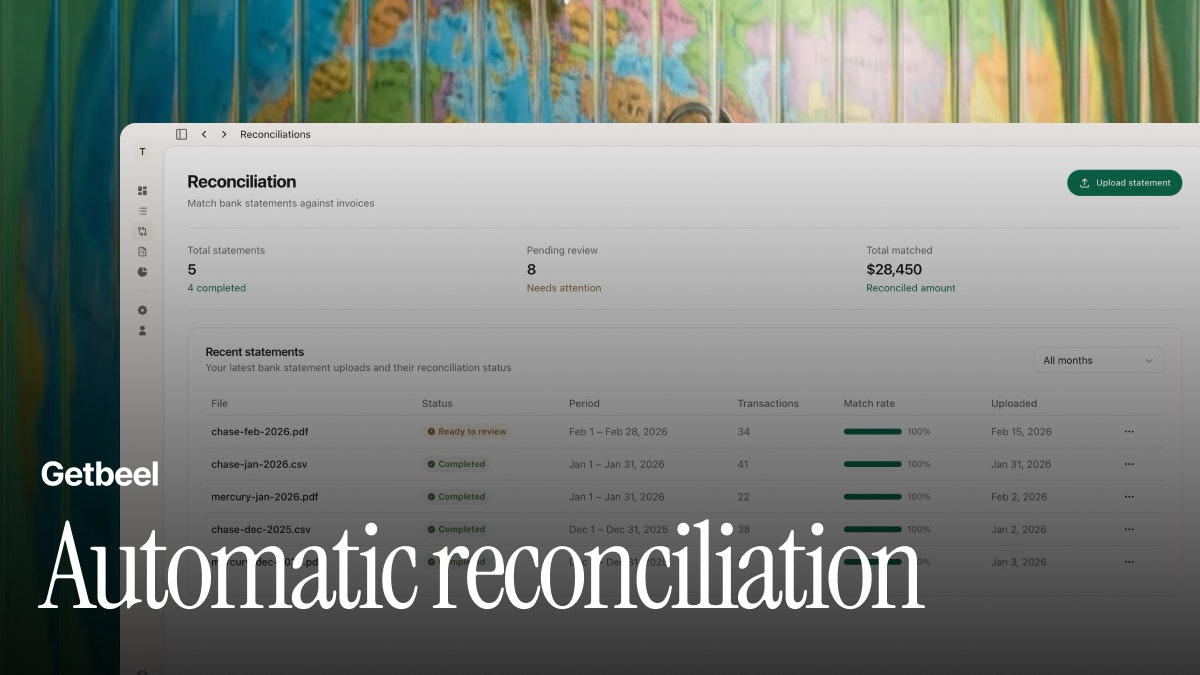

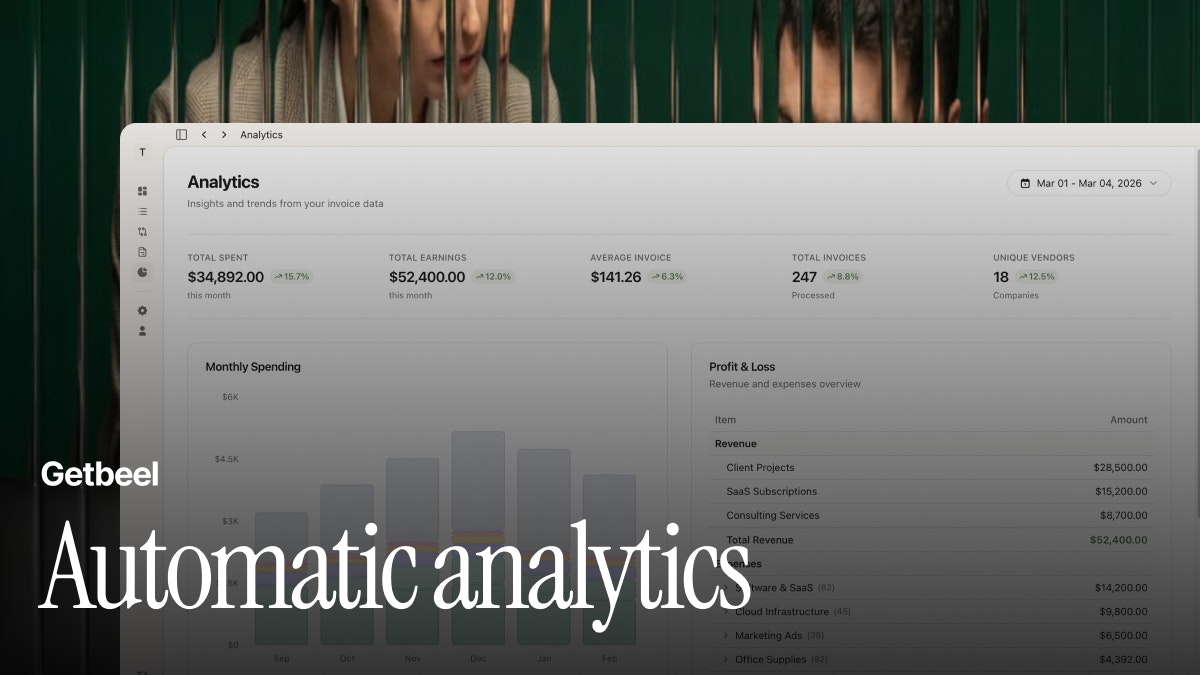

一句话介绍:GetBeel是一款利用AI自动从邮箱(如Gmail)中提取发票并进行对账的工具,解决了企业主和财务人员每月手动收集、整理多供应商发票的繁琐痛点,特别适用于需处理大量SaaS订阅开支和符合特定国家(如意大利)电子发票法规的场景。

Artificial Intelligence

Finance

Accounting

发票自动化

财务对账

AI数据提取

费用分析

SaaS支出管理

意大利电子发票

银行对账

会计工具

邮件处理

中小企业财务

用户评论摘要:用户反馈积极,认可其解决“发票狩猎”普遍痛点的价值。关注点包括:是否支持Outlook等更多邮箱;AI匹配交易的具体逻辑;产品定位是会计自动化工具还是面向创始人的财务可视化层。创始人亲自回复,透露已支持Outlook,并解释了AI对账流程。

AI 锐评

GetBeel看似切入了一个细分工具市场——发票收集与对账,但其真正的锋芒在于它无意中触及了中小企业财务运营的“暗物质”:离散支出的可视化与管理失控。产品从创始人自身痛点出发,用AI替代人工从邮件海洋中打捞发票,这一步已节省大量机械劳动。但其更深层价值在于,通过自动化收集,它天然汇聚了企业全部的订阅和供应商支出数据,从而被动地构建了一个实时、真实的费用分析仪表盘。这使其从一个“合规与对账工具”悄然升级为“财务健康监控系统”。

评论中用户敏锐地指出了这一点:其最强卖点可能并非发票提取本身,而是“自动化月末财务运营”和“财务可视化层”。这揭示了产品的进化潜力。当前版本以意大利市场的强制性电子发票(XML)生成作为差异化壁垒,显示了其从解决通用痛点向攻克特定区域合规难题下沉的能力,这种“通用平台+区域合规模块”的策略可能成为其扩张路径。

然而,挑战同样明显。其核心依赖邮件解析,面对发票格式复杂多变、非邮件渠道发票等情况,AI的准确率与覆盖率将经受长期考验。此外,若定位为“财务可视化层”,则将直面与更成熟的记账软件、支出管理平台的竞争,需要构建更强大的分析洞察和集成能力。总体而言,GetBeel精准地刺中了一个被许多综合财务软件忽视的“前哨痛点”,并以此为抓手,有望向更广阔的财务运营自动化领域渗透。其成功与否,将取决于能否将“被动收集”的优势,转化为“主动洞察”的不可替代性。

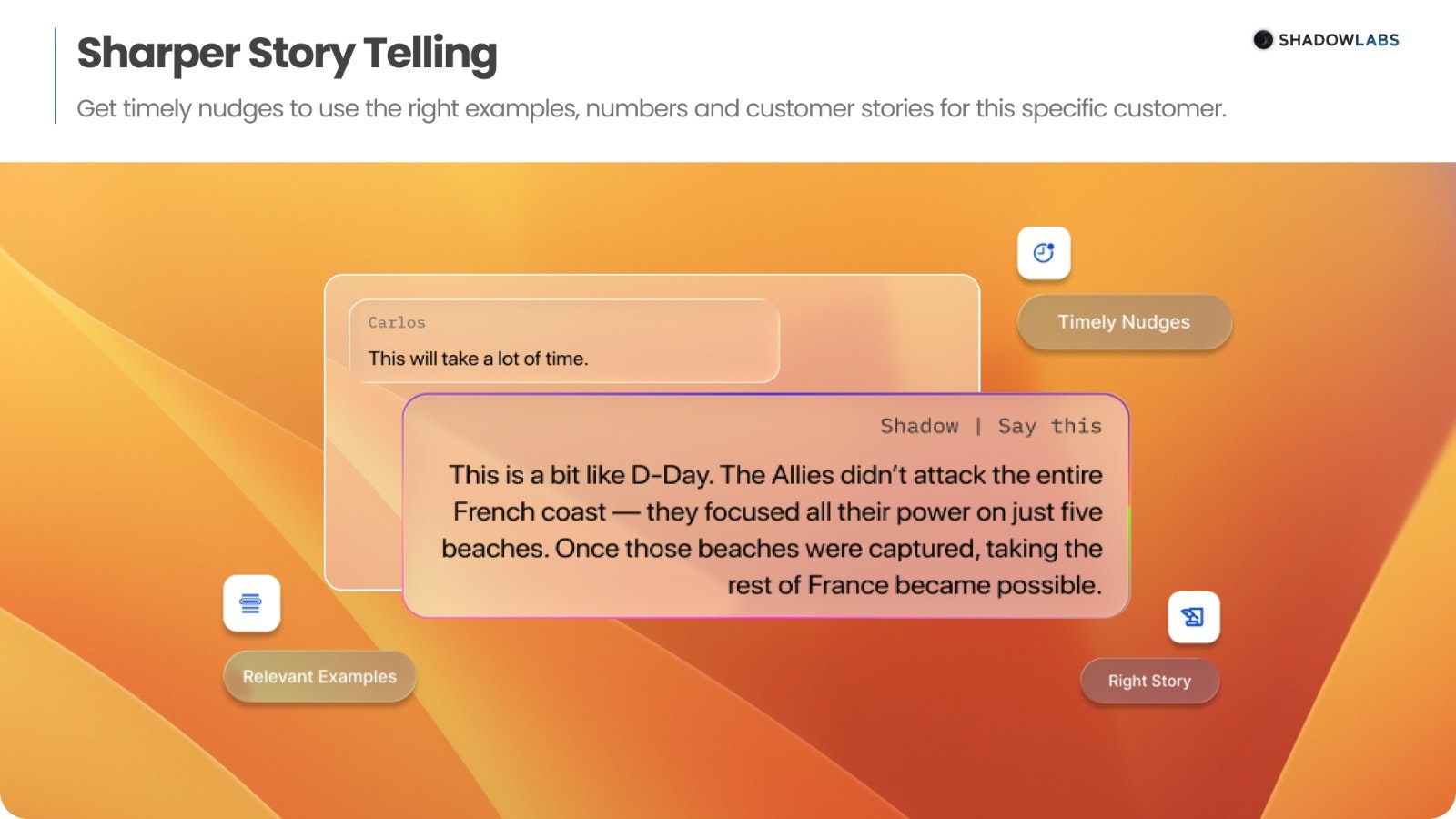

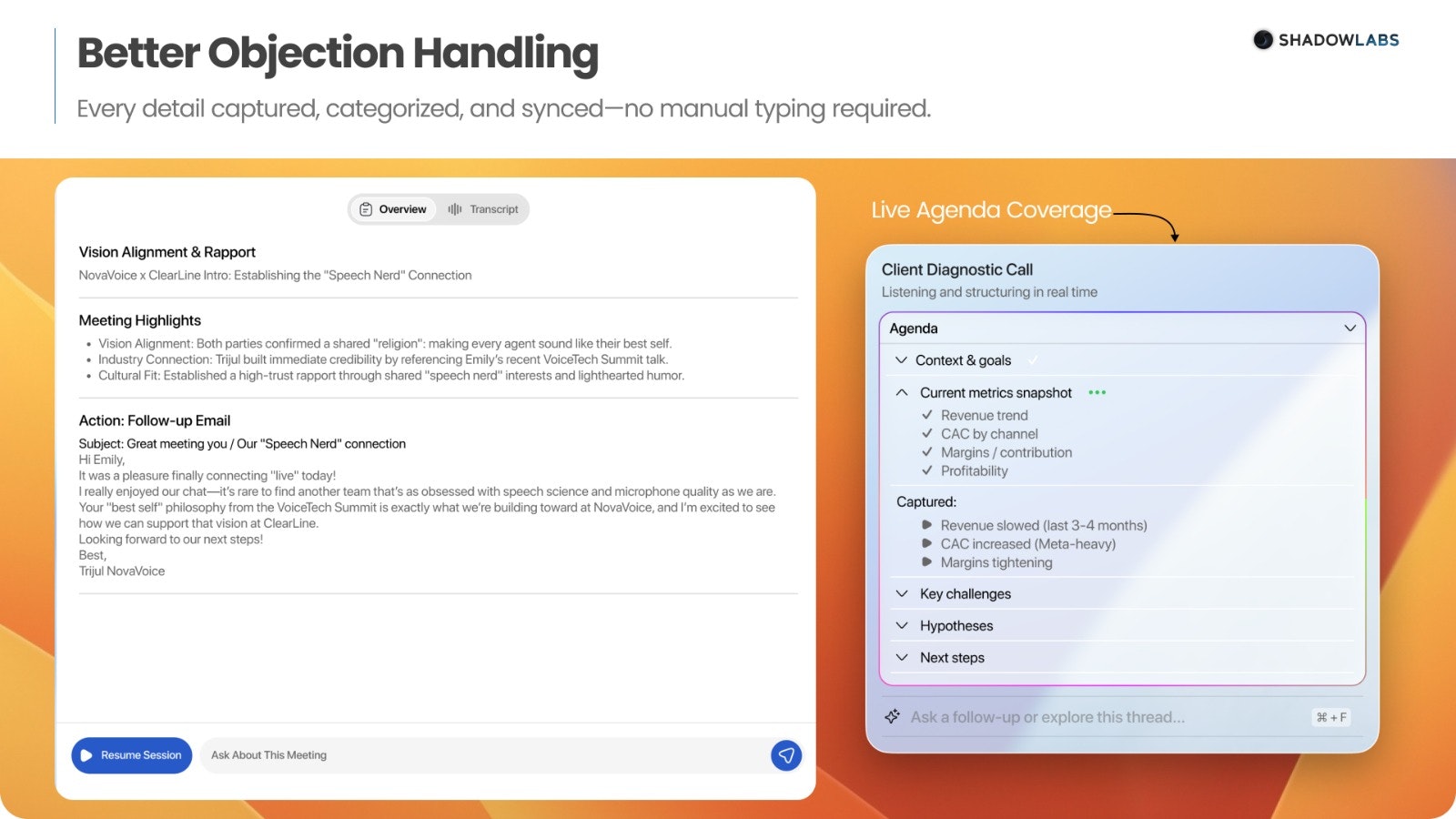

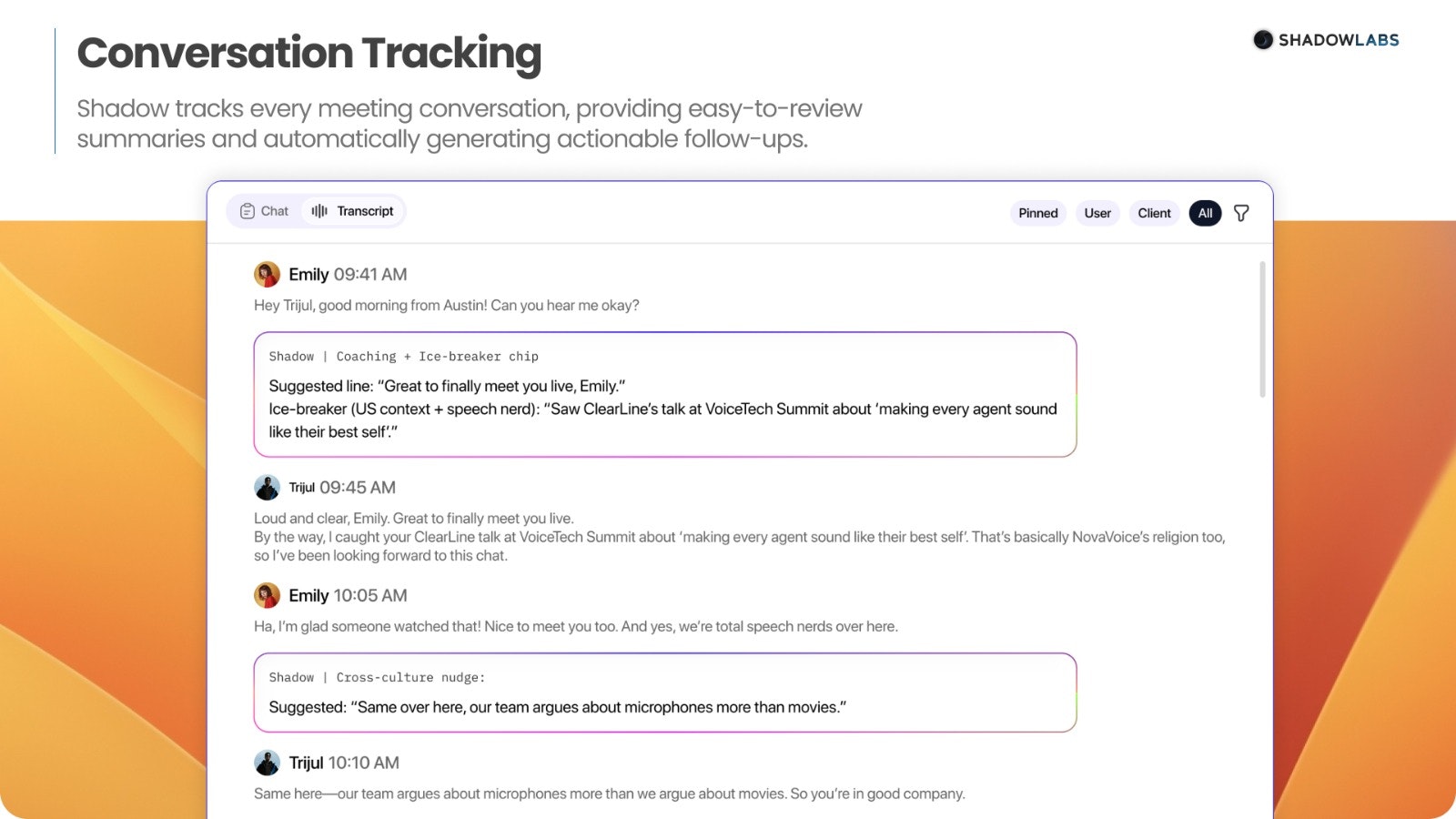

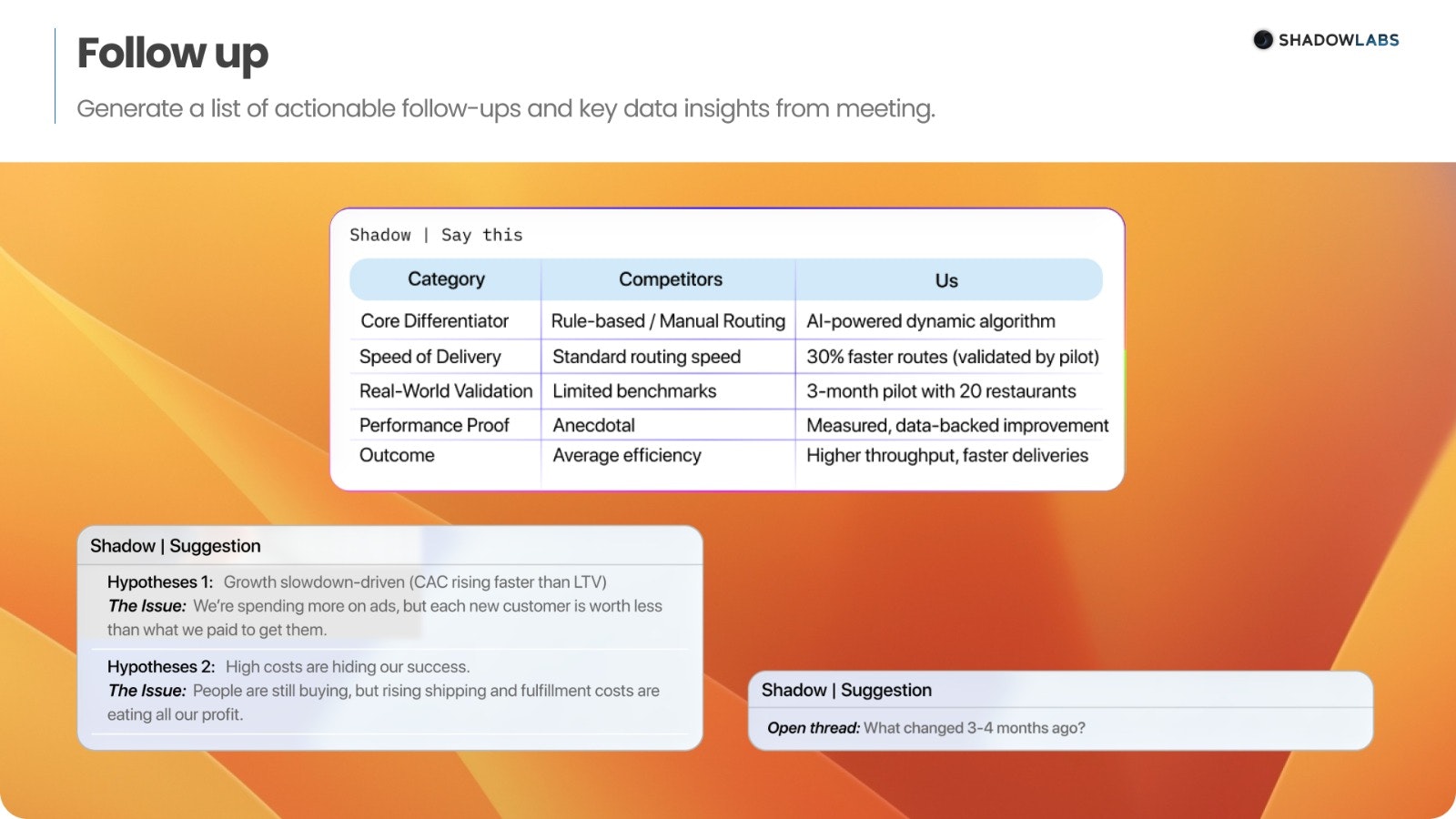

一句话介绍:Shadow是一款实时AI通话助手,在重要会议、谈判等高压力通话场景中,通过实时倾听、前瞻性思考并提供精准提示,解决用户因紧张或信息过载而遗忘关键问题、遗漏细节、缺乏清晰后续行动的核心痛点。

Productivity

Meetings

Artificial Intelligence

AI实时助手

智能会议

通话效率

实时提示

对话增强

生产力工具

高管沟通

战略通话

个人智能体

会议辅助

用户评论摘要:用户普遍认可“实时通话助手”的定位,认为其解决了现有工具只关注会前/会后记录的空白。主要反馈包括:询问定价(已公布Pro版$79/月/用户)、建议增加多语言支持、关注企业级应用可能。开发者回应将先聚焦核心产品,走PLG路线。

AI 锐评

Shadow切入的是一个精巧且高风险的市场缝隙。它避开了已成红海的会议转录与总结赛道,转而聚焦于“通话进行时”这一决策压力最大、信息损耗最严重的实时干预环节。其宣称的价值——“让你在每次通话中都听起来聪明得离谱”——直指知识工作者在高压对话中的表现焦虑与能力瓶颈。

然而,其真正的挑战与价值同样鲜明。第一,技术可靠性是生命线。实时语音转写的准确性、低延迟提示的时机、上下文理解的深度,任何一环的微小失误都可能在关键对话中造成灾难性干扰,这要求产品具备近乎军工级的稳定性。第二,价值感知与隐私顾虑的悖论。产品越“隐形”且有效,用户越依赖;但一个持续监听所有通话的“耳畔幽灵”,必然引发严重的数据安全与隐私拷问,尤其针对其目标客户(高管、战略层)。第三,商业模式与市场定位的张力。$79/月的高定价明确指向高端专业用户,但这部分用户恰恰最挑剔、最保守,且已有成熟的人力助理(如真实助理)解决方案。AI如何证明其价值超越或媲美人类助理,是一道必答题。

本质上,Shadow贩卖的是一种“认知增强”与“表现保险”。它不生产知识,而是优化知识的实时提取与应用。如果成功,它将成为数字时代专业沟通的“防抱死制动系统”;若失败,则只是另一个因无法承受真实场景压力而沦为玩具的AI概念。其成败不在于AI是否聪明,而在于能否在人类最复杂、最非结构化的社交互动——对话中,做到极致可靠与无感融入。这是一场豪赌。

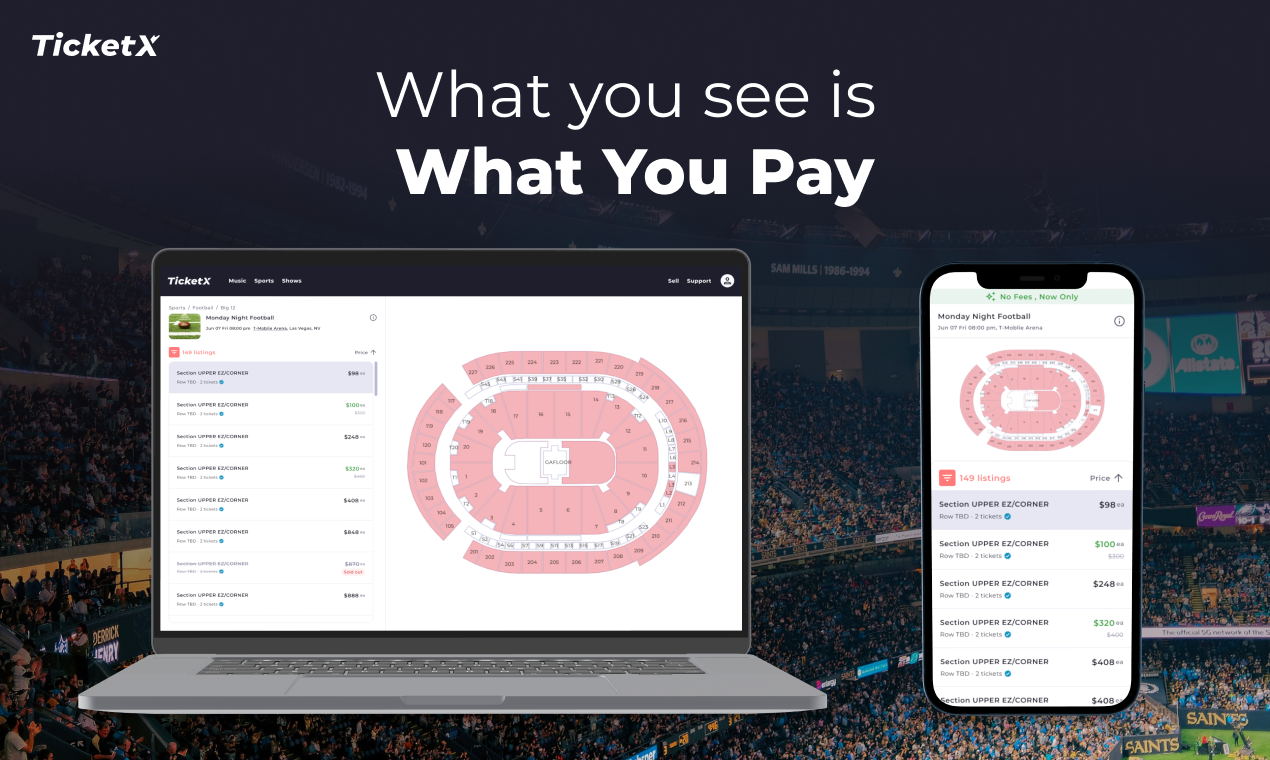

一句话介绍:TicketX是一个主打“无隐藏费用”的票务市场,在用户购买美国、加拿大和日本的音乐会及体育赛事门票时,解决了结账环节价格不透明、遭遇意外附加费的痛点。

Events

Ticketing

票务平台

二级市场

价格透明

无隐藏费用

演唱会门票

体育赛事门票

日本票务

跨境购票

市场差异化

消费者权益

用户评论摘要:用户普遍赞赏其价格透明模式和独特的日本票务资源,认为这解决了购票的核心痛点。有效提问集中在未来是否会拓展其他地区和活动类别,以及平台如何建立和维护用户信任。有用户明确表示会因能便捷购买日本棒球票而向朋友推荐。

AI 锐评

TicketX切入的是一个古老而顽固的痛点:票务市场的“垃圾费”。其“所见即所得”的定价策略,看似简单的功能回归,实则是针对行业潜规则的正面挑战。这并非技术创新,而是商业伦理和用户体验设计的回归,其真正价值在于试图重建极度脆弱的消费者信任。

然而,其模式面临双重拷问。其一,可持续性。当“无隐藏费用”成为核心卖点,意味着平台放弃了传统票务巨大的灰色利润池(服务费、处理费、配送费等),其营收模型必须另寻他路——可能是更高的票面溢价分成,或转向其他增值服务。在供应商主导的票源面前,这种“透明”承诺能坚持多久,将考验其议价能力与战略定力。

其二,差异化壁垒。价格透明极易被模仿,并非长久护城河。其宣称的第二个优势——“强大的日本票务资源”,反而更值得玩味。这揭示了其本质:很可能是日本大型票务转售平台的国际分销前端或战略孵化项目。这既是优势也是局限。优势在于拥有稳定的稀缺票源,特别是在全球粉丝追捧的日本演艺及体育赛事领域,形成了独特的供给壁垒。局限则在于,其基因可能更偏向于一个“渠道”而非“平台”,在拓展北美等成熟市场时,将直面StubHub、Ticketmaster等巨头的碾压,其日本资源在非日本市场吸引力有限。

因此,TicketX的真实故事可能不是要成为全球票务巨头,而是成为一个“垂直跨境票务专家”,特别是在日本文化内容输出的浪潮下,精准服务于全球的日本文化消费需求。它的成功与否,不在于能否消灭隐藏费用,而在于能否将“可信赖的日本票务入口”这一心智牢牢植入国际消费者心中,并在此基础上谨慎构建其商业模式。当前的低投票数(20)也反映出,在Product Hunt这类泛科技社区,其垂直属性可能尚未激起广泛共鸣,真正的战场应在粉丝社群之中。

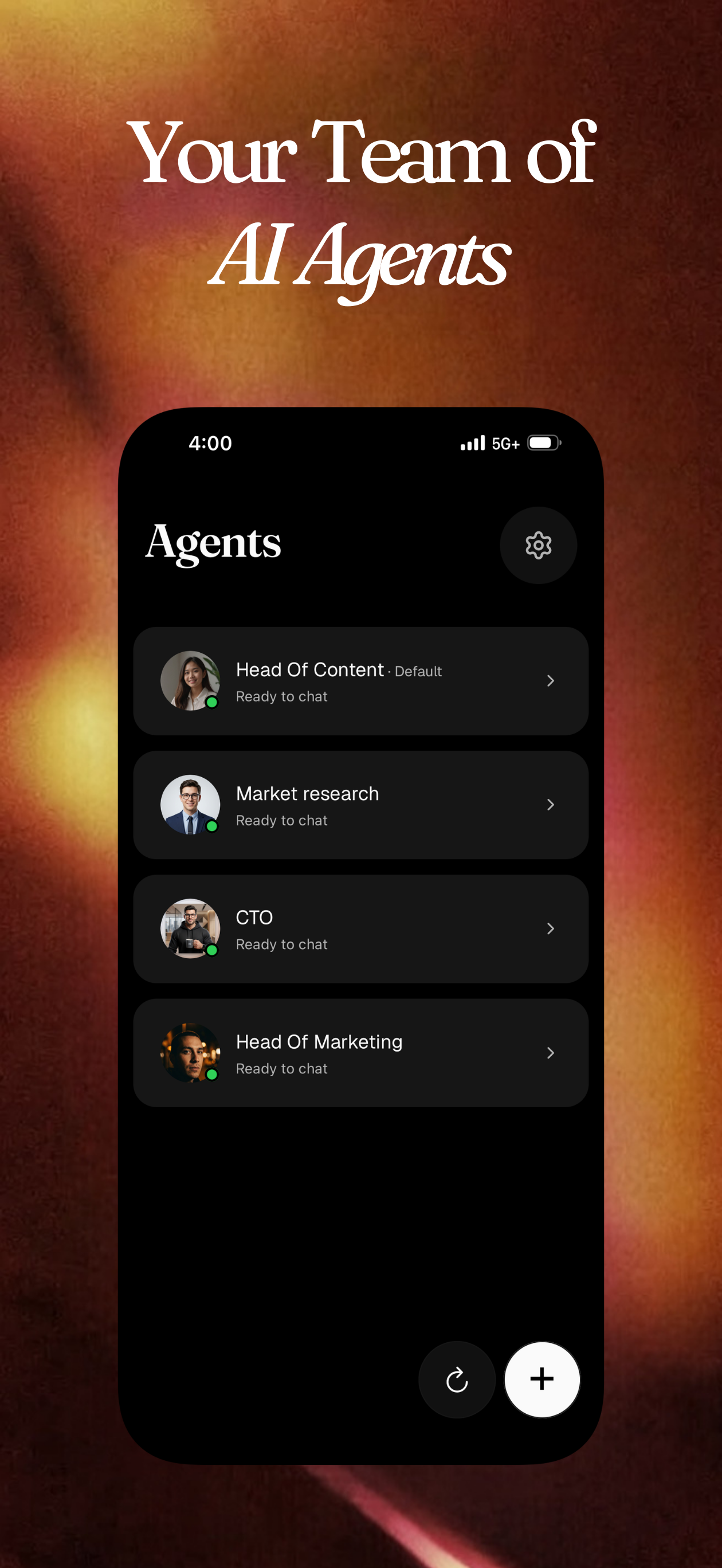

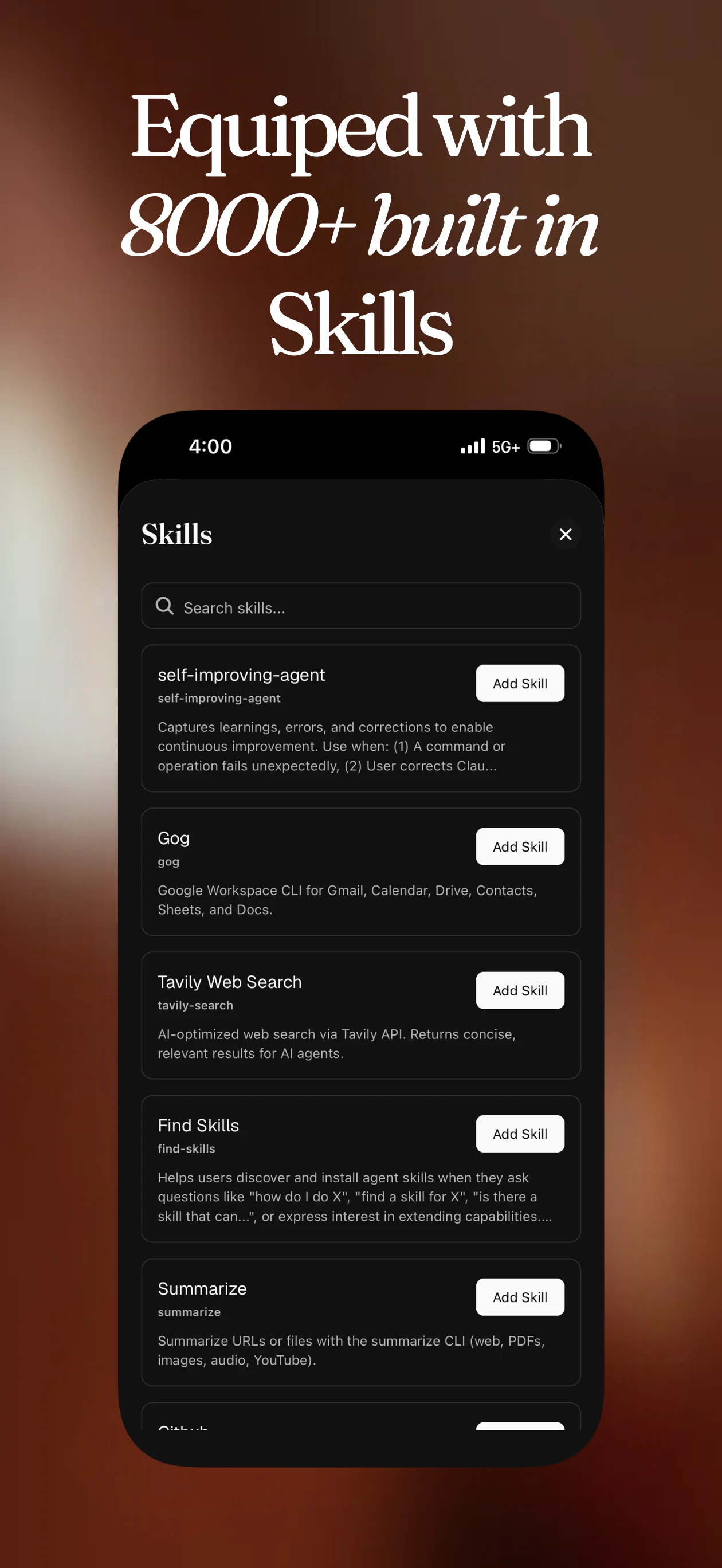

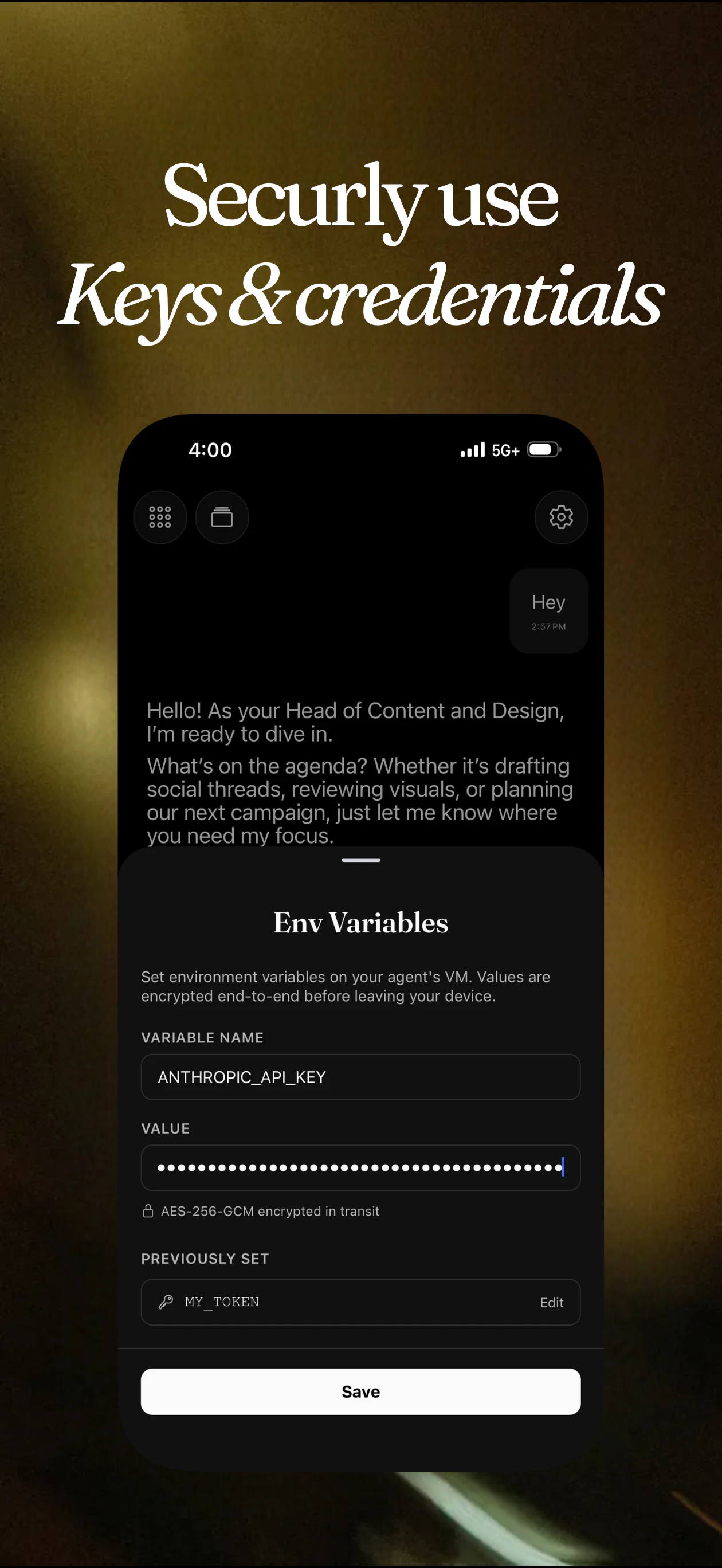

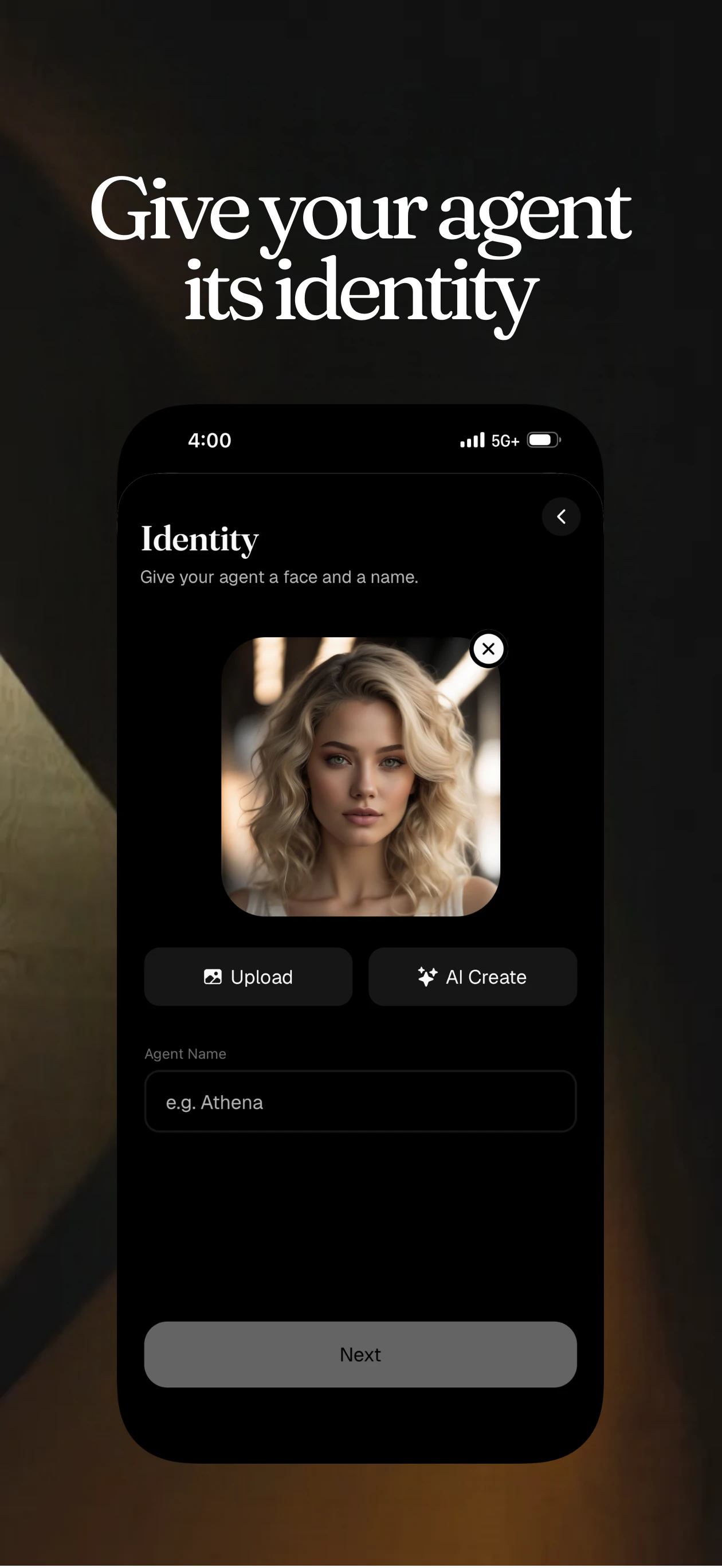

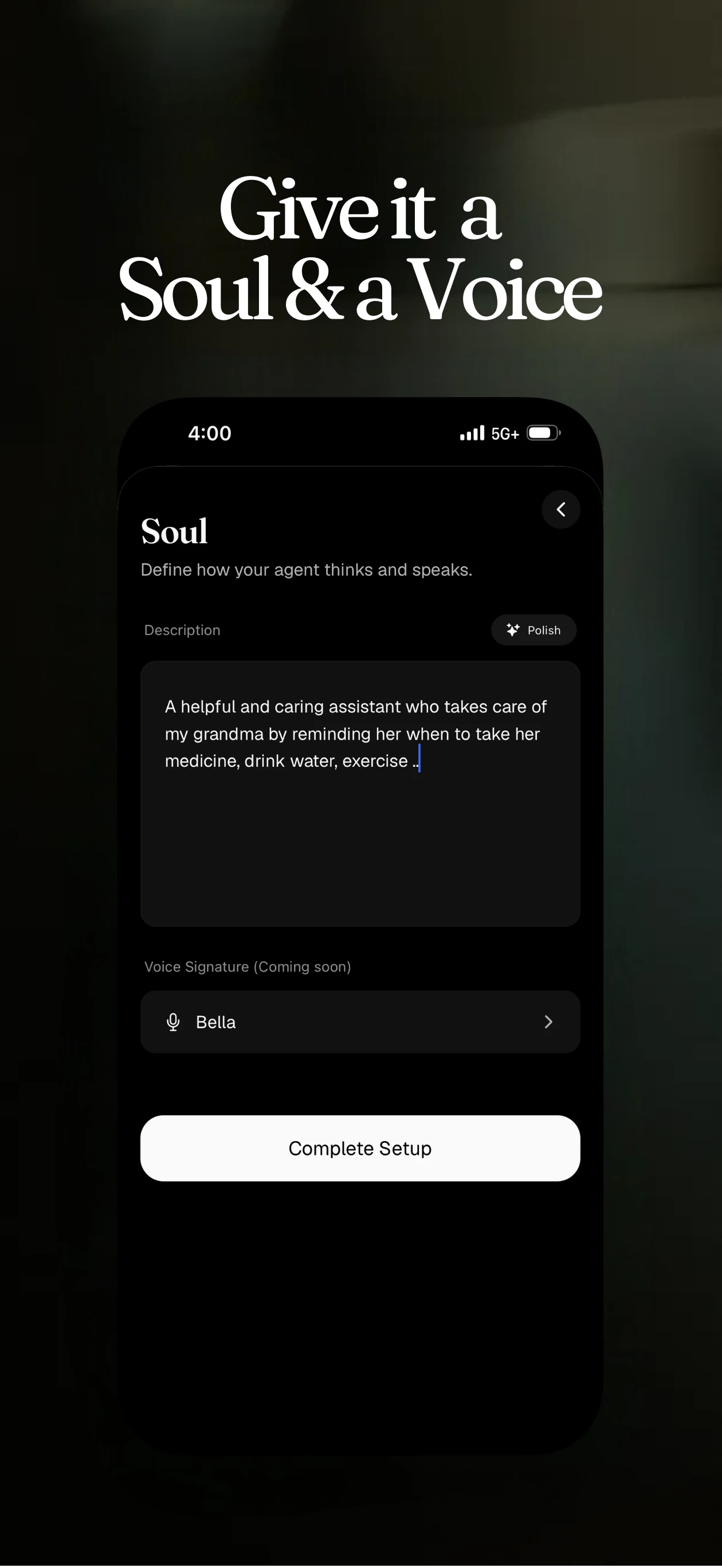

一句话介绍:Gwal是一款移动端AI智能体平台,允许用户从手机快速创建、部署和管理多个可定制、可协作的AI智能体,旨在将手机变为个人AI工作队的指挥中心,解决用户在移动场景下需要灵活、集成化AI助理能力的痛点。

Productivity

Task Management

Artificial Intelligence

AI智能体平台

移动端优先

多智能体协作

无代码开发

云端部署

技能集成

个性化定制

自动化工作流

生产力工具

AI workforce

用户评论摘要:创始人亲自介绍产品理念,强调其移动优先和多智能体协作的差异化定位。有用户询问其与竞品(如OpenClaw)的相似性,创始人回复澄清Gwal更侧重于移动端和作为多智能体的云端指挥中心。

AI 锐评

Gwal提出的“口袋里的AI军团”概念,精准切中了当前AI Agent领域一个显著的空白:真正的移动原生与用户侧集中管控。当前多数AI Agent工具或依附于Discord等聊天平台,或局限于开发环境,实质是将用户“拉入”AI的运作场景。Gwal反其道而行,试图将AI的调度权真正交还到用户最贴身、最即时的设备——手机上,这是一个值得肯定的场景洞察。

然而,其宣称的价值面临多重考验。首先,“在手机上管理”与“用手机创造”存在巨大体验鸿沟。在狭小屏幕上进行智能体的复杂定制、技能编排与工作流设计,其操作效率和体验能否媲美甚至超越桌面端,是一个巨大的产品设计挑战。其次,其核心价值“多智能体协作”目前仍是一个愿景性功能,评论中并未展示具体用例。如何让智能体间实现稳定、可靠、有价值的协作,而非简单的任务接力,是技术上的深水区。最后,集成8000+技能更像是一个营销数字,关键不在于数量,而在于与移动场景深度结合的高频、刚需技能有多少,以及连接这些API的安全和易用性能否经得起普通用户的考验。

总体而言,Gwal展示了一个诱人的未来图景:手机作为个人数字世界的AI中控台。但其从“移动部署管理器”到“智能协作网络”的飞跃,还需在交互设计、协作逻辑和场景深耕上拿出更扎实的解决方案。当前版本更像是一个移动友好的Agent部署门户,其宣称的“军团”作战能力,仍有待实战检验。

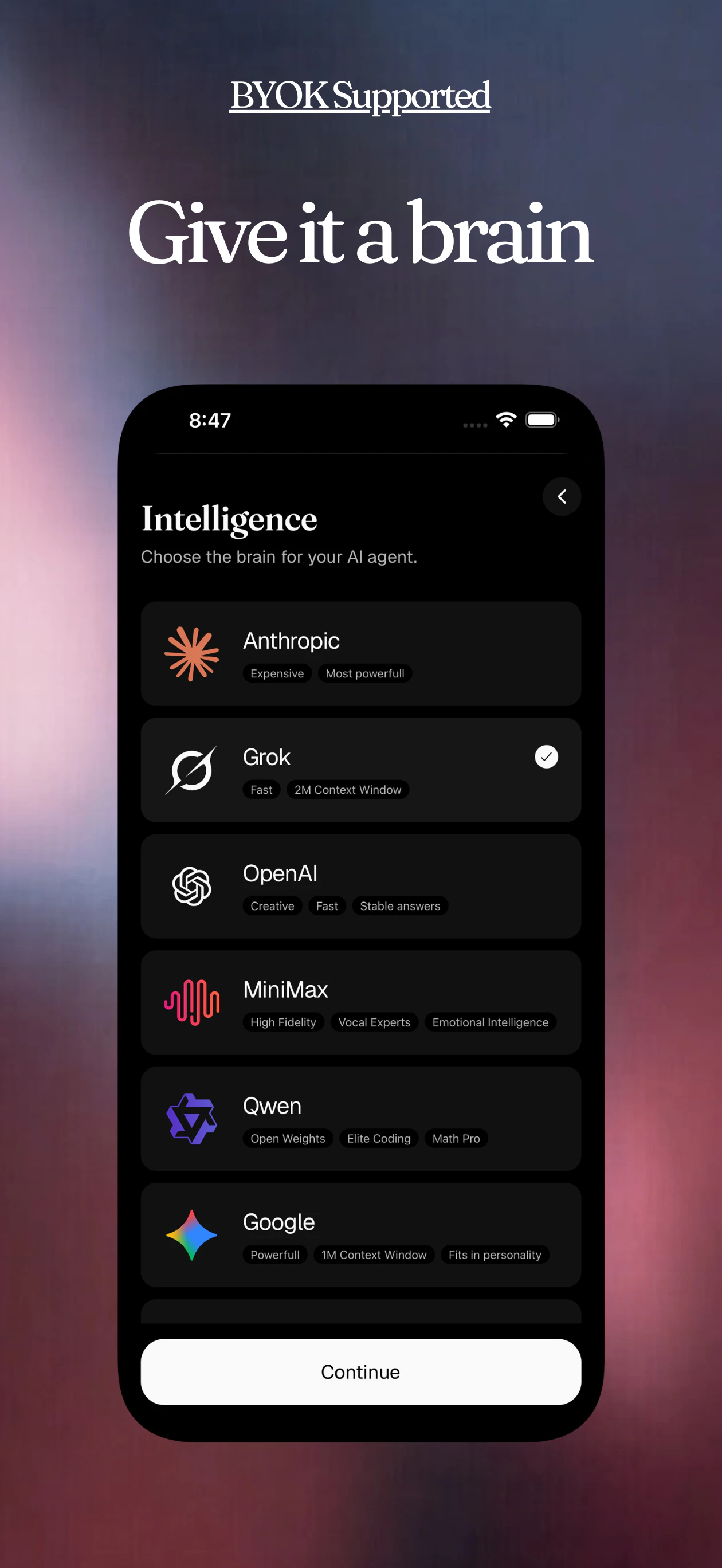

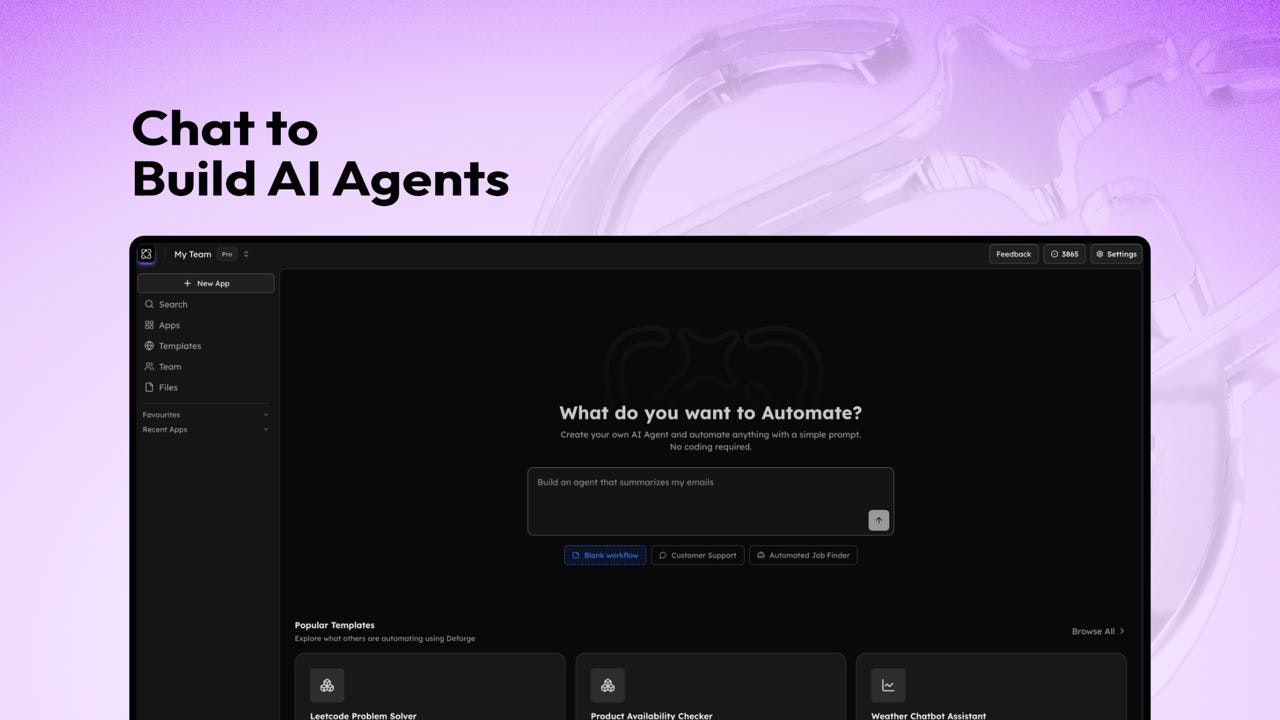

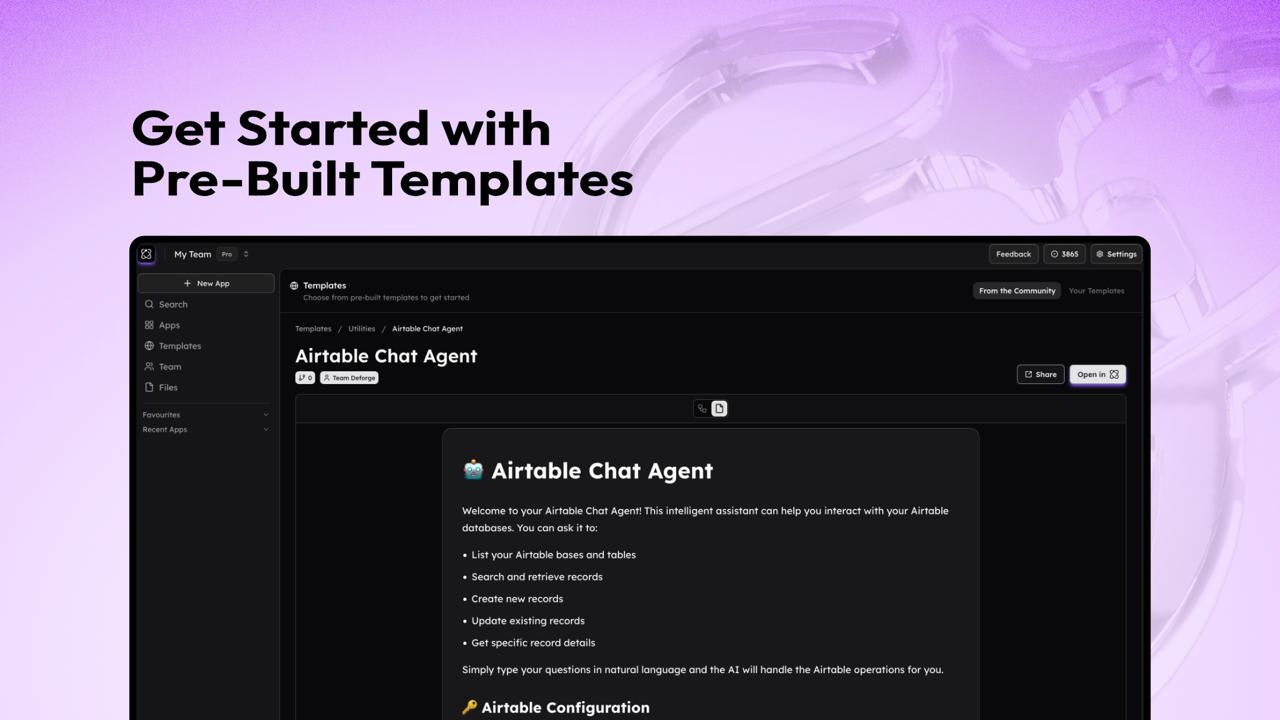

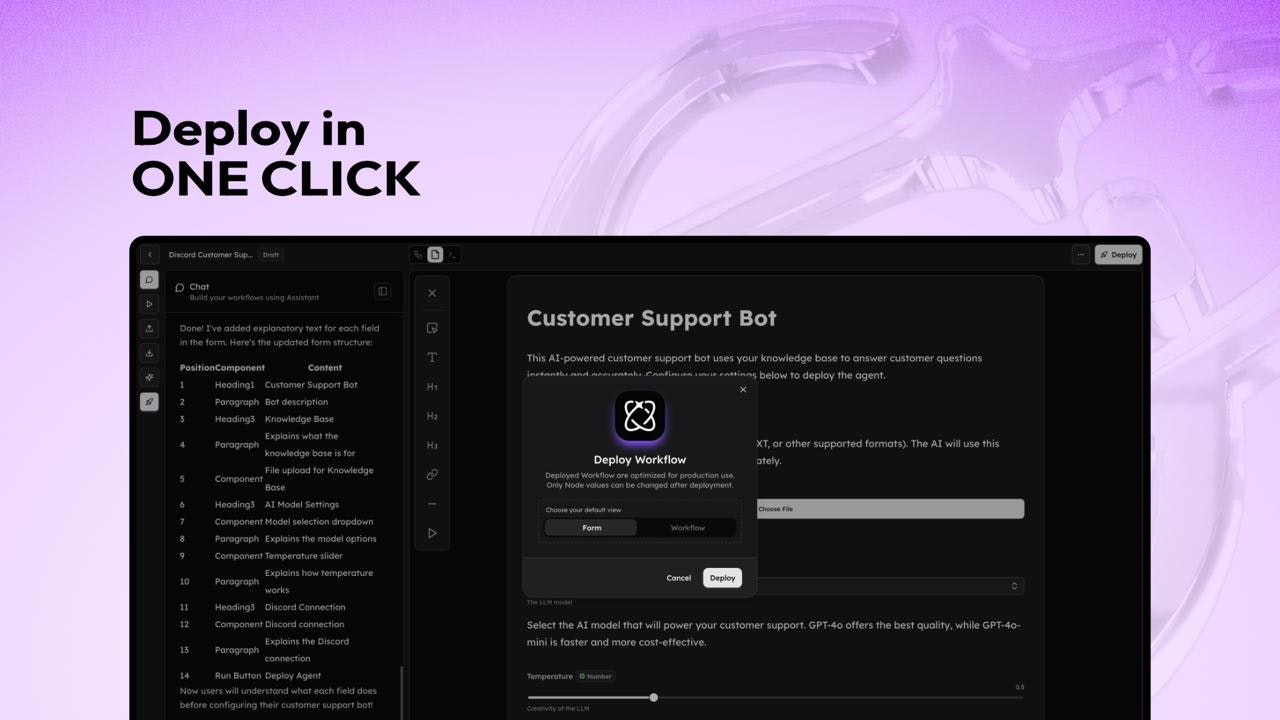

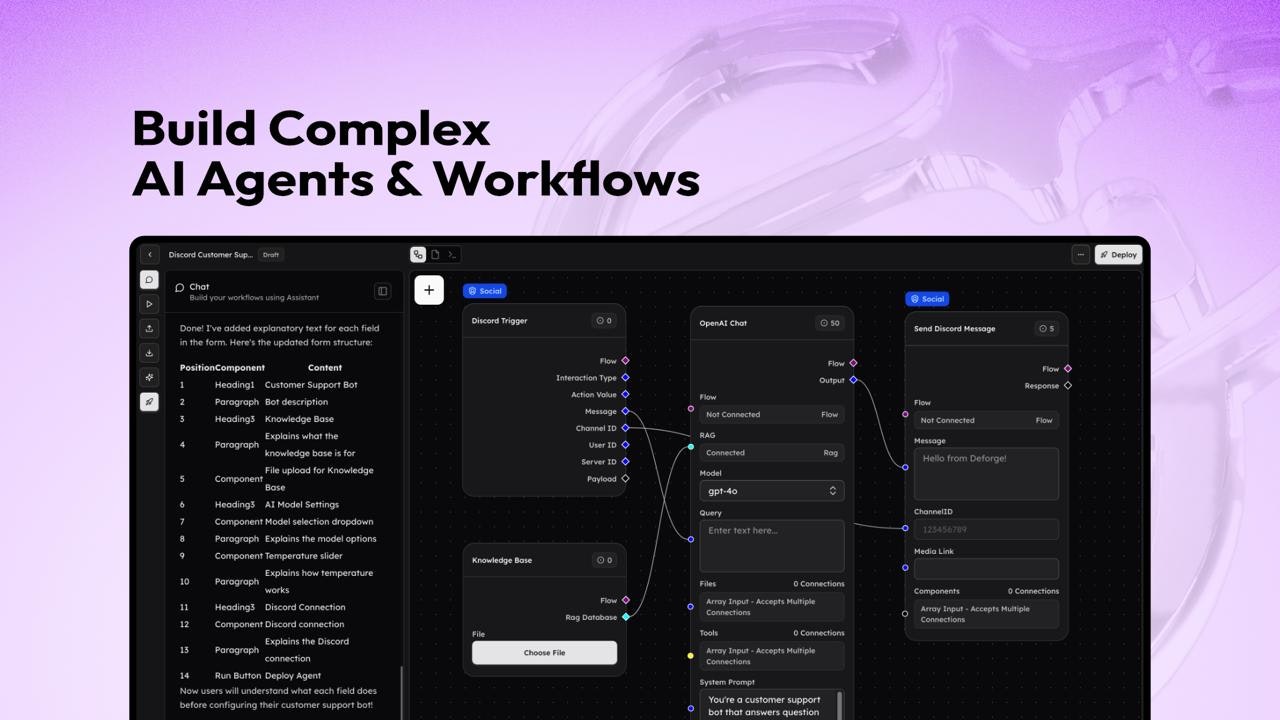

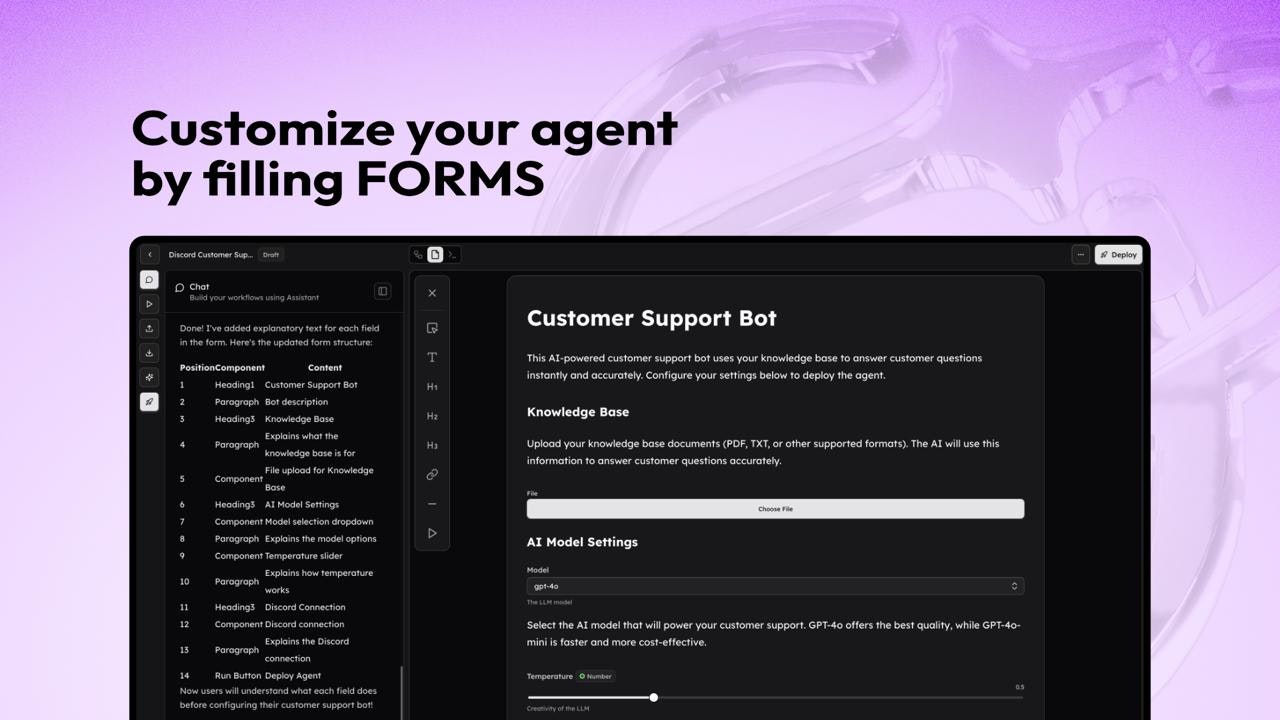

一句话介绍:Deforge是一款无代码AI智能体构建平台,通过“对话式构建”功能,让用户能用自然语言描述需求,自动生成工作流,解决了非技术用户在创建复杂AI代理时面临的高门槛和配置繁琐的核心痛点。

SaaS

Artificial Intelligence

No-Code

无代码开发平台

AI智能体构建

对话式交互

工作流自动化

多模型支持

可视化编程

生产力工具

AI应用开发

自然语言编程

智能体部署

用户评论摘要:有效评论主要为创始人发布的产品更新公告。重点介绍了“对话构建”、UI/UX重构、架构升级与多模型支持四大核心更新,旨在解决早期版本中“无代码仍显复杂”的用户痛点,并积极邀请社区反馈。

AI 锐评

Deforge以“AI智能体的Canva”为标语,其真正价值不在于简单地提供一个可视化拖拽界面——这已是红海,而在于其激进地试图用“Chat to Build”将自然语言直接编译为可执行的智能体逻辑。这步棋若走得扎实,将把智能体构建从“图形化配置”时代推向“意图驱动”时代。

然而,其面临的挑战同样尖锐。首先,“用聊天构建复杂逻辑”本身是个“模糊需求工程”的AI难题,描述与预期结果的偏差如何精细调整?平台仍需暴露底层节点供高级用户调试,这与其“去复杂化”的初衷构成内在矛盾。其次,其价值高度依赖于对海量第三方工具和数据的深度集成能力,这本质上是生态战争,而非单纯的产品优劣。最后,“多模型切换”听起来美好,但实际需要用户具备对各模型能力边界的深刻认知,否则只是增加了选择负担。

当前版本更像是一个宣言,展示了用自然语言作为最高级编程语言的未来图景。但能否从“演示惊艳”走到“稳定可靠的生产力工具”,取决于其AI理解逻辑的深度、工作流调试的精细度以及生态构建的速度。在AI智能体平台混战中,它选择了一条最具颠覆性但也最艰险的道路。

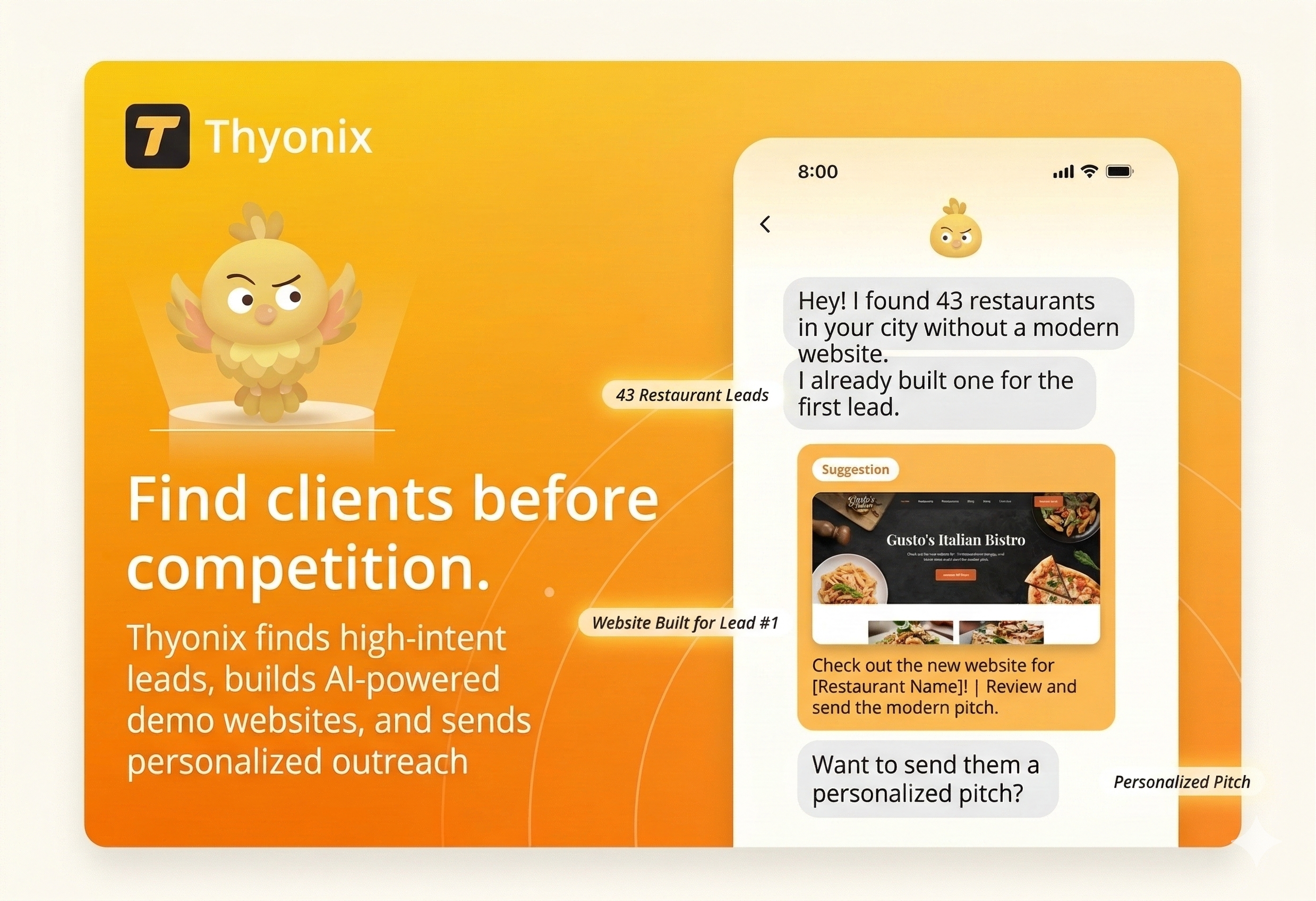

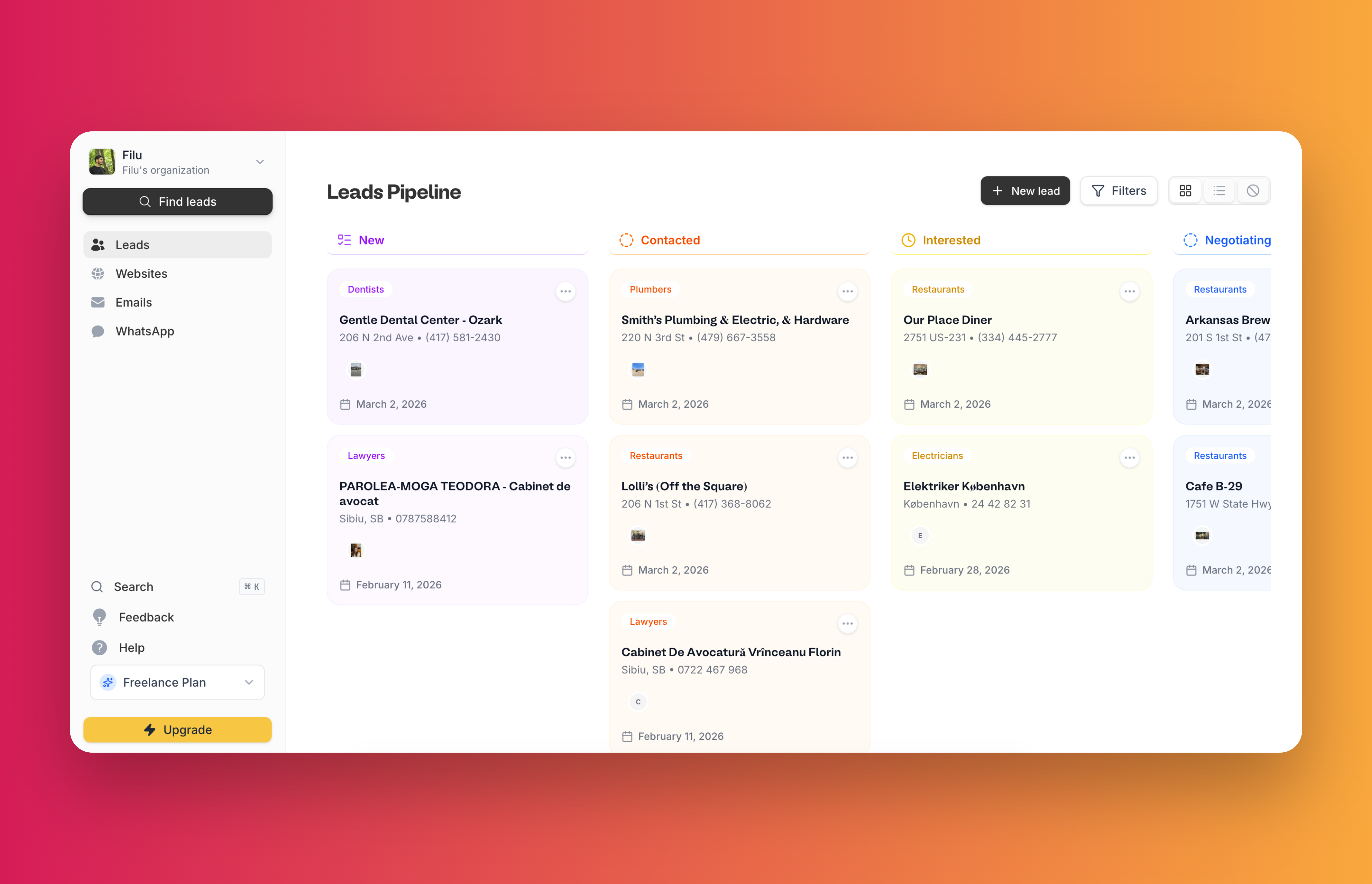

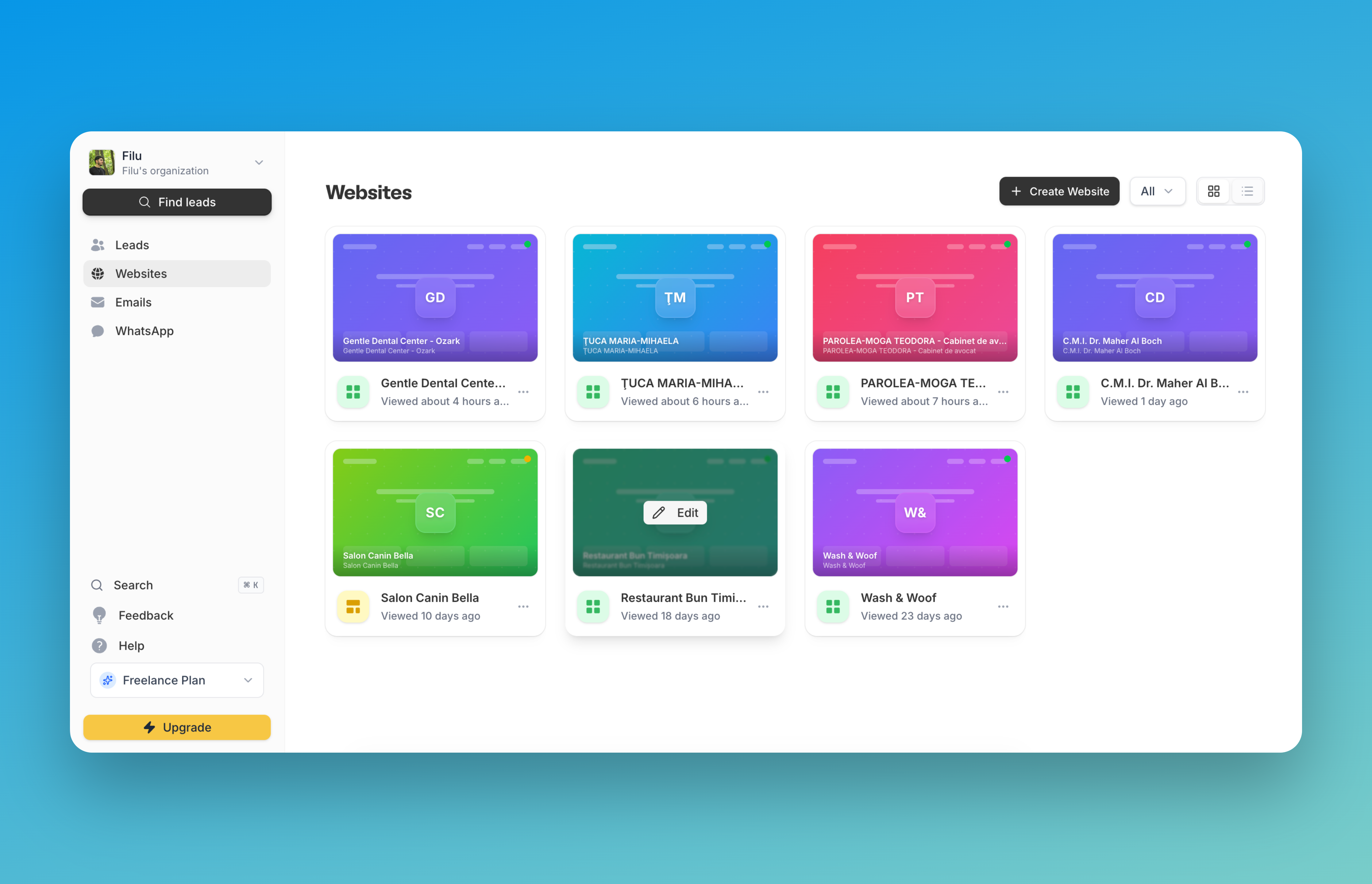

一句话介绍:Thyonix 是一款为网页设计机构和自由职业者打造的销售工具,通过AI自动为尚无网站的本土企业生成可工作的演示网站并主动发送个性化销售提案,在初次接触前就解决客户“无法可视化最终成果”的核心顾虑,从而大幅提高成交率。

Freelance

Artificial Intelligence

Web Design

AI建站

销售自动化

潜在客户开发

网页设计机构

自由职业者工具

B2B销售

本地企业服务

提案生成

效率工具

用户评论摘要:用户反馈主要集中于产品概念的赞赏(解决可视化痛点、流程巧妙)和功能细节的确认(生成的是否为可工作的真实网站)。开发者回复澄清其生成的是功能完整的落地页,可绑定域名和导出代码。另有用户寻求关于早期SaaS产品健康度追踪的交流。

AI 锐评

Thyonix 的本质并非一个颠覆性的建站工具,而是一个精准的“销售杠杆”和“焦虑缓解器”。它巧妙地绕过了传统网页设计销售流程中最脆弱的一环——客户因想象成本过高而在提案阶段流失。其真正价值不在于AI生成网站的技术深度(这已是红海),而在于将“建站”这一交付动作,前置为“获客”的破冰利器。

产品逻辑犀利地抓住了B端销售的人性弱点:当竞争对手还在撰写千篇一律的冷邮件时,Thyonix用户已携一个量身定制的、可交互的解决方案登场。这瞬间将销售对话从抽象的“我能为你做什么”转变为具体的“这就是为你做的”,极大提升了客户的投入度和信任感,将销售人员的角色从“说服者”转变为“确认者”。

然而,其商业模式存在明显的“自噬”风险与天花板。首先,它高效挖掘的是“无网站本地企业”这一存量且快速萎缩的市场。其次,其成功可能加速该市场的枯竭。更关键的挑战在于价值沉淀:如果生成的网站质量足够高、交付足够快,客户为何还要支付高价聘请后续的定制服务?这可能会将网页设计服务“商品化”,与使用该工具的机构利益产生潜在冲突。此外,冷接触中发送已完成的网站,可能引发关于知识产权和数据使用的法律模糊地带。

总体而言,Thyonix 是销售流程中一个极具巧思的“特洛伊木马”,短期内能为销售端带来显著转化提升。但长期来看,它更像是一剂强效但药效期有限的“兴奋剂”,而非可持续的竞争壁垒。它的未来取决于能否从“销售入口工具”深化为贯穿整个服务交付的“协作与管理平台”,否则一旦市场教育完成或竞品模仿,其优势将迅速消散。

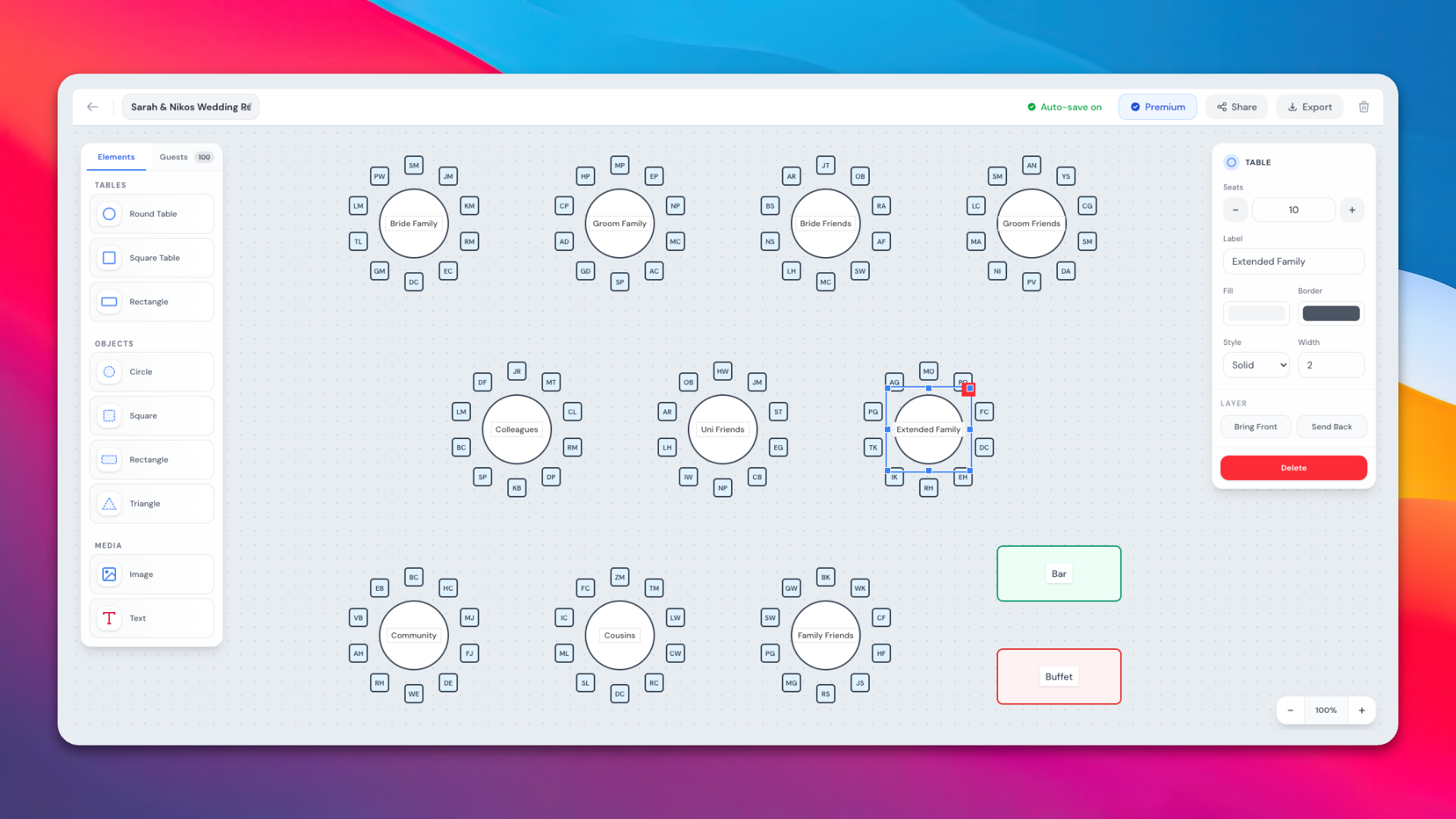

一句话介绍:Tablex是一款通过可视化拖拽布局工具,帮助用户在婚礼、会议等社交活动场景中,高效解决座位安排难题,避免人际冲突与规划混乱。

Design Tools

Events

Marketing

活动策划工具

座位图设计

可视化拖放

婚礼规划

会议管理

社交活动

场地布局

SaaS应用

痛点解决

用户评论摘要:创始人分享了产品源于朋友婚礼排座的痛苦经历。一条有效评论询问是否支持用颜色标记宾客或桌子以更好区隔关系,这代表了对更精细人群管理功能的需求。另一条评论则表达了合作访谈的邀请。

AI 锐评

Tablex瞄准了一个极其经典且高频的痛点——“座位政治”,这远非一个简单的排列组合问题,而是涉及人情世故、关系亲疏与活动流程管理的微型社会工程。产品将非结构化的、充满情感压力的决策过程(贴纸条、吵架),转化为结构化的、可视化的拖拽操作,其核心价值在于实现了“决策的可视化与即时反馈”,从而降低了协调的心理成本和沟通成本。

然而,其面临的挑战同样清晰。首先,功能层面看似简单,极易被模仿或整合。大型活动管理平台或甚至Canva等设计工具,完全可能通过一个功能模块就覆盖其场景。其次,市场天花板明显。婚礼场景虽痛但低频,用户生命周期短;拓展至企业会议市场,则需面对更复杂的流程集成(如报名、签到)与采购流程,工具属性恐难支撑更高溢价。当前“颜色标记”的用户建议,恰恰暴露了其从“座位摆放”工具向“关系管理”平台升级的潜在路径,但这需要更深的数据结构和对人际关系的抽象能力。

创始人“为朋友解决问题”的故事很真诚,但产品若想走远,必须超越“更好用的拖拽画布”这一定位。其真正的壁垒或许在于:通过积累大量匿名布局数据,形成关于“如何避免社交灾难”的洞察与模板,甚至成为活动社交动力学的事实标准。否则,它可能只是一个在特定时刻被感激、但难以形成持久品牌忠诚的“止痛药”型工具。

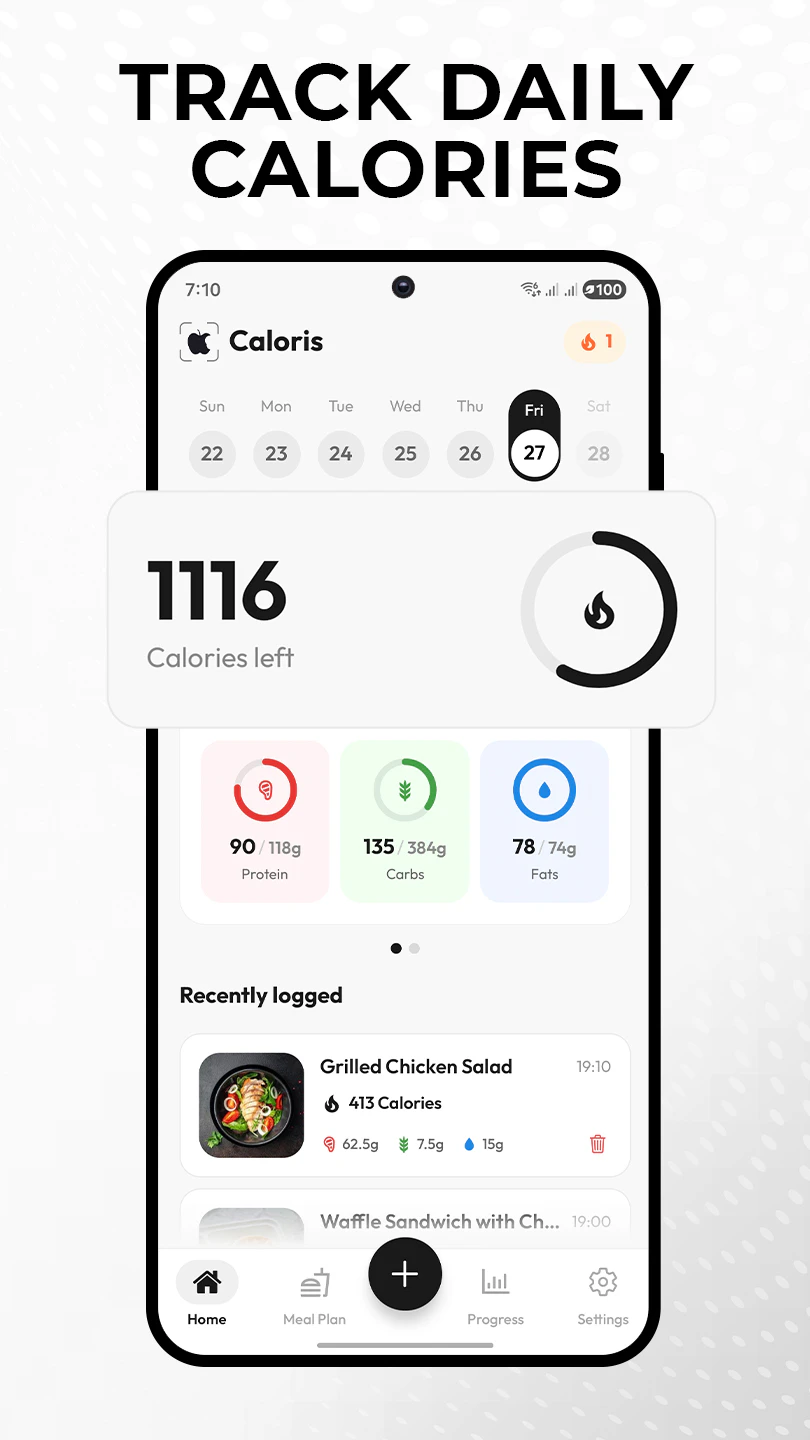

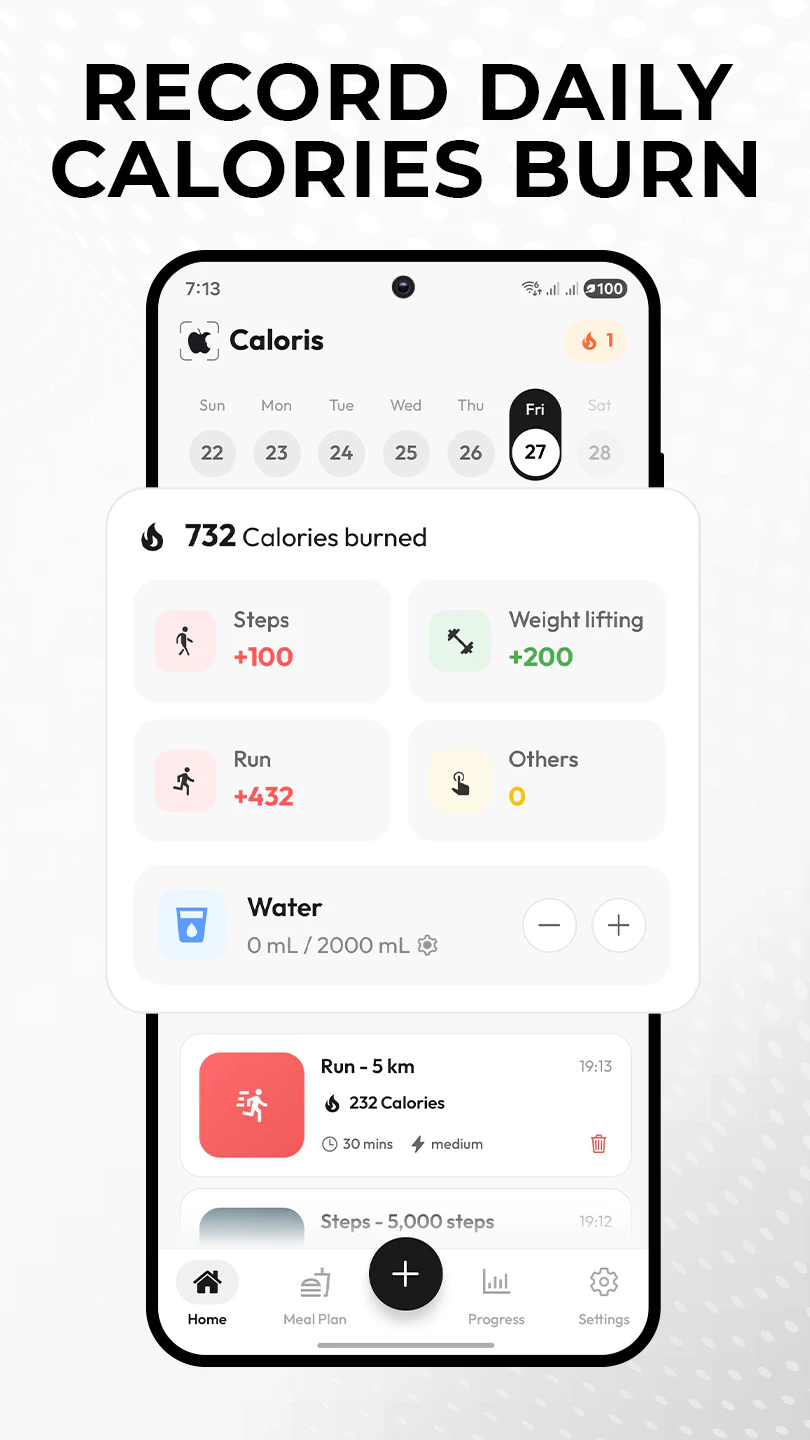

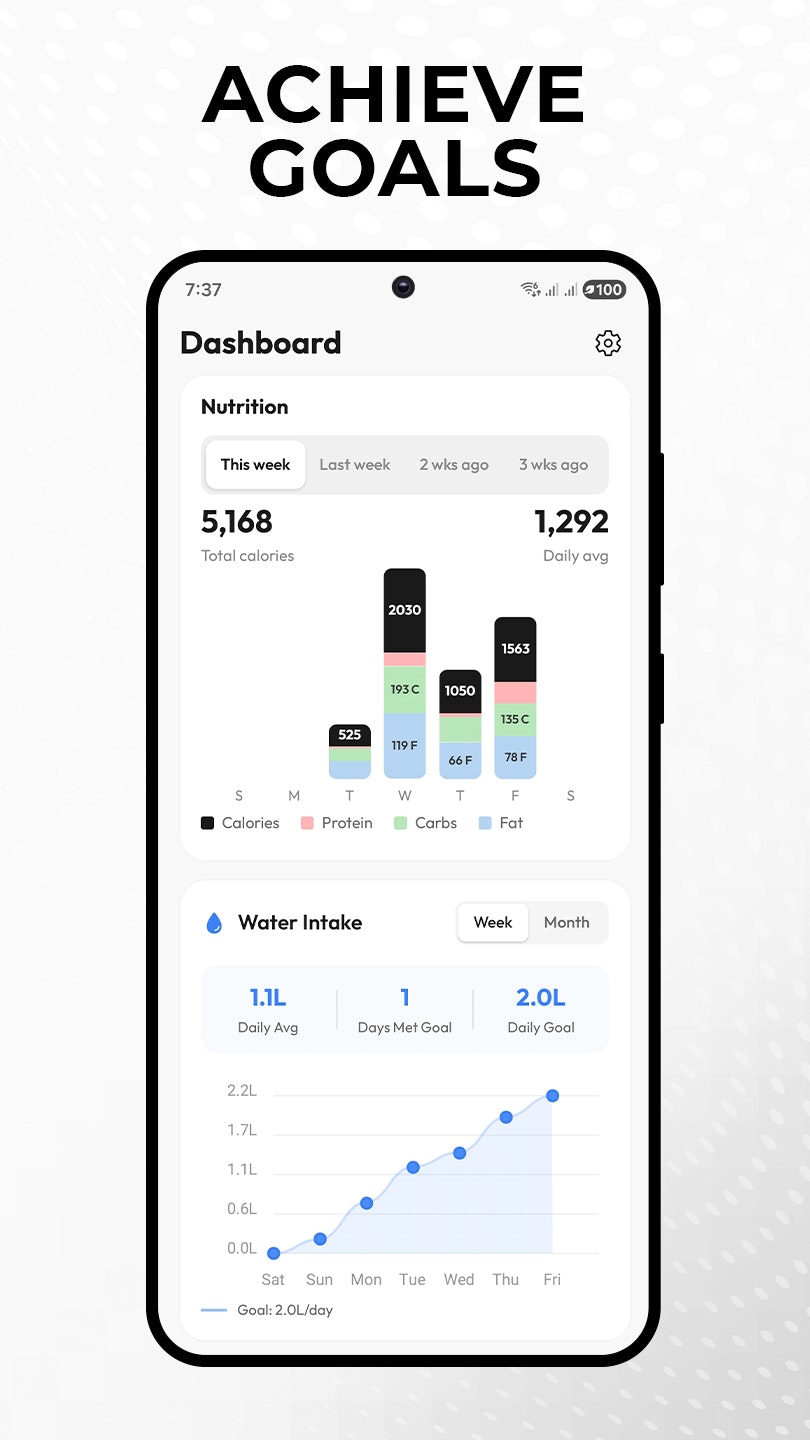

一句话介绍:一款通过AI拍照即时识别食物并分析热量与营养素的工具,在用户需要快速记录饮食的场景下,解决了传统卡路里记录应用操作繁琐、耗时过长导致用户难以坚持的核心痛点。

Android

Health & Fitness

Artificial Intelligence

AI健康应用

卡路里追踪

营养分析

食物识别

饮食管理

健身工具

效率工具

个人健康

图像识别

移动应用

用户评论摘要:用户肯定其相机优先、降低记录摩擦的理念,并认可其对家常菜、混合餐食的识别能力。主要反馈聚焦于AI估算的透明度与信任度问题,建议展示估算依据(如成分、份量假设)并提供便捷的修正流程,以增强用户信心。

AI 锐评

Caloris切入了一个经典困境:健康追踪的雄心总败给记录过程的繁琐。其价值核心并非AI识别的技术炫技,而是将“记录”这一最大用户成本,从主动的、耗时的“搜索与输入”转变为被动的“拍照与确认”。这本质上是交互范式的革新,直击用户放弃的核心——意志力损耗。

然而,产品介绍中“Snap, confirm, done”的理想流程,在实际中可能面临三重挑战。首先,是AI识别的准确性与信任危机。评论中已指出,缺乏估算依据的“黑箱”输出,难以说服对数据敏感的核心用户(如健身者)。其次,是场景复杂性。识别一盘成分清晰的沙拉与一盘咖喱烩饭的难度天差地别,后者涉及复杂的混合与遮挡,当前技术能否稳定应对存疑。最后,是商业模式与用户定位的潜在矛盾。宣称“为普通人而非健身狂热者设计”并基础功能免费,固然利于获客,但最需要精准数据的恰恰是“狂热者”。若为普及性牺牲精度,可能失去高价值用户;若追求精度,则技术成本与“免费基础功能”模式可能产生冲突。

其真正的机会在于,利用极低的记录门槛,吸引海量轻度用户形成饮食记录习惯,构建独特的、基于真实餐食图像的数据库。这或许比单纯成为一个追踪工具更具长期想象空间。但当下,它必须首先在“便捷”与“可信”之间,找到一个坚实的平衡点。

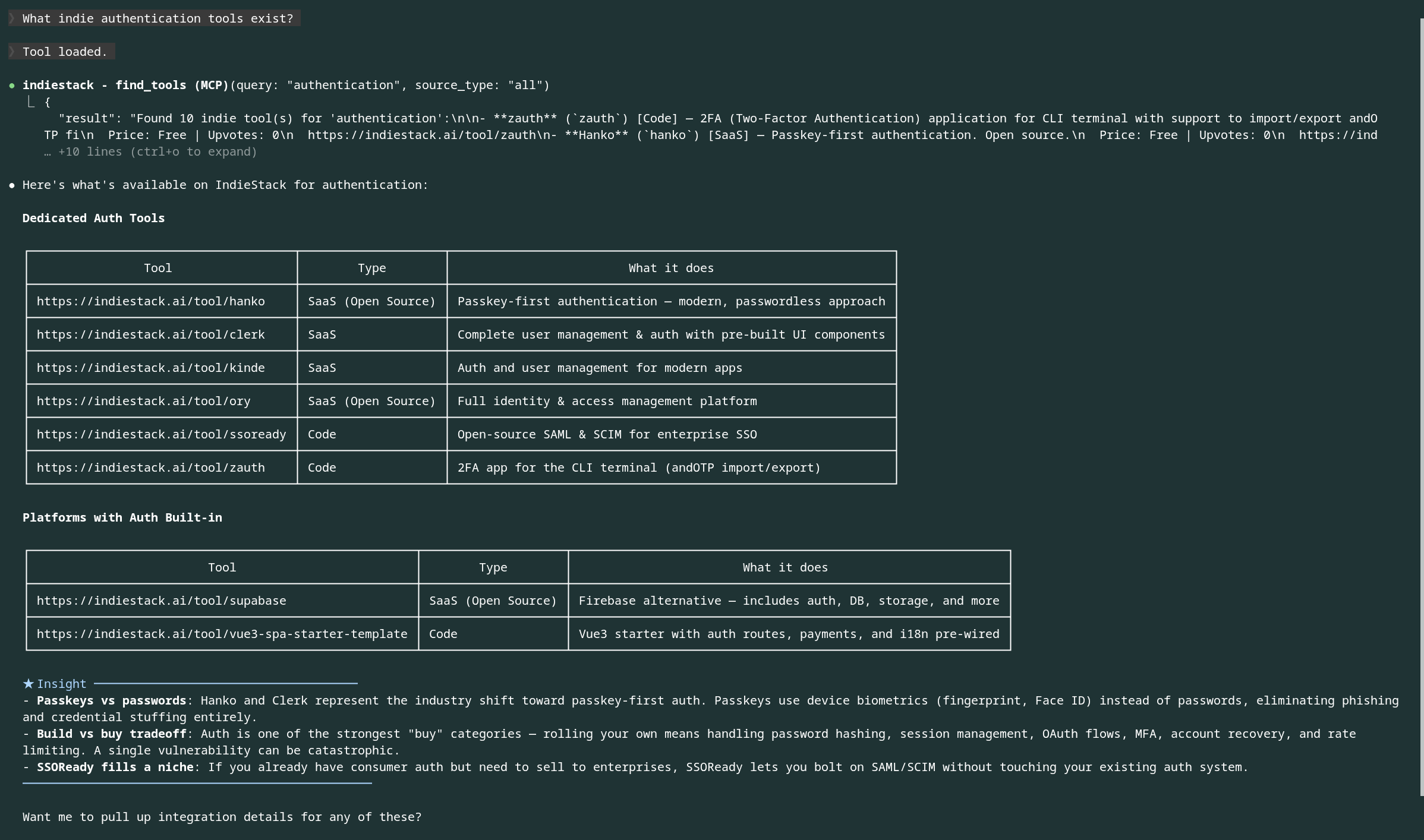

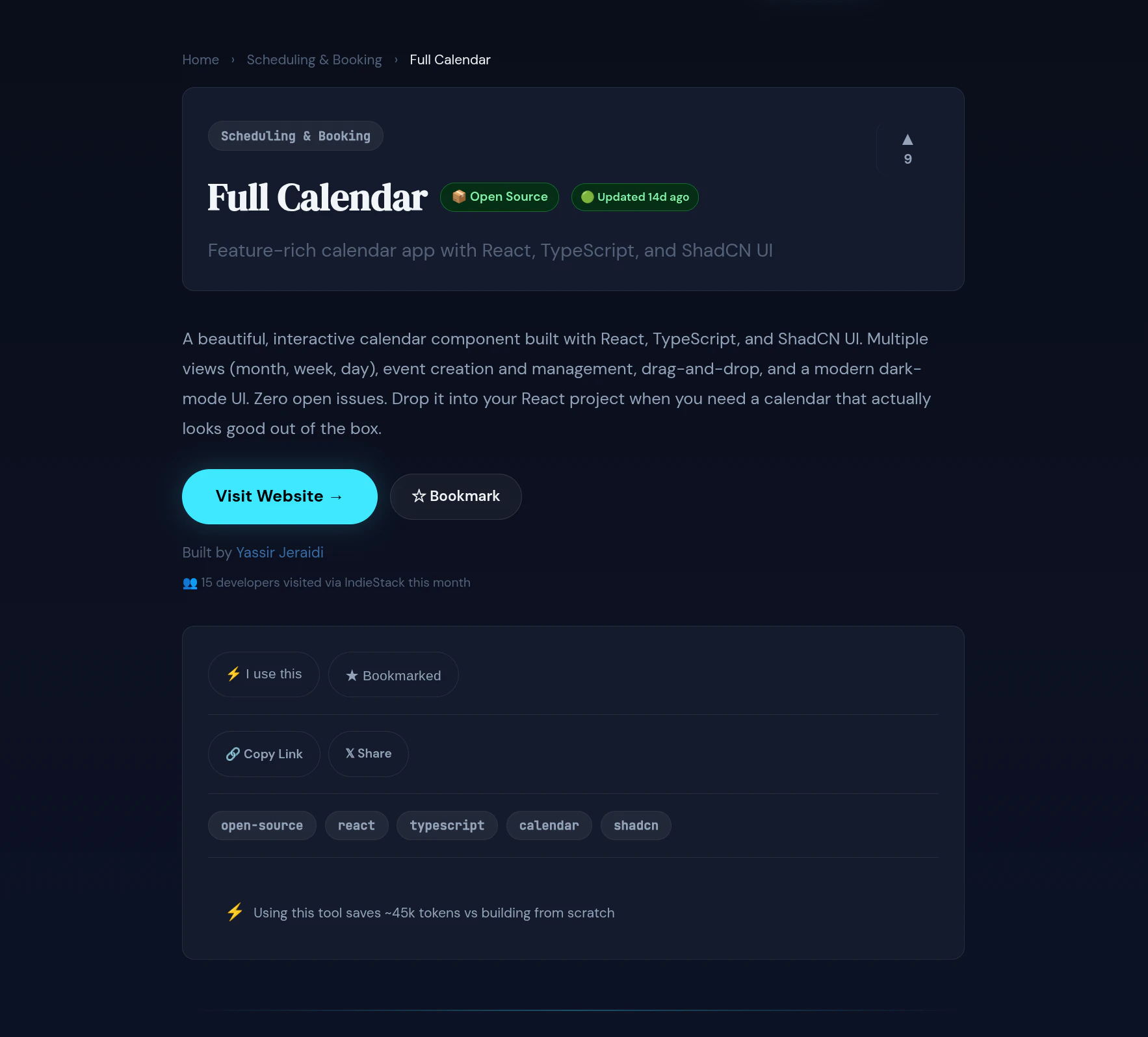

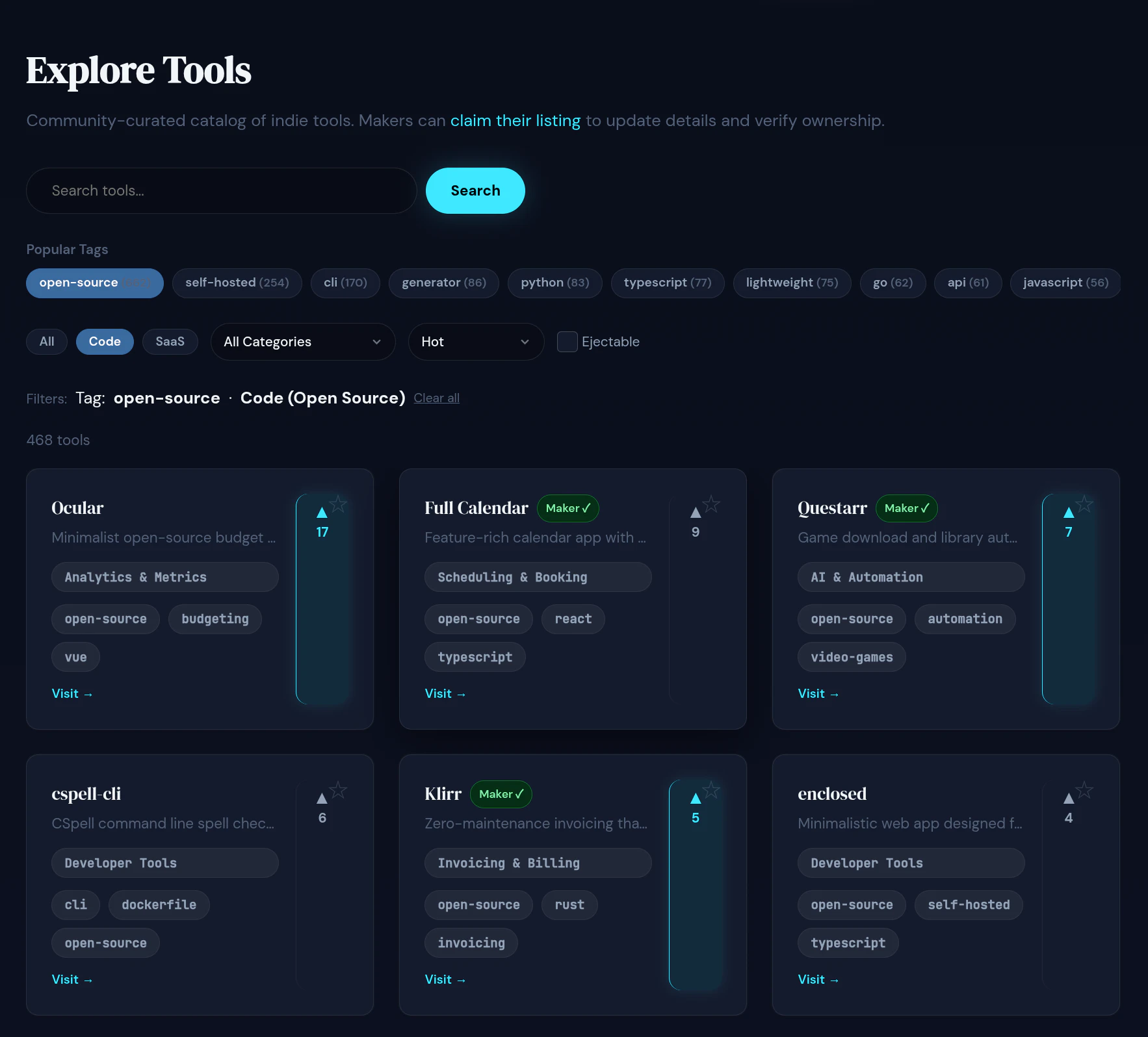

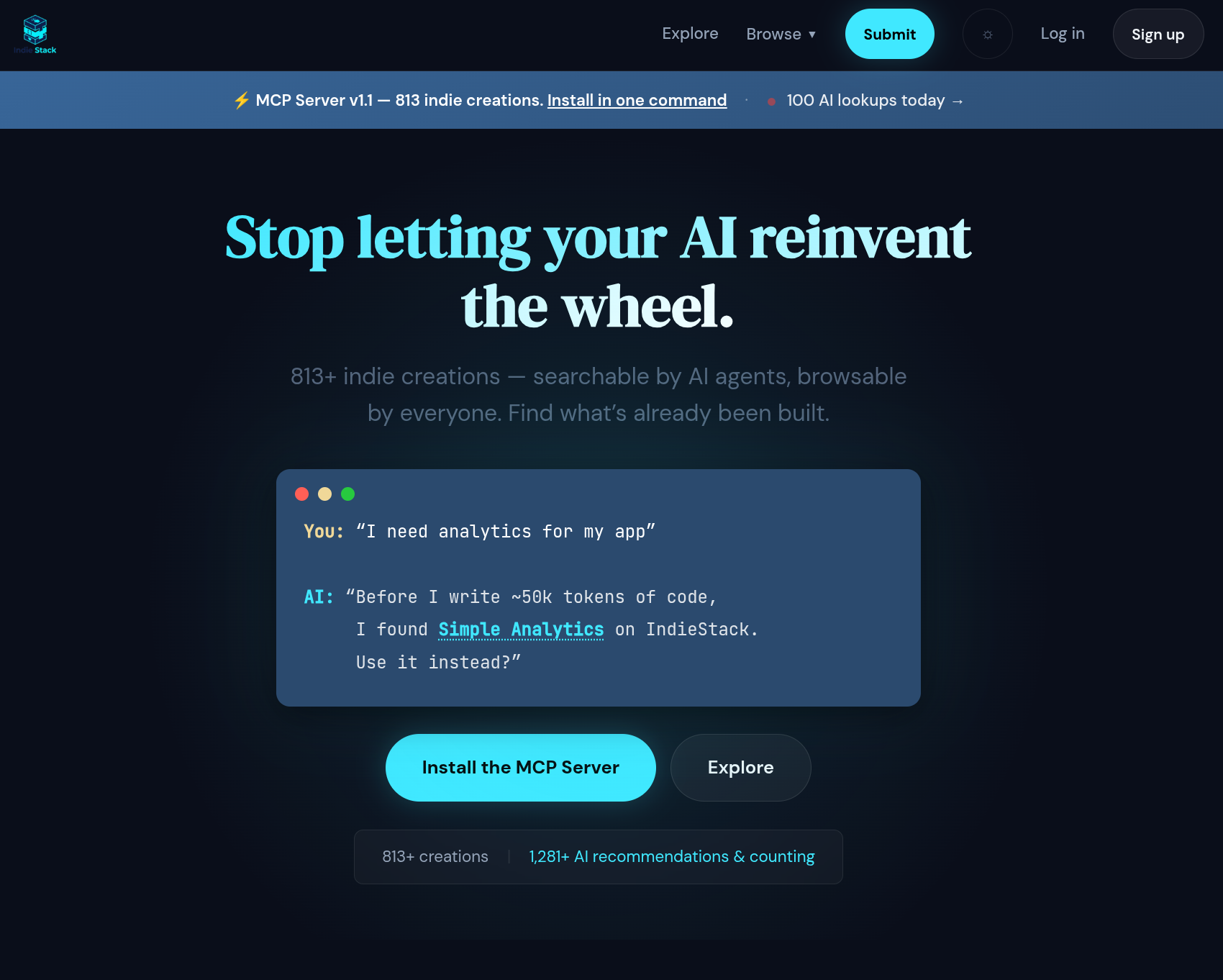

一句话介绍:IndieStack是一个为AI开发工具提供现有独立开发者解决方案索引的MCP服务器,旨在阻止AI重复“造轮子”,在AI辅助编程场景下解决资源浪费与优秀独立项目被埋没的痛点。

Productivity

Developer Tools

Artificial Intelligence

AI开发工具

MCP服务器

代码复用

独立开发者

项目发现

防重复建设

开源索引

资源优化

用户评论摘要:用户肯定其“避免重复造轮子”的核心价值,认为能挖掘独立项目的隐藏价值。有用户询问产品细节并寻求合作交流。开发者互动积极,邀请用户分享作品以增加可见性。

AI 锐评

IndieStack瞄准了一个在AI代码生成时代日益尖锐的矛盾:AI的“无知”浪费与人类开发者的“隐形”创造。其核心价值并非技术突破,而是充当一个“翻译层”和“记忆体”——通过MCP协议,将散落在GitHub上那些低星但高质量的独立项目,转化为结构化、可被AI智能体理解和引用的知识。

产品逻辑犀利地戳破了当前AI编程的两个幻觉:一是AI能无中生有地创造最优解,二是开源生态的可见度等同于代码质量。它试图将开发从“生成一切”拉回“检索优先”的理性轨道,这本质上是对当前AI辅助编程工具“重生成、轻检索”架构缺陷的一次补丁式修正。

然而,其商业模式和可持续性面临严峻拷问。作为一个由学生主导、目前免费的项目,如何持续维护和验证近800个并不断增长的“独立创作”的质量与安全性?如何定义“有用”并防止列表沦为垃圾项目的聚集地?更深层的挑战在于,它需要说服AI工具提供商(如Cursor、Claude)将其深度集成,而不仅仅是一个可选的插件。否则,它极易沦为另一个需要人工主动查询的“小众目录”,并未从根本上改变AI的默认行为模式。

它的真正前景,或许不在于成为一个独立的成功产品,而在于其理念被主流AI编码工具吸收,内化为“生成前检索”的标准流程。在此之前,IndieStack更像一个充满理想主义的社会实验,验证“人类智慧结晶优先于机器重复劳动”这一命题,在AI时代是否还能成立。

Hi everyone! I'm Yunhao, CEO and co-founder of TestSprite 👋

Thrilled to share what's new in TestSprite 2.1!

When we launched 2.0, the response blew us away. Thousands of teams told us the same thing: "This is the missing piece — we were shipping AI-generated code and just hoping it worked." That feedback pushed us to go even further.

2.1 is about making the MCP workflow faster, more precise, and enforcing it all the way to production.

🔌 Quick recap: TestSprite MCP

At the core of TestSprite is the MCP Server — it connects directly to your AI coding environment (like Cursor), reads your spec, and autonomously generates a complete test plan, writes all the test cases, executes them, and sends fix instructions back to your coding agent. AI validating AI — no manual testing, no prompting.

2.1 builds on top of that with three major upgrades:

⚡ 4–5x Faster Testing Engine

We rebuilt the AI testing engine from the ground up. What used to take 25 minutes now runs in about 5. Verification finally keeps up with the speed of AI code generation.

🖱️ Visual Test Modification Interface

If the MCP generates a test step that's slightly off, you no longer restart from scratch. Click into the step, see a live snapshot of exactly that moment in the test run, and fix it in seconds — swap the locator, change the interaction type, redirect the flow. Point and click. No code.

🔗 GitHub Integration — Automatic PR Testing

Once your MCP-generated tests are committed to your repo, the GitHub integration takes over. Connect via the TestSprite GitHub App (no workflow files needed) or GitHub Actions for custom CI/CD pipelines. On every pull request, TestSprite automatically runs your full test suite against the preview deployment — on Vercel, Netlify, Render, Railway, Fly.io — and the TestSprite bot posts a detailed pass/fail summary directly on the PR. Enable merge blocking to make sure failing code never reaches production.

The full loop: MCP generates and validates your tests locally → GitHub enforces them on every merge. Automatically.

If your team is building with AI, TestSprite 2.1 makes sure every PR is production-ready — without lifting a finger.

Free tier available. Give it a try and let us know what you think! 👉 https://testsprite.com

Thank you for the incredible support since 1.0 — we're building this with you, and we can't wait to hear your feedback 🙌

Excited to see TestSprite 2.1 live on Product Hunt! 🚀

Automating end-to-end testing is such a big pain point for many teams, and the idea of generating tests 10x faster with an AI agent is really compelling. The visual editor for adjusting test flows in plain English is a nice touch too—much easier than maintaining complex scripts. The new GitHub Actions integration also makes a lot of sense for CI workflows.

Congrats on the 2.1 launch, @jiao_yunhao @rui_li6 and team! 🚀

Really exciting to see the MCP workflow maturing—especially the focus on the verification layer. As more teams ship AI-generated code, automated test generation + enforcement in the PR workflow feels less like a “nice to have” and more like a necessary safety net. The 4–5x speed improvement is particularly impressive since verification often becomes the bottleneck when coding agents get faster.

One question I’m curious about: how do you see TestSprite evolving as AI agents move from generating code to operating longer-running autonomous workflows? Do you envision MCP extending beyond code verification into broader agent behavior validation?

Looking forward to trying 2.1 and seeing where you take this next. 👏

Strong launch — the MCP→PR merge-blocking loop is exactly the part most teams miss. One thing I’d love to see: a “flake profile” per repo (dynamic selectors, async data, auth redirects) so teams can separate true regressions from environment noise before blocking merges. If you already track this internally, exposing it in PR comments would be a killer differentiator for AI-native QA.

Congratulations, looks great!

The 'missing layer' framing is exactly right — the real unlock isn't test generation speed, it's closing the 'AI codes but nobody validates it actually works' loop at the workflow level. The hardest part of AI-native testing is the semantic oracle problem: when AI generates code, the ground truth for 'correct' is often fuzzy. Does TestSprite handle purely structural/functional assertions (output matches expected), or does it also do semantic validation — e.g. 'this UI flow still makes sense for the user'? That gap is where most AI testing pipelines quietly break down.

Great idea. Tools that focus on testing and debugging are going to be essential as AI-generated code keeps growing.

Great developers write code.

Elite developers debug reality.

Testing is the most boring part for me, but also the most valuable! It validates your core functionality; I love the idea :)

Looks like you're tackling a real issue with AI coding tools. Generating code is easy now, but validating that it actually works is still messy.

Really like the idea of automatically generating tests and enforcing them in PRs. The visual test editor also seems like a smart addition instead of constantly rewriting tests.

Curious if most teams use TestSprite mainly with AI coding tools like Cursor, or also in more traditional development workflows?

Looks good, but damn, I did the exact same thing 9 months ago: https://www.producthunt.com/products/testr-qa-solution-for-vibecoders/launches/testr - it even had an MCP server.

I have 0 clients, 1 comments, 8 upvotes.

I guess its distribution issue? Sad still

How does TestSprite handle complex dependencies and state management when automatically generating and executing tests across both frontend and backend environments?

Definitely going to check this out. The test generation can be a HUGE time saver.

hey,

right now Testsprite looks like an AI testing tool, but the stronger narrative might actually be AI verifying AI-generated code.

That framing could make the use case much clearer for teams building with AI coding agents.

The GitHub integration that auto-runs tests on every PR and blocks merges on failure is a game-changer for teams moving fast. That's the exact guardrail most small teams skip because setting it up feels like overhead, and then they regret it in production.

The visual test editor where you click a step to see a live snapshot is a really smart UX decision too. Debugging test failures has always been painful because you're reading logs blind, this closes that loop nicely.

Congrats on #1 today! Rooting for you.

Do you folks support mobile apps?

The GitHub PR blocking is the feature that makes this actually useful in a real team environment — without that gate it's just a nice to have that gets skipped when deadlines hit. Curious how it handles flaky tests that fail intermittently on the live preview environment due to timing or network issues rather than actual code problems. That's the thing that erodes trust in automated test suites fastest — if it blocks a merge for a false positive once, developers start ignoring it permanently.

I've been testing my AI pipeline by hand, and honestly, I'm over it. 4 different providers, each returning slightly different JSON structures; writing test cases for each takes forever. Does TestSprite handle non-deterministic outputs well? That's what always gets me with TubeSpark's generation flows: the same prompt gives you different shapes every time.

The MCP-to-GitHub loop is the real unlock here. Most teams I've seen still treat testing as a separate step after shipping, not something baked into the PR itself. The merge blocking on failed tests alone would save hours of debugging in production. Curious how the visual editor handles dynamic content that changes between test runs.

I stop trusting agent loops when the test result and fix step drift apart. TestSprite MCP reading the spec, generating the test plan, then sending fix instructions back to the coding agent feels useful, especially if each round keeps a visible trace you can audit.

Have you implemented any sort of caching or parallelization strategies within the Testing Engine to mitigate the increased load and potential slowdowns that might occur when dealing with large-scale, complex AI-generated codebases?